Zusammenfassung

Deepfake-Betrug ist nicht länger eine theoretische Geschichte über KI-Missbrauch. Wir haben jetzt dokumentierte Fälle, in denen Kriminelle KI-generierte Video- und Sprachklone verwendet haben, um sich in Live-Telefonkonferenzen als Führungskräfte auszugeben und Mitarbeiter zur Überweisung von $25 Millionen zu zwingen. Dieselbe Technologie wird eingesetzt, um die KYC zu umgehen, die Überprüfung der Gesichtserkennung zu umgehen, sich als Bankkunden auszugeben und dringende Überweisungen mit Hilfe von Social Engineering zu tätigen.Weltwirtschaftsforum)

Dies ist nicht nur ein Betrugsproblem. Es ist ein zentrales Fintech-Sicherheitsproblem, ein regulatorisches Problem (GDPR / FCA / FTC) und ein Risiko auf Vorstandsebene für jedes Unternehmen, das Geld mit hoher Geschwindigkeit bewegt oder Remote-Kontoeröffnung zulässt.(Fortuna)

Wie der "Deepfake-Betrug" in der Finanzwelt tatsächlich aussieht

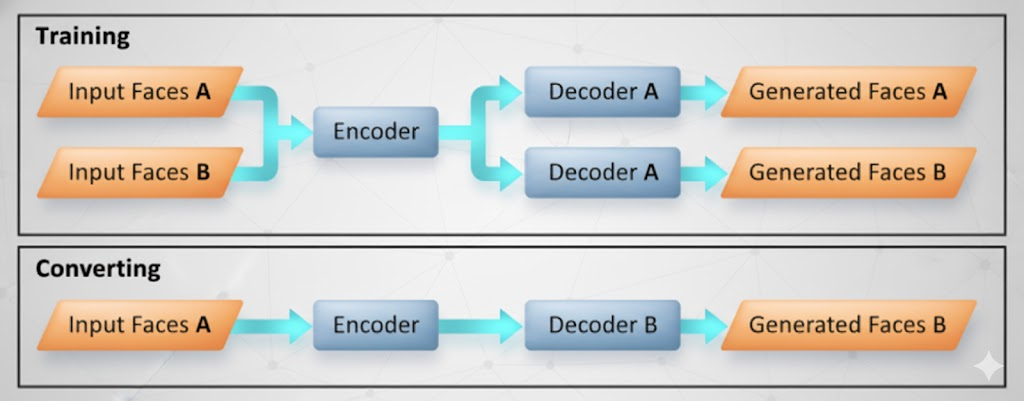

Bei Deepfakes handelt es sich um KI-generierte oder KI-veränderte Audio-/Videodateien, die das Gesicht, die Stimme, die Mikrobewegungen des Gesichts, die Kadenz und das Sprachmuster einer echten Person überzeugend imitieren. Angreifer nutzen sie jetzt als Waffe, um sich als solche auszugeben:

- Der CFO oder regionale VP eines Unternehmens gibt "dringende vertrauliche Überweisungsanweisungen".

- Ein Bankkunde, der darum bittet, die Kontokontrollen zurückzusetzen.

- Ein Compliance Officer fragt nach Rechnungen, Pässen oder Überweisungsdaten.

- Die Finanzleitung eines vertrauenswürdigen Anbieters fordert ein "aktualisiertes" Auszahlungskonto an.

Was sich geändert hat, ist nicht nur der visuelle Realismus. Es ist die Zugänglichkeit. Handelsübliche Stimmsynthesetools können eine Stimme aus Sekunden öffentlicher Audiodaten klonen und dann ein beliebiges Skript mit dieser Stimme vorlesen - genug, um die schwachen "Stimmverifizierungsströme" einiger Banken zu passieren.(Business Insider)

Damit fällt die alte Annahme "wenn ich sie live hören oder sehen kann, müssen sie es sein" in sich zusammen.

Fallstudien und warum sie wichtig sind

$25M gefälschte Durchführungsverordnung per Videoanruf

Anfang 2024 inszenierten Kriminelle eine gefälschte "dringende Führungskräftesitzung" per Video mit dem Büro eines multinationalen Unternehmens in Hongkong. Jeder Teilnehmer auf dem Bildschirm - einschließlich des CFO des Unternehmens, der so aussah und sich auch so anhörte - wurde von einer KI generiert. Der Finanzmitarbeiter, der an dem Gespräch teilnahm, wurde unter Druck gesetzt, mehrere Überweisungen in Höhe von insgesamt etwa $25 Millionen zu genehmigen.(Weltwirtschaftsforum)

Bei diesem Angriff wurde Social Engineering mit einer äußerst überzeugenden Deepfake-Präsenz kombiniert. Die Opfer dachten, sie würden direkte Anordnungen der Exekutive befolgen, und zwar in Echtzeit und vor laufender Kamera. Die Folgen lösten nicht nur ein internes "Betrugs-Ticket" aus, sondern auch forensische Untersuchungen und die Einbeziehung der Strafverfolgungsbehörden.Financial Times)

Klonen von Stimmen gegen Bankarbeitsabläufe

Sicherheitsforscher und Berichterstatter haben nachgewiesen, dass es mit einer für Verbraucher geeigneten Stimmerkennung möglich ist, den Kundendienst einer Bank anzurufen, sich wie der Kontoinhaber auszugeben und Änderungen der Verifizierung oder der Limits zu verlangen. In Tests waren die Spracherkennungssysteme einiger Finanzinstitute nicht robust genug, um den synthetischen Anrufer abzuweisen.(Business Insider)

Dadurch wird die Kontoübernahme von einem einmaligen Social-Engineering-Stunt zu etwas Skalierbarem und Automatisierbarem.

KYC-Umgehung und Remote-Onboarding

Banken, Kreditgeber und Zahlungs-Apps verlassen sich auf Remote-KYC: "Zeigen Sie uns Ihr Gesicht, lesen Sie diesen Satz, halten Sie Ihren Ausweis neben Ihr Gesicht." Angreifer erstellen jetzt hochwertige Gesichtsvideos mit realistischem Blinzeln, Kopfdrehungen und Tiefeninformationen und überlagern diese dann mit einem echten menschlichen Körper, um Aktivitätsprüfungen zu täuschen und betrügerische Konten zu eröffnen. Das Ergebnis: sofortige Geldschleuserkonten und neue Kanäle für die Geldwäsche.(Cybernews)

Dies sind keine Einzelfälle. Deloitte hat prognostiziert, dass KI-gesteuerter Betrug die Banken und ihre Kunden bis 2027 bis zu zehn Milliarden Dollar kosten könnte, da sich Deepfake-gestützte Betrügereien industrialisieren und ausweiten.(Deloitte Brasilien)

Spielbuch für Angriffe: Wie Deepfakes tatsächlich eingesetzt werden

Betrug mit der Identität einer Führungskraft / "dringende Überweisung jetzt"

- Ein Angestellter der Finanzabteilung wird in ein Videogespräch mit dem "CFO" gezogen, der vertrauliche, sofortige Überweisungen außerhalb der normalen Genehmigungswege verlangt.

- Der Deepfake nutzt Autorität, Geheimhaltung und Zeitdruck, um sich über die Politik hinwegzusetzen.

- Die Exposition bei einem einzigen Unfall kann einen achtstelligen Betrag übersteigen.(Weltwirtschaftsforum)

KYC-Betrug und Account Seeding

- Synthetisches "Live-Gesichts"-Video plus gefälschter Ausweis reicht für das Onboarding.

- Angreifer verschaffen sich unter gefälschten IDs Bank-/Fintech-/Börsenkonten und ermöglichen so Betrug, Geldwäsche und Kreditmissbrauch.(Cybernews)

Betrug durch Stimmenklonen

- Die Kriminellen imitieren eine Führungskraft oder einen vermögenden Kunden und erteilen per Telefon Anweisungen.

- Callcenter-Agenten und Nachwuchskräfte im Finanzwesen können "den Chef" oft nicht herausfordern.(Business Insider)

Phishing, jetzt mit Videobeweis

- Alte Phishing-E-Mails sahen schlampig aus.

- Neue Phishing-Kampagnen betten maßgeschneiderte "Videobotschaften" oder "Sprachnotizen" von einem scheinbar bekannten Kontakt ein, was die Glaubwürdigkeit drastisch erhöht.(Business Insider)

Kreditoren-/Rechnungsbetrug

- Die Angreifer geben sich als CFO eines langjährigen Lieferanten aus, mit passendem Gesicht und Stimme, und fordern die Kreditorenbuchhaltung auf, "die Überweisungsanweisungen zu aktualisieren".

- Die Gelder werden unbemerkt auf von Angreifern kontrollierte Konten umgeleitet.

Warum Finanzwesen, Fintech und Bankwesen besonders gefährdet sind

- Alles ist jetzt ferngesteuert.

Onboarding, Vorabgenehmigung von Krediten, Änderungen von Höchstbeträgen und Finanzgeschäfte laufen alle über Remote-Kanäle. Wenn Deepfakes den Schritt "Sind Sie wirklich Sie?" überwinden, setzt der Rest des Workflows Vertrauen voraus.(Cybernews) - Geschwindigkeit ist ein Merkmal.

Fintech- und Challenger-Banken rühmen sich damit, "ein Konto in wenigen Minuten zu eröffnen". Manuelle Überprüfungen und Unterschriften von mehreren Personen werden als Reibung betrachtet. Angreifer machen sich diese kulturelle Voreingenommenheit für Geschwindigkeit zunutze. - Übermäßiges Vertrauen in biometrische Daten.

Viele Organisationen betrachten "die Stimme klingt richtig" oder "das Gesicht stimmt mit dem Ausweisfoto überein" immer noch als starken Beweis. Deepfakes wurden buchstäblich entwickelt, um diese Annahme zu zerstören.(Business Insider) - Plattformübergreifender Explosionsradius.

Sobald ein Angreifer die Finanzabteilung dazu bringt, Geld zu verschieben, die Rechtsabteilung dazu, sich abzumelden, und die Zentrale dazu, Anmeldedaten weiterzugeben - oft in demselben gefälschten Anruf -, haben Sie es mit einem synchronisierten, abteilungsübergreifenden Angriff zu tun. Es handelt sich nicht mehr um eine Phishing-E-Mail mit nur einem Kanal.(Weltwirtschaftsforum) - Asymmetrie der Ressourcen.

Tier-1-Banken können sich die Erkennung von Anomalien, Betrugsanalysen und die Forensik gegnerischer Medien leisten. Ein regionales Zahlungs-Startup kann das wahrscheinlich nicht. Genau auf diese Lücke wird sich das organisierte Verbrechen als nächstes konzentrieren.(Deloitte Brasilien)

Verteidigung: Übergang von "Erkenne ich dieses Gesicht?" zu "Ist diese Transaktion verhaltenskonform?"

Moderne Verteidigung ist vielschichtig. Sie kombiniert technische Erkennung, Verhaltensanalysen, Prozesskontrollen und die Bereitschaft zur Einhaltung von Vorschriften.

Mehrschichtige Überprüfung (Verhalten + Gerät + Out-of-Band-Challenge)

- Verhaltensanalytik: Kadenz des Tippens, Dynamik des Cursors, Navigationsrhythmus.

- Geräteintelligenz: Fingerabdruck des Geräts, Konsistenz von Betriebssystem und Browser, Geolokalisierung und Kontoverlauf.

- Out-of-band Step-up-Authentifizierung: OTP oder sichere In-App-Bestätigung über einen separaten vertrauenswürdigen Kanal vor risikoreichen Aktionen.(Deloitte Brasilien)

Fortgeschrittene Überprüfungen zur Vermeidung von Spoofing

- Video: Blinzelrate und Timing, Latenz der Mikroexpression, 3D-Tiefeninformationen, Lichtreflexion auf der Haut (Nasenrücken/Stirn), Kantenschimmer, Kompressionsartefakte.

- Audio: Atemlücken, unnatürliche Pausen, Spektrogramm-Anomalien, roboterhaftes Grundrauschen.(Cybernews)

Das sind Signale, die eine reine "stimmt das Gesicht mit dem Ausweisfoto überein"-Pipeline nicht erfassen kann.

Kontrollen auf Prozessebene

- Überweisungen von hohen Beträgen erfordern eine doppelte oder dreifache Genehmigung über unabhängige Kanäle (Video + separat verifiziertes Telefon + interne Nachrichtenübermittlung).

- "Notfall" oder "vertraulich" setzt die Richtlinie nicht außer Kraft, sondern löst sie aus mehr Überprüfung, nicht weniger.(Weltwirtschaftsforum)

Kontinuierliche Informationen über Bedrohungen und Mitarbeiterschulungen

- Sicherheits-, SOC-, Betrugs-, Finanz- und Kreditorenbuchhaltungsteams sollten realistische Playbooks erstellen ("dringende Überweisung des CEO", "Änderung der Bankverbindung des Lieferanten", "Anruf eines VIP-Kunden").

- Den Mitarbeitern muss beigebracht werden: Ein überzeugendes Gesicht auf Zoom ist kein Identitätsnachweis mehr.(Weltwirtschaftsforum)

Konformität und Überprüfbarkeit

- Die Regulierungsbehörden (FCA im Vereinigten Königreich, FTC in den USA, GDPR in der EU) erwarten zunehmend, dass die Institutionen beweisen sie haben die Identität überprüft und eine Transaktion durch mehrstufige Kontrollen autorisiert, nicht nur "jemand hat sich am Telefon richtig angehört"(Fortuna)

- Die Versicherer aktualisieren die Deckung für Cyberkriminalität und Social Engineering. Sie fragen jetzt, ob Sie über eine Deepfake-Verifizierung und Protokolle für die Zeit nach einem Vorfall verfügen, bevor sie Schäden versichern.(Reuters)

Nachstehend finden Sie ein Beispiel für eine Betrugsrisikomatrix (Szenario und erforderliche Kontrollen):

| Szenario | Primäre Bedrohung | Erforderliche Kontrollen |

|---|---|---|

| Ferngesteuertes Onboarding / KYC | Falsches Gesicht + gefälschter Ausweis + synthetische "Lebendigkeit" | Fortgeschrittene Liveness, Verhaltensanalyse, Authentizitätsprüfung von Dokumenten, Fingerprinting von Geräten |

| Genehmigung von Überweisungen mit hohem Wert | Deepfake "CFO" ordnet dringende vertrauliche Übertragungen an | Rückruf über mehrere Kanäle, Workflow mit zwei Genehmigern, aufgezeichneter Prüfpfad |

| Erhöhung der Obergrenze für Callcenter | Sprachklon des "Kunden" | Sprachanalyse + Sicherheitsfragen + Out-of-Band OTP |

| Änderung der Kreditorenzahlung | Gefälschter Lieferantenfinanzkontakt mit geklonter Stimme/Video | Rückruf an vorregistrierte Telefonnummern/E-Mails, Überprüfung der Rechnungshistorie, interne Finanz-Eskalation |

Reaktion auf Vorfälle: Deepfake-Betrug wie eine Sicherheitsverletzung behandeln

Wenn der Verdacht auf Deepfake-Betrug besteht, sollte Ihr Spielbuch wie ein Sicherheitsvorfall aussehen, nicht wie ein routinemäßiger Kundenstreit:

- Frieren Sie die verdächtige(n) Überweisung(en) ein und blockieren Sie weitere ausgehende Überweisungen.

- Bewahren Sie alle Gesprächs-/Video-/Chat-Beweise für die Spurensicherung und die rechtliche Beweiskette auf.

- Eskalieren Sie gleichzeitig mit der Rechtsabteilung, der Compliance-Abteilung, der Betrugsabteilung und der Cyber-Abteilung - nicht nacheinander.

- Auslösen von Pflichtangaben, wenn dies von der FCA/FTC/GDPR oder sektoralen Aufsichtsbehörden verlangt wird; genaue Dokumentation, welche Kontrollen versagt haben.(Fortuna)

- Setzen Sie Anmeldedaten zurück, überprüfen Sie risikoreiche Konten erneut und erzwingen Sie eine Multi-Faktor-Authentifizierung für alle betroffenen Unternehmen.

Zum jetzigen Zeitpunkt behandeln viele Versicherer und Aufsichtsbehörden Deepfake-Betrug bereits wie einen Cybervorfall und nicht nur als "schlechtes Urteil eines Mitarbeiters".Reuters)

Abschließendes Argument: Identitätsnachweis ist nicht mehr visuell, sondern verhaltensbezogen, verfahrensbezogen und überprüfbar

Das Finanzwesen hat sich in der Vergangenheit auf visuelle und akustische Bestätigungen verlassen: "Ich habe sie auf Video gesehen", "Ich habe ihre Stimme gehört", "Sie haben ihren Ausweis neben ihr Gesicht gehalten". Der Deepfake-Betrug macht dieses Modell zunichte.Business Insider)

Der neue Standard ist vielschichtig, kontradiktorisch und reguliert. Er verbindet fortschrittliche Liveness Detection, Verhaltensanalyse, strenge Mehrparteien-Genehmigung für hochwertige Aktionen und schnelle Reaktion auf Vorfälle mit gesetzeskonformer Beweissicherung.Fortuna)

Mit anderen Worten: Die Frage lautet nicht mehr "Erkenne ich dieses Gesicht?". Die Frage lautet: "Kann diese Aktion morgen früh eine Prüfung, einen Rechtsstreit, eine Versicherungsprüfung und eine behördliche Untersuchung überstehen?"