Resumen ejecutivo

El fraude Deepfake ya no es una historia teórica de abuso de la IA. Ahora tenemos casos documentados en los que los delincuentes utilizaron clones de vídeo y voz generados por IA para hacerse pasar por ejecutivos en teleconferencias en directo y presionar a los empleados para que transfirieran más de $25 millones. La misma tecnología se está utilizando para eludir el sistema KYC, eludir los controles de vitalidad facial, hacerse pasar por clientes bancarios y realizar transferencias urgentes mediante ingeniería social".Foro Económico Mundial)

No se trata sólo de un problema de fraude. Es un problema de seguridad fundamental para las empresas de tecnología financiera, un problema normativo (GDPR / FCA / FTC) y un riesgo a nivel directivo para cualquier organización que mueva dinero a gran velocidad o permita la incorporación remota de cuentas".Fortuna)

Cómo es realmente el "fraude profundo" en las finanzas

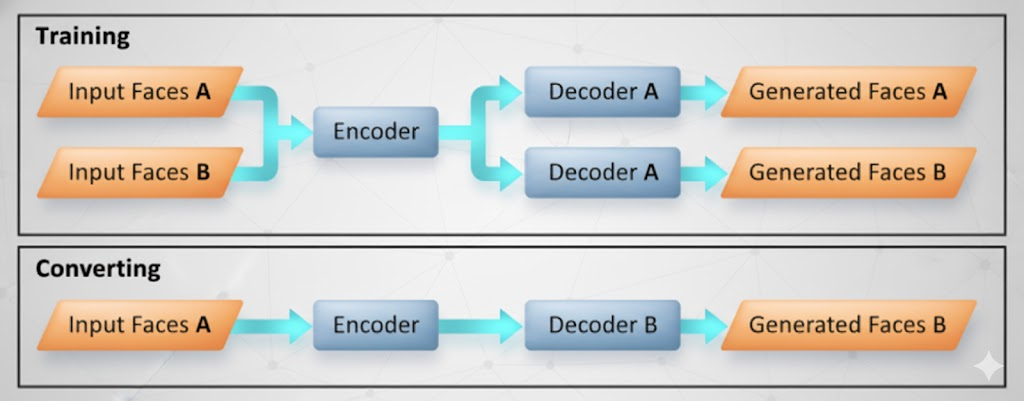

Los deepfakes son activos de audio/vídeo generados o alterados por IA que imitan de forma convincente el rostro, la voz, los micromovimientos faciales, la cadencia y el patrón del habla de una persona real. Los atacantes los utilizan ahora como arma para hacerse pasar por:

- El director financiero o el vicepresidente regional de una empresa dando "instrucciones confidenciales urgentes de transferencia".

- Un cliente de un banco que pide restablecer los controles de su cuenta.

- Un responsable de cumplimiento pidiendo facturas, pasaportes o datos de transferencias.

- Un responsable financiero de un proveedor de confianza solicita una cuenta de pagos "actualizada".

Lo que ha cambiado no es sólo el realismo visual. Es la accesibilidad. Las herramientas de síntesis de voz disponibles en el mercado pueden clonar una voz a partir de segundos de audio público y, a continuación, leer cualquier guión con esa voz, suficiente para pasar los débiles flujos de "verificación de voz" de algunos bancos.(Business Insider)

Eso derrumba la vieja suposición de que "si puedo oírlos o verlos en directo, deben ser ellos".

Casos prácticos y por qué son importantes

$25M deepfake orden ejecutiva a través de videollamada

A principios de 2024, unos delincuentes organizaron por vídeo una falsa "reunión urgente de altos cargos" con la oficina de Hong Kong de una multinacional. Todos los participantes en la pantalla -incluido el que parecía y sonaba como director financiero de la empresa- estaban generados por IA. Se presionó al empleado de finanzas para que autorizara varias transferencias por un total aproximado de $25 millones de euros.Foro Económico Mundial)

Este ataque mezclaba ingeniería social con una presencia deepfake extremadamente convincente. La víctima pensó que estaba siguiendo órdenes ejecutivas directas, en tiempo real, ante una cámara. Las consecuencias desencadenaron un incidente forense y la intervención de las fuerzas de seguridad, y no solo una "multa por fraude" interna.(Financial Times)

Clonación de voz contra los flujos de trabajo bancarios

Investigadores de seguridad y periodistas han demostrado que, con la clonación de la voz de un consumidor, es posible llamar al servicio de atención al cliente de un banco, hacerse pasar por el titular de la cuenta y solicitar cambios en la verificación o los límites. En las pruebas realizadas, los controles de coincidencia de voz de primera línea de algunas instituciones financieras no eran lo suficientemente robustos como para rechazar la llamada sintética.(Business Insider)

De este modo, la apropiación de cuentas deja de ser una maniobra de ingeniería social puntual para convertirse en algo escalable y automatizable.

Desvío de KYC e incorporación remota

Bancos, prestamistas y aplicaciones de pago confían en el KYC remoto: "muéstrenos su cara, lea esta frase, sostenga su documento de identidad junto a su cara". Los atacantes generan ahora vídeos faciales de alta calidad con parpadeos realistas, giros de cabeza y señales de profundidad, y los superponen a un cuerpo humano real para engañar a los controles de vitalidad y abrir cuentas fraudulentas. El resultado: cuentas de mulas de dinero instantáneas y nuevos canales de blanqueo.(Cibernoticias)

No se trata de casos extremos. Deloitte ha previsto que el fraude impulsado por IA podría costar a los bancos y sus clientes hasta decenas de miles de millones de dólares en 2027, a medida que las estafas basadas en deepfake se industrialicen y escalen".Deloitte Brasil)

Libro de jugadas de ataque: cómo se utilizan realmente los deepfakes

Suplantación de ejecutivos / fraude de "transferencia urgente ahora

- Un empleado de finanzas es arrastrado a una videollamada con "el Director Financiero", que exige transferencias confidenciales e inmediatas fuera de los canales normales de aprobación.

- El deepfake utiliza la autoridad, el secretismo y la presión del tiempo para anular la política.

- La exposición en un solo incidente puede superar las ocho cifras.(Foro Económico Mundial)

Fraude en el sistema KYC y en las cuentas

- El vídeo de "cara viva" sintética y el DNI trucado pasan el embarque.

- Los atacantes obtienen cuentas bancarias/financieras/de cambio con identificaciones falsas, lo que permite el fraude, el blanqueo de dinero y el abuso del crédito.(Cibernoticias)

Estafas de clonación de voz

- Los delincuentes imitan a un ejecutivo o a un cliente de alto poder adquisitivo y dan instrucciones por teléfono.

- Los agentes de los centros de atención telefónica y el personal financiero subalterno a menudo no pueden desafiar al "jefe".(Business Insider)

Phishing, ahora con prueba de vídeo

- Los antiguos correos electrónicos de phishing parecían descuidados.

- Las nuevas campañas de phishing incorporan "mensajes de vídeo" o "notas de voz" personalizados de lo que parece ser un contacto conocido, lo que aumenta drásticamente la credibilidad.(Business Insider)

Fraude de proveedores / facturas

- Los atacantes se hacen pasar por el director financiero de un proveedor a largo plazo, con cara/voz coincidente, y exigen que Cuentas por Pagar "actualice las instrucciones de la transferencia".

- Los fondos se desvían silenciosamente a cuentas controladas por el atacante.

Por qué las finanzas, las fintech y la banca están especialmente expuestas

- Ahora todo es a distancia.

Las operaciones de incorporación, preaprobación de préstamos, cambios de límites altos y tesorería se realizan a través de canales remotos. Si los deepfakes superan el paso "¿eres realmente tú?", el resto del flujo de trabajo asume la confianza.(Cibernoticias) - La velocidad es una característica.

Las fintech y los challenger banks se enorgullecen de "abrir una cuenta en minutos". La revisión manual y la aprobación por parte de varias personas se consideran una fricción. Los atacantes se aprovechan de ese sesgo cultural hacia la velocidad. - Exceso de confianza en la biometría.

Muchas organizaciones siguen considerando que "la voz suena bien" o "la cara coincide con la foto del DNI" son pruebas sólidas. Los deepfakes se crearon literalmente para acabar con esa suposición.(Business Insider) - Radio de explosión multiplataforma.

Una vez que un atacante convence a Finanzas para que mueva el dinero, a Legal para que dé el visto bueno y a Operaciones para que comparta las credenciales -a menudo en la misma llamada falsa-, estamos ante una brecha sincronizada y multidepartamental. Ya no se trata de un correo electrónico de phishing de un solo canal".Foro Económico Mundial) - Asimetría de recursos.

Los bancos de primer nivel pueden permitirse la detección interna de anomalías, el análisis de fraudes y el análisis forense de medios adversos. Una nueva empresa regional de pagos probablemente no pueda. Esa brecha es exactamente donde el crimen organizado se centrará a continuación.(Deloitte Brasil)

Defensa: pasar de "¿Reconozco esta cara?" a "¿Es esta transacción coherente desde el punto de vista del comportamiento?"

La defensa moderna es estratificada. Combina detección técnica, análisis del comportamiento, controles de procesos y preparación normativa.

Verificación por capas (comportamiento + dispositivo + desafío fuera de banda)

- Análisis del comportamiento: cadencia de escritura, dinámica del cursor, ritmo de navegación.

- Inteligencia de dispositivos: huella dactilar del dispositivo, coherencia entre sistema operativo y navegador, geolocalización e historial de cuentas.

- Autenticación por paso fuera de banda: OTP o confirmación segura dentro de la aplicación a través de un canal de confianza independiente antes de realizar acciones de alto riesgo.(Deloitte Brasil)

Controles avanzados de liveness / anti-spoofing

- Vídeo: frecuencia y temporización del parpadeo, latencia de las microexpresiones, señales de profundidad 3D, reflejos de luz en la piel (puente de la nariz / frente), brillo de los bordes, artefactos de compresión.

- Audio: lagunas en la respiración, pausas poco naturales, anomalías en el espectrograma, ruido de fondo robótico.(Cibernoticias)

Se trata de señales que no se detectan con un mero proceso de "¿coincide la cara con la foto del DNI?

Controles a nivel de proceso

- Las transferencias de alto valor requieren una aprobación doble o triple a través de canales independientes (vídeo + teléfono verificado por separado + mensajería interna).

- "Emergencia" o "confidencial" no anula la política, sino que la activa. más verificación, no menos.(Foro Económico Mundial)

Información continua sobre amenazas y formación del personal

- Los equipos de seguridad, SOC, fraude, tesorería y cuentas por pagar deben elaborar libros de jugadas realistas ("transferencia urgente del CEO", "cambio de información bancaria del proveedor", "llamada de voz de un cliente VIP").

- Hay que enseñar a los empleados: una cara convincente en Zoom ya no es prueba de identidad.(Foro Económico Mundial)

Conformidad y auditabilidad

- Los reguladores (FCA en el Reino Unido, FTC en EE.UU., GDPR en la UE) esperan cada vez más que las entidades puedan pruebe verificaban la identidad y autorizaban una transacción mediante controles por niveles, no sólo "alguien sonaba bien al teléfono".(Fortuna)

- Las aseguradoras están actualizando la cobertura contra la ciberdelincuencia y la ingeniería social. Ahora preguntan si se dispone de protocolos de verificación y post-incidentes de deepfakeware antes de suscribir siniestros.(Reuters)

A continuación se muestra un ejemplo de matriz de riesgo de fraude (escenario frente a controles necesarios):

| Escenario | Amenaza principal | Controles necesarios |

|---|---|---|

| Incorporación remota / KYC | Rostro falso + DNI falsificado + "viveza" sintética | Liveness avanzado, análisis de comportamiento, comprobaciones de autenticidad de documentos, huellas dactilares de dispositivos |

| Autorización de transferencias de gran valor | Deepfake "CFO" ordena cables confidenciales urgentes | Devolución de llamada multicanal, flujo de trabajo con doble aprobador, pista de verificación grabada |

| Aumento del límite del centro de llamadas | Clon de voz de "el cliente" | Análisis de voz + preguntas de desafío + OTP fuera de banda |

| Modificación del pago a proveedores | Falso contacto de financiación de proveedores con voz/vídeo clonados | Devolución de llamada al teléfono/correo electrónico registrado previamente, verificación del historial de facturas, escalado financiero interno |

Respuesta a incidentes: tratar el fraude deepfake como una brecha

Cuando se sospecha de un fraude por deepfake, su libro de jugadas debe parecerse a un incidente de seguridad, no a una disputa rutinaria con un cliente:

- Congele la transferencia o transferencias sospechosas y bloquee las transferencias salientes adicionales.

- Conserve todas las pruebas de llamadas, vídeos y chats para los análisis forenses y la cadena de custodia legal.

- No lo haga de forma secuencial, sino simultáneamente con los departamentos jurídico, de cumplimiento normativo, de fraude y cibernético.

- Activar las divulgaciones obligatorias si así lo exigen la FCA/FTC/GDPR o los reguladores del sector; documentar exactamente qué controles fallaron.(Fortuna)

- Restablezca las credenciales, vuelva a verificar las cuentas de alto riesgo y fuerce el multifactor para cualquier entidad afectada.

En este punto, muchas aseguradoras y reguladores ya tratan el fraude basado en deepfakes como un incidente cibernético, no como "un simple mal juicio de un empleado"(Reuters)

Argumento final: la prueba de identidad ya no es visual, sino conductual, procedimental y auditable.

Las finanzas han confiado históricamente en la confirmación visual y auditiva: "Los vi en vídeo", "Oí su voz", "Tenían su DNI junto a la cara". El fraude de Deepfake destruye ese modelo.(Business Insider)

La nueva norma es estratificada, contradictoria y regulada. Combina la detección avanzada de la actividad, el análisis del comportamiento, la aprobación estricta de múltiples partes para acciones de alto valor y la respuesta rápida a incidentes con la conservación de pruebas de grado legal".Fortuna)

En otras palabras: la pregunta ya no es "¿Reconozco esta cara?". La pregunta es "¿Podrá esta acción sobrevivir a la auditoría, el litigio, la revisión del seguro y el escrutinio normativo de mañana por la mañana?".