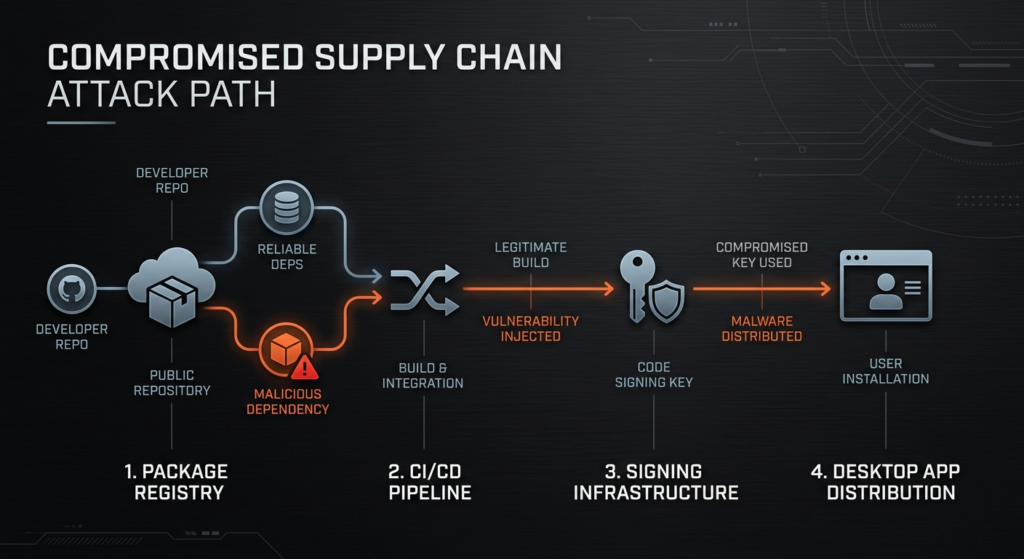

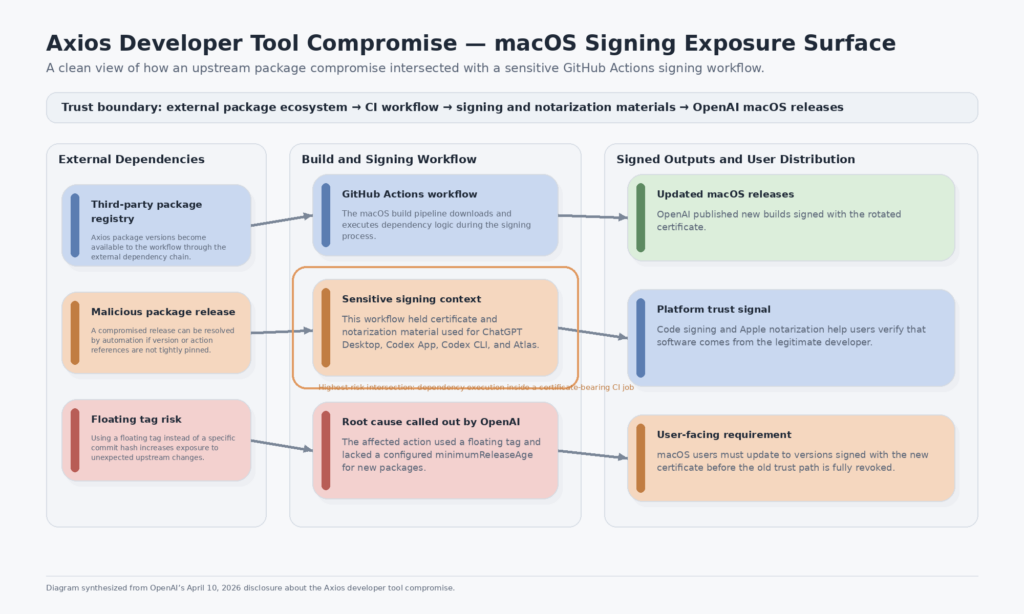

L'avis de compromission de l'outil de développement d'OpenAI publié par Axios pouvait être mal interprété si l'on se contentait d'en lire le titre. L'entreprise a pas que les attaquants avaient compromis les données des utilisateurs d'OpenAI, pris le contrôle d'applications publiées ou volé des clés API. Il a dit quelque chose de plus spécifique et, pour les défenseurs de la chaîne d'approvisionnement des logiciels, de plus intéressant : une version malveillante d'Axios a fonctionné dans un flux de travail GitHub Actions lié au processus de signature des applications macOS, et ce flux de travail a eu accès au certificat et au matériel de notarisation utilisés pour signer les applications macOS d'OpenAI. OpenAI n'a trouvé aucune preuve que son logiciel avait été modifié ou que le certificat de signature avait été exfiltré, mais elle a tout de même révoqué et fait pivoter ce certificat, publié de nouvelles versions et demandé aux utilisateurs de macOS de se mettre à jour. (openai.com)

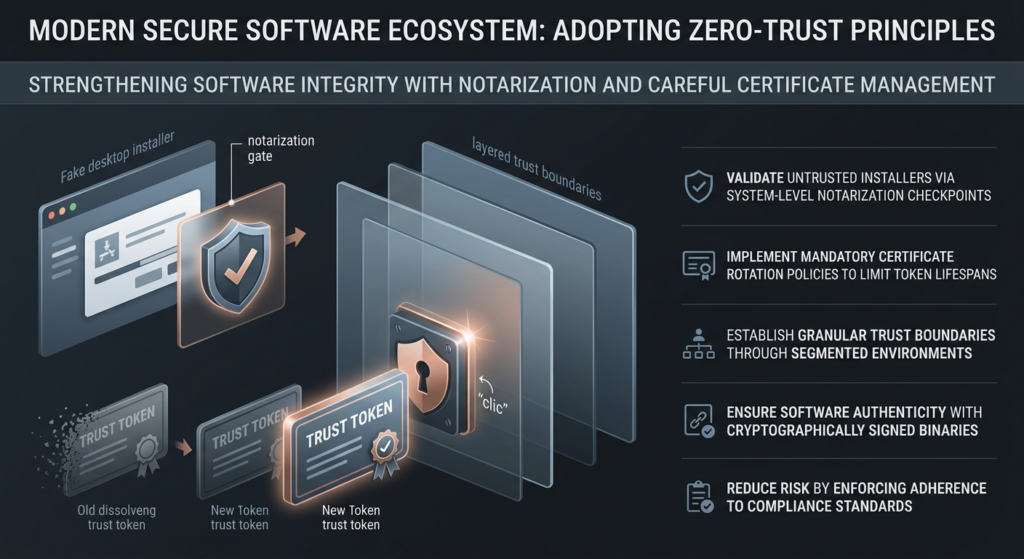

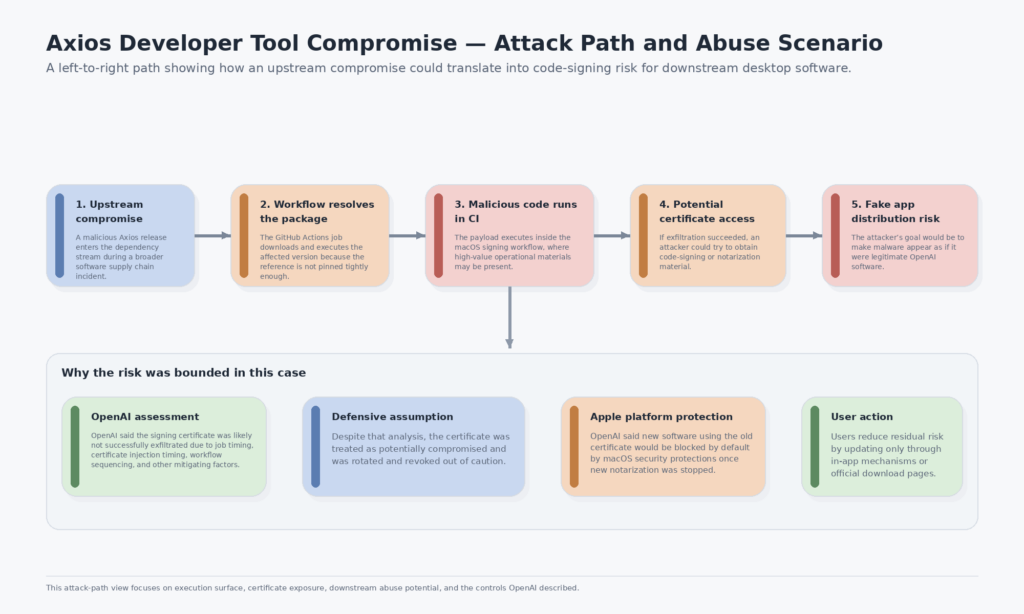

Cette distinction est importante. La compromission d'une dépendance normale est déjà grave parce qu'elle peut exposer les postes de travail des développeurs, les programmes d'exécution CI, les informations d'identification dans le nuage ou les jetons à longue durée de vie. Une compromission de dépendance qui atteint un flux de travail de signature de code est pire parce qu'elle touche à la confiance logicielle elle-même. Une fois que le code malveillant s'exécute dans la mauvaise phase de construction, l'ambition de l'attaquant ne s'arrête plus au vol de secrets. L'objectif suivant peut devenir la légitimité : expédier des logiciels malveillants qui semblent provenir d'un développeur de confiance. Les systèmes d'identification des développeurs et de notarisation d'Apple existent précisément parce que les utilisateurs ont besoin d'un moyen de distinguer les logiciels Mac légitimes des installateurs altérés ou falsifiés distribués en dehors de l'App Store. (openai.com)

C'est pourquoi cet incident mérite plus qu'un simple résumé de l'actualité. L'avis d'OpenAI est utile, mais il est intentionnellement limité. Il indique aux utilisateurs ce qui s'est passé, ce qui ne s'est pas passé et ce qu'ils doivent faire ensuite. Il ne s'agit pas d'un essai technique complet expliquant pourquoi une dépendance npm empoisonnée dans un flux de travail de signature modifie le modèle de menace, comment la chaîne de confiance d'Apple façonne la remédiation, ou ce que les équipes de CI et de publication devraient changer après l'avoir lu. Ce sont ces lacunes qui importent aux ingénieurs en sécurité, aux membres des équipes rouges, aux responsables de la sécurité applicative, aux ingénieurs de mise en production et à tous ceux qui expédient des logiciels de bureau ou des binaires hautement fiables. (openai.com)

L'incident plus large donne à la divulgation de l'OpenAI sa véritable signification technique. Google Threat Intelligence Group a déclaré qu'entre 00:21 et 03:20 UTC le 31 mars 2026, un attaquant a introduit une dépendance malveillante nommée plain-crypto-js dans les versions 1.14.1 et 0.30.4 d'Axios. Google a décrit la dépendance comme un dropper obscurci qui a déployé la porte dérobée WAVESHAPER.V2 sur Windows, macOS et Linux. Microsoft a rapporté indépendamment que les versions malveillantes d'Axios étaient 1.14.1 et 0.30.4, qu'elles se connectaient à une infrastructure contrôlée par l'attaquant et que la charge utile installait un RAT de deuxième niveau sur les systèmes affectés. Google a attribué l'activité à UNC1069, tandis que Microsoft a attribué l'infrastructure et la compromission à Sapphire Sleet. Cette différence de dénomination est normale dans le domaine du renseignement sur les menaces ; les fournisseurs suivent souvent le même groupe sous des étiquettes différentes. Ce qui importe, c'est l'image technique commune : des versions de paquets malveillants sont entrées dans le registre, du code installé a été exécuté sur les systèmes des victimes et les environnements en aval ont été exposés. (Google Cloud)

La divulgation d'OpenAI place son propre impact dans cette chronologie plus large. La société a déclaré que le 31 mars 2026 UTC, un flux de travail GitHub Actions utilisé dans le processus de signature des applications macOS a téléchargé et exécuté Axios 1.14.1. Ce flux de travail avait accès au certificat et au matériel de notarisation utilisés pour signer ChatGPT Desktop, Codex App, Codex CLI et Atlas sur macOS. OpenAI a également déclaré que son analyse interne a conclu que le certificat de signature était probablement pas Il n'a pas été possible de déterminer si le certificat avait été exfiltré avec succès, en fonction du moment de l'exécution de la charge utile, du moment de l'injection du certificat dans le travail, de l'enchaînement du travail lui-même et d'autres facteurs d'atténuation. Malgré cela, l'entreprise a considéré le certificat comme compromis et l'a remplacé. Cette combinaison de déclarations est exactement ce à quoi ressemble une réponse mature à un incident lorsque la chose potentiellement exposée est une ancre de confiance. (openai.com)

Compromission de l'outil de développement d'Axios, ce qu'OpenAI a confirmé et ce qu'elle n'a pas confirmé

Avant de se pencher sur les leçons à tirer de la chaîne d'approvisionnement, il convient de préciser les faits qu'OpenAI a effectivement confirmés. L'entreprise a déclaré avoir trouvé aucune preuve Elle n'a pas déclaré que les données des utilisateurs d'OpenAI avaient été consultées, que ses systèmes ou sa propriété intellectuelle avaient été compromis ou que son logiciel avait été modifié. Elle a également déclaré que les mots de passe et les clés API d'OpenAI n'avaient pas été affectés, que l'incident n'avait touché que les applications macOS d'OpenAI et qu'il n'avait pas affecté les versions web du logiciel d'OpenAI ou d'autres plateformes clientes telles que iOS, Android, Linux ou Windows. Ce champ d'application est plus restreint que ne le pensaient de nombreux lecteurs lorsque la nouvelle s'est répandue pour la première fois. (openai.com)

L'OpenAI a également déclaré qu'elle n'avait trouvé aucune preuve que des logiciels malveillants avaient été signés en tant que logiciels de l'OpenAI, et aucune preuve que le matériel de notarisation et de signature de code potentiellement exposé avait été utilisé à mauvais escient. Elle a examiné les événements de notarisation liés au matériel affecté et a déclaré que ces événements étaient attendus. Ce point est important car les défenseurs doivent éviter de passer de "un flux de travail de signature a été exposé" à "des binaires signés malveillants circulent déjà". OpenAI n'a pas prétendu que cela s'était produit. Elle a explicitement dit le contraire, tout en obligeant les utilisateurs à passer à un nouveau chemin de confiance. (openai.com)

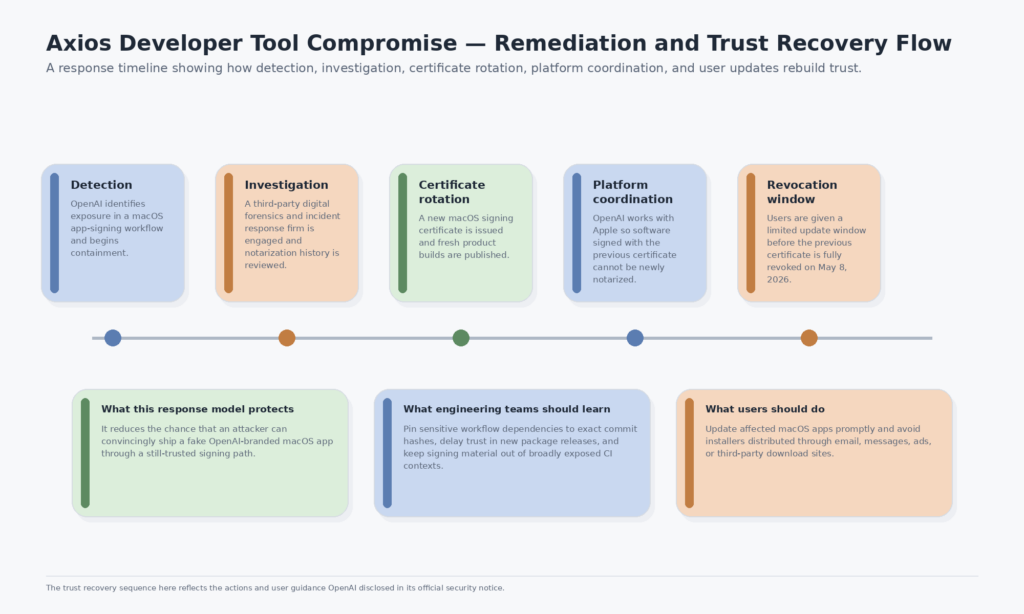

L'exigence de mise à jour n'était pas symbolique. OpenAI a listé les premières versions de macOS signées avec le certificat mis à jour : ChatGPT Desktop 1.2026.051, Codex App 26.406.40811, Codex CLI 0.119.0 et Atlas 1.2026.84.2. Elle indique également qu'à compter du 8 mai 2026, les anciennes versions de ces applications de bureau macOS ne recevront plus de mises à jour ni de support et risquent de ne plus être fonctionnelles. Il s'agit là d'une mesure classique de nettoyage post-rotation : éloigner les utilisateurs de l'ancien chemin des certificats, réduire la surface d'attaque résiduelle et aligner la politique d'assistance sur la nouvelle frontière de confiance. (openai.com)

Ce qu'a fait OpenAI pas est tout aussi important. Elle n'a pas publié de détails médico-légaux sur l'environnement d'exécution exact, le flux de travail YAML complet, la durée de vie du certificat ou le contrôle précis qui a empêché l'exfiltration probable. Cette omission est raisonnable dans un avis d'incident public. Mais cela signifie que la communauté des ingénieurs doit déduire la leçon plus générale de la combinaison de la déclaration d'OpenAI, du modèle de confiance d'Apple, des conseils de GitHub sur la sécurité des actions et du rapport plus large d'Axios sur la chaîne d'approvisionnement. (openai.com)

Attaque de la chaîne d'approvisionnement d'Axios, ce qui s'est passé à npm

L'incident OpenAI n'a de sens que si l'on revient à l'événement npm. Google Threat Intelligence Group a déclaré que l'attaquant a compromis le compte de maintenance associé à Axios, a changé l'adresse électronique du compte en une adresse contrôlée par l'attaquant, et a introduit les informations suivantes plain-crypto-js dans Axios 1.14.1 et 0.30.4 au cours d'une courte mais dangereuse fenêtre de publication, le 31 mars 2026. Google a également indiqué qu'Axios était alors l'une des bibliothèques JavaScript les plus utilisées pour les requêtes HTTP, les lignes affectées recevant respectivement plus de 100 millions et 83 millions de téléchargements hebdomadaires. C'est à cette échelle que les compromis de l'écosystème des paquets sont si attrayants : une brèche réussie en amont peut avoir une portée énorme en aval. (Google Cloud)

L'article de Microsoft précise les risques liés à l'installation. Il indique que les versions malveillantes du paquet se connectent à un C2 contrôlé par l'attaquant pour récupérer un cheval de Troie d'accès à distance de deuxième niveau, et que tous les projets résolvant des versions d'Axios supérieures à ^1.14.0 ou ^0.30.0 pouvait se connecter à cette infrastructure pendant l'installation et télécharger des logiciels malveillants de deuxième niveau. Microsoft a demandé aux utilisateurs qui avaient installé Axios 1.14.1 ou 0.30.4 de transférer immédiatement les secrets et les informations d'identification et de rétrograder vers des versions sûres. Ce langage est beaucoup plus fort qu'un avis de dépendance de routine, car il traite les hôtes affectés comme des systèmes potentiellement compromis, et non comme de simples environnements de construction à version erronée. (microsoft.com)

Le COI de Google et les détails sur les logiciels malveillants rendent le danger concret. Ils décrivent les sfrclak[.]com le domaine IP 142.11.206.73Il décrit des comportements spécifiques au système d'exploitation, notamment l'exécution d'AppleScript et la signature ad hoc sur macOS. Il décrit le comportement spécifique au système d'exploitation, y compris l'exécution d'AppleScript et la signature ad hoc sur macOS. Cela nous rappelle que la compromission des paquets lors de l'installation n'est pas une catégorie abstraite de la chaîne d'approvisionnement. Il s'agit d'une livraison de logiciels malveillants exécutables contre les environnements qui récupèrent et construisent les logiciels. (Google Cloud)

C'est là que beaucoup de résumés superficiels échouent. Ils s'arrêtent à "Axios a été compromis" et passent à autre chose. Or, l'histoire la plus importante est celle de la manière dont la compromission s'est produite. Dans un environnement, le paquet malveillant peut n'atteindre qu'un seul ordinateur portable de développeur avec des secrets limités. Dans un autre, il peut s'exécuter à l'intérieur d'une tâche CI avec des secrets de dépôt, des jetons de déploiement dans le nuage, des informations d'identification pour la publication de paquets ou des clés de signature. La version du paquet est la même. Le rayon d'action n'est pas le même. Cette différence est exactement la raison pour laquelle l'avis d'OpenAI est plus qu'un simple avis de victime en aval. Il révèle qu'une phase de publication de haute confiance était en cours. (openai.com)

Google a également placé la compromission d'Axios dans un contexte plus large. Il a indiqué que UNC6780, également connu sous le nom de TeamPCP, avait récemment empoisonné des actions GitHub et des paquets PyPI liés à des projets tels que Trivy, Checkmarx et LiteLLM, et a averti que le nombre croissant de secrets volés dans le cadre de ces campagnes pourrait entraîner d'autres attaques de la chaîne d'approvisionnement, des compromissions SaaS, des ransomwares et des extorsions, ainsi que des vols de crypto-monnaies. Ce contexte plus large est important car il montre que les défenseurs ne devraient pas considérer l'événement d'Axios comme un cas unique et étrange affectant uniquement les paquets JavaScript. Il s'inscrit dans une période active au cours de laquelle la confiance dans le CI/CD, la confiance dans le registre et la confiance dans les versions sont toutes ciblées. (Google Cloud)

Pourquoi le processus de signature modifie-t-il le risque ?

L'annonce d'OpenAI devient plus facile à comprendre une fois que l'on sépare la compromission de la construction ordinaire de la compromission du processus de signature. Si un code de paquetage malveillant s'exécute dans un travail de test à faible privilège, l'attaquant peut voler tous les secrets que ce travail possède ou altérer les résultats éphémères. C'est une mauvaise chose, mais les dommages sont limités par les autorisations et les secrets de cette étape. Si le même code malveillant s'exécute dans une tâche qui signe un logiciel, l'attaquant peut être en mesure de voler le matériel qui indique aux systèmes d'exploitation des utilisateurs finaux que le logiciel est légitime. Il ne s'agit pas seulement d'un problème d'intégrité. Il s'agit d'un problème de confiance dans la distribution. (openai.com)

Le modèle de Developer ID et de notarisation d'Apple explique cette escalade. Apple explique que pour les logiciels distribués en dehors du Mac App Store, les développeurs utilisent un certificat Developer ID et soumettent le logiciel à la notarisation. La signature numérique des logiciels avec un Developer ID unique et l'inclusion d'un ticket de notarisation permettent à Gatekeeper de vérifier que le logiciel n'est pas un logiciel malveillant connu et qu'il n'a pas été altéré. Apple indique également que Gatekeeper aide à protéger les utilisateurs contre le téléchargement et l'installation de logiciels malveillants en vérifiant la présence d'un certificat Developer ID dans les applications distribuées en dehors du Mac App Store. Cela signifie que le chemin de signature est une frontière de sécurité dans l'expérience de confiance de l'utilisateur, et pas seulement un élément de la liste de contrôle de la version interne. (Développeur Apple)

Une fois que le code malveillant atteint un flux de travail porteur de certificat, la cible de l'attaquant peut passer de la compromission immédiate de l'hôte à l'usurpation d'identité en aval. Le résultat cauchemardesque n'est plus seulement "le programme de construction a été infecté", mais "le pirate peut produire des logiciels malveillants qui ressemblent à une construction légitime du fournisseur". Il devient "l'attaquant peut produire un logiciel malveillant qui ressemble à une version légitime du fournisseur". L'OpenAI elle-même le dit explicitement lorsqu'elle déclare que la mise à jour est nécessaire pour prévenir le risque, aussi improbable soit-il, que quelqu'un tente de distribuer une fausse application semblant provenir de l'OpenAI. Le mot clé est apparaît. La confiance est l'actif à risque. (openai.com)

C'est également la raison pour laquelle la déclaration d'OpenAI selon laquelle l'exfiltration a "probablement" échoué ne supprime pas la nécessité d'une rotation. Un jeton de nuage ayant fait l'objet d'une fuite peut parfois être invalidé avec un rayon d'action étroit. Un certificat de signature ou un chemin de notarisation potentiellement exposé implique la confiance de l'utilisateur dans la distribution du logiciel d'un fournisseur. Si vous avez tort et que le certificat a effectivement fui, le coût de l'inaction peut être bien plus élevé que le coût d'une rotation contrôlée. Dans les incidents liés à la confiance dans les logiciels, une "faible probabilité mais des conséquences importantes" suffisent souvent à justifier des mesures correctives énergiques. (openai.com)

C'est la même raison pour laquelle les défenseurs doivent penser différemment aux tâches de CI privilégiées. Les tâches de signature, de publication de paquets, de promotion d'artefacts, de marquage de versions et de déploiement ne sont pas simplement une autre partie du pipeline. C'est là que la confiance est amplifiée. Une mauvaise configuration inoffensive dans un flux de travail de test unitaire peut rester locale. La même erreur de configuration dans un processus de signature ou de publication peut devenir un événement de la chaîne d'approvisionnement pour chaque utilisateur ou client en aval. Les conseils de sécurité de GitHub reflètent ce point de vue lorsqu'ils avertissent que la compromission d'une seule action dans un flux de travail peut être très importante parce que l'action peut avoir accès à tous les secrets du référentiel et peut être en mesure d'utiliser les informations suivantes GITHUB_TOKEN pour écrire dans le référentiel. (Docs GitHub)

Apple Gatekeeper, Developer ID, et Notarization, pourquoi OpenAI a dû traiter cela comme un incident de confiance

Pour comprendre pourquoi OpenAI a travaillé avec Apple et pourquoi les mesures correctives ne se sont pas limitées à un nettoyage interne, il est utile de présenter le modèle d'Apple en langage clair. Un certificat Developer ID indique à macOS qu'un logiciel distribué en dehors de l'App Store provient d'un développeur identifié. La notarisation ajoute une couche supplémentaire : le logiciel est soumis à Apple, scanné et reçoit un ticket s'il passe le processus. Selon la documentation d'Apple, la notarisation permet de s'assurer que les logiciels signés par le Developer ID ont été vérifiés par Apple afin de détecter tout contenu malveillant. Ensemble, le Developer ID et la notarisation créent les signaux de confiance que de nombreux utilisateurs considèrent comme "ceci ressemble à un vrai logiciel Mac". (Développeur Apple)

Cela ne signifie pas que les logiciels signés ou notariés sont magiquement sûrs pour toujours. Cela signifie que macOS dispose d'une base plus solide pour décider si le logiciel provient de l'éditeur déclaré et s'il a passé les contrôles d'Apple au moment de la notarisation. Si le certificat sous-jacent ou le chemin de notarisation est exposé, le problème du défenseur devient d'empêcher tout abus futur de ce matériel de confiance tout en préservant les mises à jour légitimes des utilisateurs suffisamment longtemps pour les migrer vers un nouveau certificat. La FAQ d'OpenAI rend cette logique exceptionnellement claire. L'entreprise a indiqué qu'elle s'efforçait de bloquer toute notarisation ultérieure des applications macOS avec le matériel affecté, de sorte qu'une application frauduleuse utilisant le certificat affecté n'aurait pas de notarisation et serait donc bloquée par défaut par les protections de sécurité macOS, à moins qu'un utilisateur ne les ait explicitement contournées. (openai.com)

Cela explique deux décisions que certains lecteurs ont trouvées étranges. La première est de savoir pourquoi OpenAI s'est coordonnée avec Apple au lieu de simplement déployer de nouveaux binaires. La réponse est que le système de confiance de la plateforme fait partie de la solution. La seconde est la raison pour laquelle OpenAI n'a pas immédiatement fait échouer toutes les anciennes versions Mac le même jour. La FAQ indique qu'une révocation immédiate pourrait entraîner le blocage d'anciennes applications légitimes lors de leur téléchargement ou de leur premier lancement ; OpenAI a donc utilisé une fenêtre temporelle tout en surveillant les abus. En d'autres termes, la réponse a permis d'équilibrer la confiance dans la plateforme, la continuité pour l'utilisateur final et la prévention des abus. Il s'agit d'une décision opérationnelle déterminée par le modèle de distribution d'Apple, et non par des slogans généraux de réponse aux incidents. (openai.com)

Les directives d'Apple sur les certificats expliquent également pourquoi la rotation est importante, même lorsque l'expiration n'est pas en cause. Apple note que si un certificat Developer ID était valide lors de la compilation d'une application, les utilisateurs peuvent toujours télécharger et exécuter l'application après la date d'expiration du certificat, mais les développeurs ont besoin d'un nouveau certificat pour signer les mises à jour et les nouvelles applications. Cette distinction n'est pas identique à un scénario de compromission, mais elle montre comment les logiciels distribués existants et les futures mises à jour signées occupent des états de confiance différents. La stratégie de rotation d'OpenAI suit cette division : préserver suffisamment de continuité pour déplacer les utilisateurs, mais transférer toute la confiance future vers le nouveau matériel. (Développeur Apple)

Une façon utile d'envisager la chaîne de confiance est d'en séparer les couches :

| Couche | Ce qu'il fait | Pourquoi c'est important ici |

|---|---|---|

| Certificat d'identification du développeur | Identifie le développeur pour les logiciels distribués en dehors de l'App Store | L'exposition potentielle pourrait permettre à de faux logiciels de paraître légitimes aux yeux d'un éditeur. |

| Billet de notaire | Signale un logiciel scanné par Apple pour Gatekeeper | Le fait de bloquer les nouvelles notarisations avec du matériel impacté réduit le potentiel d'abus |

| Gardien | Contrôles de confiance lorsque les utilisateurs ouvrent des logiciels Mac téléchargés | Limite par défaut l'exécution d'un programme d'installation non signé ou non fiable |

| Rotation des certificats | Déplacement des futures versions vers un nouveau matériel de confiance | Empêche les futures mises à jour de s'appuyer sur du matériel potentiellement exposé |

| Fenêtre de mise à jour de l'utilisateur | Migration des utilisateurs réels vers des versions nouvellement signées | Réduit les perturbations en fermant l'ancien chemin de confiance |

Les définitions de ce tableau suivent la documentation d'Apple sur l'identifiant du développeur et la notarisation, ainsi que la description de la voie de remédiation d'OpenAI. (openai.com)

Pourquoi OpenAI a fait pivoter le certificat même sans preuve d'exfiltration

L'une des parties les plus instructives de l'avis d'OpenAI est sa logique de risque. La société a déclaré que le certificat de signature était vraisemblablement n'ont pas été exfiltrés avec succès en raison de facteurs temporels et séquentiels. De nombreuses organisations s'arrêteraient là, pousseraient un soupir de soulagement et renforceraient tranquillement leurs contrôles internes. OpenAI a fait le contraire. Elle a fait l'hypothèse la plus prudente et a tout de même procédé à une rotation. Ce n'est pas une réaction excessive. C'est le bon parti à prendre lorsque l'actif potentiellement exposé est une ancre de confiance dont l'utilisation abusive affecterait les utilisateurs finaux et la confiance dans la marque au niveau de la couche de distribution du logiciel. (openai.com)

En matière de réponse aux incidents, la bonne question n'est pas "Qu'espérons-nous qu'il se soit passé ?" mais "Que devons-nous supposer pour éviter le résultat le plus important ?" Si un pirate a pu voir un secret de faible valeur, vous pouvez souvent attendre une preuve plus solide. Si un attaquant a pu voir un certificat ou un document notarié utilisé pour affirmer la légitimité d'un produit, attendre est un pari beaucoup plus risqué. Le système de confiance lui-même est une chose incertaine. Cela change le calcul. (openai.com)

Les actions publiées par OpenAI prennent tout leur sens dans ce contexte. Elle a fait appel à une société tierce d'investigation numérique et de réponse aux incidents, a changé le certificat de signature du code macOS, a publié de nouvelles versions des produits concernés, a travaillé avec Apple pour que les logiciels signés avec le certificat précédent ne puissent pas être nouvellement notariés, et a examiné les enregistrements de notarisation liés au certificat précédent. Chaque action correspond à une incertitude spécifique : ce qui s'est passé, ce qui a pu être exposé, quels logiciels futurs pourraient encore être fiables, quels logiciels déjà publiés doivent être remplacés et si des abus ont déjà eu lieu. Il s'agit d'une réponse plus propre que "nous avons changé les secrets", car elle s'étend sur l'enquête, la coordination de la plateforme, la migration de la confiance et la vérification. (openai.com)

La chronologie ci-dessous montre comment l'événement s'est déroulé, de la compromission du registre à la migration de la confiance :

| Date | Événement | Pourquoi c'est important |

|---|---|---|

| 31 mars 2026 | Les versions malveillantes d'Axios 1.14.1 et 0.30.4 ont été publiées dans npm avec plain-crypto-js | Début du compromis sur le paquet amont |

| 31 mars 2026 | OpenAI affirme que son processus de signature pour macOS a téléchargé et exécuté Axios 1.14.1. | Le pipeline de rejet en aval entre dans le rayon d'action de l'explosion |

| Après analyse interne | OpenAI conclut que l'exfiltration n'a probablement pas abouti, mais considère que le certificat est tout de même compromis. | Un actif de grande importance suscite une réaction prudente |

| 10 avril 2026 | L'OpenAI publie un avis public et des conseils de mise à jour | Début de la migration de la confiance des utilisateurs finaux |

| 8 mai 2026 | Les anciennes versions des applications Mac ne reçoivent plus de mises à jour ni d'assistance et peuvent cesser de fonctionner. | Le chemin de confiance précédent est supprimé |

Les dates et les étapes du produit figurant dans ce tableau proviennent de l'avis d'OpenAI, du rapport d'incident de Google et de l'article de Microsoft sur les publications malveillantes d'Axios. (openai.com)

Les utilisateurs d'OpenAI et les utilisateurs d'Axios ne constituent pas le même public pour la réponse aux incidents

L'une des principales sources de confusion après la divulgation a été la tendance à traiter chaque lecteur comme s'il était exposé de la même manière. Ce n'est pas le cas. Il y a au moins deux publics matériellement différents.

Le premier public est l'utilisateur ordinaire d'OpenAI sous macOS. Pour cette personne, la lecture correcte de l'avis est simple : mettez à jour l'application actuelle via la mise à jour in-app ou les liens de téléchargement officiels, évitez les installateurs tiers et ne supposez pas que les informations d'identification de votre compte ont été compromises simplement parce qu'un avis de sécurité mentionne un flux de travail de signature de code. OpenAI indique explicitement que les mots de passe et les clés API n'ont pas été affectés, que le problème ne concerne que les applications macOS et que les utilisateurs doivent éviter les programmes d'installation provenant d'e-mails, de messages, de publicités, de liens de partage de fichiers ou de sites de téléchargement tiers. (openai.com)

Le deuxième public est l'équipe de développement ou de sécurité qui peut avoir installé ou construit avec les versions malveillantes d'Axios dans son propre environnement. Cette équipe doit réagir de manière beaucoup plus agressive. Microsoft conseille de procéder immédiatement à la rotation des secrets et des informations d'identification et de rétrograder vers des versions sûres. Les conseils de Google vont plus loin en traitant les hôtes affectés comme potentiellement compromis, en recommandant des audits de l'arbre des dépendances, des pauses de déploiement CI/CD pour les paquets affectés, l'isolation de l'hôte, la rotation des secrets et la chasse IOC contre le domaine de l'attaquant, les IP, les hachages et les modèles YARA. C'est très différent du parcours de l'utilisateur final de l'OpenAI. (microsoft.com)

Une simple matrice permet de clarifier la répartition :

| Public | Ce qui est confirmé | Action immédiate | Ce qu'il ne faut pas supposer |

|---|---|---|---|

| Utilisateurs de l'application OpenAI pour macOS | L'exposition s'est produite dans le flux de travail de signature d'OpenAI, mais OpenAI n'a trouvé aucune preuve de compromission de données d'utilisateur ou d'utilisation abusive de logiciels malveillants signés. | Mettre à jour les versions nouvellement signées en utilisant les canaux officiels | Ne supposez pas que votre mot de passe OpenAI ou votre clé API a été volé. |

| Équipes ayant installé Axios 1.14.1 ou 0.30.4 | Les paquets malveillants ont récupéré des logiciels malveillants de second niveau sur les hôtes concernés. | Traiter les hôtes comme des suspects, faire tourner les secrets, rétrograder, chasser les COI, vérifier l'historique des CI | Ne considérez pas ceci comme une erreur de routine dans la correction des bogues de Semver. |

| Ingénieurs de mise en production et de CI | Les flux de travail de grande valeur amplifient le rayon d'explosion si un code non fiable s'y exécute. | Réexaminer les tâches de signature, de publication et de déploiement en tant que limites de confiance | Il ne faut pas croire que les catégories "compromission de l'IC" et "compromission de la confiance du client" sont distinctes. |

Le tableau ci-dessus est tiré de la FAQ d'OpenAI et des directives publiques sur les incidents de Google et de Microsoft. (openai.com)

Comment auditer votre environnement pour l'attaque de la chaîne d'approvisionnement d'Axios

Si votre organisation utilise des systèmes de construction JavaScript ou Node, la première priorité est de rassembler des preuves, et non de débattre de la probabilité que le chemin exact de votre projet ait été emprunté. Vous voulez répondre rapidement à quatre questions. Est-ce qu'un fichier de verrouillage ou un arbre de dépendance a résolu Axios 1.14.1 ou 0.30.4. Est-ce qu'un environnement contient plain-crypto-js. Est-ce qu'une construction ou un poste de travail a communiqué avec l'infrastructure connue de l'attaquant. Et est-ce qu'un travail d'IC de grande valeur a été exécuté pendant la période concernée avec des secrets, du matériel de signature ou des identifiants de publication dans le champ d'application. Ces questions correspondent directement aux conseils publics de Google et de Microsoft en matière de remédiation (microsoft.com)

Commencez par des recherches dans les dépôts et les fichiers de verrouillage. Cela ne suffit pas à éliminer un hôte, mais c'est un moyen rapide d'identifier les projets qui nécessitent un examen plus approfondi.

rg -n '"axios"\s*:\s*"1\.14\.1"|"axios"\s*:\s*"0\.30\.4\"|plain-crypto-js" \N - \N

package-lock.json pnpm-lock.yaml yarn.lock bun.lockb . -g '!node_modules'

Cette recherche vise les versions et les dépendances malveillantes identifiées publiquement par Google et Microsoft. Si elle aboutit, la question suivante n'est pas seulement "Pouvons-nous mettre à jour ?" mais "Où cela a-t-il été résolu et exécuté ?" car la même chaîne de version a des conséquences très différentes selon qu'il s'agit du bac à sable d'un ordinateur portable jetable ou d'une tâche de construction privilégiée. (microsoft.com)

Inspectez ensuite l'arbre de dépendance résolu dans les environnements encore disponibles.

npm ls axios plain-crypto-js || true

pnpm why axios || true

bun pourquoi axios || true

Ces commandes permettent d'établir si Axios était présent directement ou de manière transitoire. Elles ne prouvent pas l'état historique de l'installation si l'environnement a déjà changé, et elles ne vous sauveront pas si le runner ou le poste de travail concerné était éphémère et a déjà été détruit. Mais ils sont toujours utiles pour le triage et le cadrage. L'outil de dépendance de Bun et le modèle centré sur le fichier de verrouillage de pnpm nous rappellent également que le choix du gestionnaire de paquets affecte la facilité avec laquelle il est possible de raisonner sur les installations passées après un incident. (brioche.com)

Pour les fichiers de verrouillage, jq peut être utile sur package-lock.json lorsque vous souhaitez un résultat structuré au lieu de correspondre à des expressions rationnelles.

jq -r '

.. | objets

| select(has("version") and has("resolved") | not)

| select(.version == "1.14.1" ou .version == "0.30.4")

' package-lock.json

Ceci n'est pas universel pour tous les formats de fichiers de verrouillage, et ne dit rien sur la présence de plain-crypto-js si le paquet a ensuite été retiré de votre environnement. Mais pour les dépôts qui conservent les lockfiles sous contrôle de version, cela peut rapidement vous indiquer si un projet a épinglé ou résolu l'une des versions malveillantes. Google recommande spécifiquement d'auditer les arbres de dépendance et d'inspecter les éléments suivants plain-crypto-js. (Google Cloud)

Après la délimitation du champ d'application au niveau du paquet, il faut passer aux preuves relatives au réseau et à l'exécution. Google a publié le domaine sfrclak[.]com, le C2 IP 142.11.206.73et des indicateurs de fichiers multiples. Si vous disposez d'EDR, de journaux DNS, de journaux proxy, de télémétrie réseau provenant de build runners ou de l'historique des shells des systèmes de développement, recherchez immédiatement ces indicateurs.

# Exemple de triage de l'historique du shell sous Linux ou macOS

grep -R "sfrclak\c.com\c|142\c.11\c.206\c.73" ~/.zsh_history ~/.bash_history 2>/dev/null

# Exemple de recherche d'artefacts locaux

find /tmp /var/tmp /Library/Caches -type f 2>/dev/null | grep -E 'com\a.apple\a.act\a.mond|plain-crypto-js'

Ces exemples sont volontairement simples. Les entreprises réelles devraient préférer l'EDR, les journaux centralisés et la collecte médico-légale aux recherches ad hoc dans le shell. Le point important est que Google a explicitement fourni du matériel IOC et YARA, ce qui signifie que les équipes n'ont pas besoin d'inventer une stratégie de détection à partir de zéro. (Google Cloud)

Si un programme de construction, un hôte de développement ou une machine de signature a résolu les versions malveillantes, la solution la plus sûre est de considérer cet hôte comme suspect et de procéder à la rotation des secrets qui s'y trouvaient. Microsoft a explicitement conseillé la rotation immédiate des secrets et des informations d'identification pour les utilisateurs qui ont installé les versions malveillantes d'Axios. De même, Google a conseillé que si plain-crypto-js est détecté, les défenseurs doivent supposer que l'environnement est compromis, revenir à un état connu et changer toutes les informations d'identification ou les secrets présents sur cette machine. C'est la bonne attitude à adopter, car le rapport public décrit un RAT de deuxième niveau, et non une balise de télémétrie inoffensive. (microsoft.com)

Si vous êtes responsable de l'IC, ajoutez une couche supplémentaire d'examen : reconstituez les flux de travail à forte valeur ajoutée qui se sont déroulés pendant la fenêtre d'exposition. Quels travaux pouvaient publier des paquets, signer des binaires, créer des versions, télécharger des artefacts ou déployer en production. Lesquels de ces travaux ont tiré des dépendances fraîches au lieu de consommer des artefacts verrouillés. Lesquels utilisaient des informations d'identification dans le nuage à longue durée de vie, des certificats ou des jetons à échelle humaine. Le cas de l'OpenAI montre pourquoi cela est important. Un paquet empoisonné dans un flux de travail de test générique et le même paquet empoisonné dans un flux de travail de signature sont des incidents différents, même si la compromission du registre est identique. (openai.com)

Renforcer les actions GitHub après la compromission de l'outil de développement d'Axios

Le guide de sécurité des actions de GitHub est inhabituellement direct sur le premier contrôle qui importe ici : épingler les actions à un commit SHA complet. GitHub explique que c'est actuellement le seul moyen d'utiliser une action comme une version immuable, et que l'épinglage aide à atténuer le risque qu'un mauvais acteur ajoute une porte dérobée au dépôt de l'action. Il prévient également que la compromission d'une seule action au sein d'un flux de travail peut être très importante, car l'action peut avoir accès aux secrets du référentiel et à la base de données. GITHUB_TOKEN. Le résumé public des causes profondes d'OpenAI est conforme à ces conseils, car il indique que l'action concernée a utilisé une balise flottante au lieu d'un hachage de validation spécifique. (Docs GitHub)

Ce point est facile à répéter et facile à sous-exécuter. De nombreuses équipes n'épinglent que les actions tierces les plus évidentes et ignorent les flux de travail réutilisables, les aides à l'installation, les aides à la mise en production ou les enveloppes internes qui récupèrent transitoirement du code externe. La documentation de GitHub clarifie le modèle général : si vous référencez des flux de travail réutilisables par un commit SHA, la réutilisation devient stable et révisable ; si vous référencez une balise ou une branche, vous faites confiance à cette référence mutable dans le temps. En termes de sécurité, cela signifie que les balises et les branches ne sont pas seulement des commodités de version. Ce sont les limites de la chaîne d'approvisionnement. (Docs GitHub)

Un processus de signature ou de libération renforcé devrait ressembler à ce qui suit :

nom : macos-release

on :

workflow_dispatch :

push :

tags :

- "v*"

permissions :

contents : read

id-token : write

jobs :

build :

runs-on : macos-latest

steps :

- uses: actions/checkout@8ade135a41bc03ea155e62e844d188df1ea18608

- uses: actions/setup-node@60edb5dd545a775178f52524783378180af0d1f8

avec :

node-version : "22"

- exécute : npm ci

sign-and-release :

besoins : build

fonctionne sur : macos-latest

environnement : production-release

steps :

- uses: actions/checkout@8ade135a41bc03ea155e62e844d188df1ea18608

- name : Authentification au KMS en nuage avec OIDC

run : ./scripts/oidc-login.sh

- name : Signer l'artefact

Exécution : ./scripts/sign-macos.sh

- name : Publier une version

Exécution : ./scripts/release.sh

Cet exemple est illustratif, il ne s'agit pas d'un flux de travail de production. Les choix de conception sont les mêmes : des SHA de livraison complets, des permissions réduites pour les jetons, un environnement de publication séparé et l'OIDC au lieu d'informations d'identification à long terme dans le nuage lorsque c'est possible. GitHub recommande explicitement l'épinglage SHA et recommande également OIDC afin que les flux de travail puissent cesser de stocker des secrets cloud à longue durée de vie. (Docs GitHub)

L'OIDC est important car chaque secret à longue durée de vie présent dans un travail de CI privilégié augmente la valeur de ce travail pour un attaquant. La documentation de GitHub indique que l'OIDC permet aux flux de travail d'accéder aux ressources en nuage sans avoir à stocker des secrets de nuage à longue durée de vie dans GitHub, et que cela offre des avantages en termes de sécurité. Cela ne rend pas inoffensif un flux de travail compromis. Un jeton à courte durée de vie frappé pour le travail peut toujours être utilisé abusivement pendant sa durée de vie. Mais cela réduit la valeur du vol de secrets dans l'environnement par rapport à la récolte d'informations d'identification larges et durables qui restent valables longtemps après la fin du flux de travail. (Docs GitHub)

Le choix du runner est également important. Le guide d'utilisation sécurisée de GitHub indique que les runners hébergés par GitHub s'exécutent dans des machines virtuelles éphémères, propres et isolées, tandis que les runners auto-hébergés n'ont pas ces garanties et peuvent être compromis de manière persistante par du code non fiable dans un flux de travail. Cet avertissement devient beaucoup plus important lorsque vous commencez à discuter des compromissions de paquets et des actions empoisonnées. Une dépendance malveillante exécutée sur un runner auto-hébergé peut hériter de résidus provenant de travaux antérieurs, de caches locaux, d'infrastructures attachées ou de réseaux internes qui n'existeraient tout simplement pas sur un runner fraîchement hébergé. (Docs GitHub)

Plus le privilège du travail est élevé, plus il est utile de diviser les rôles et de réduire les fenêtres d'exposition. Les documents à signer ne doivent pas rester dans des contextes de flux de travail généraux qui récupèrent également du code tiers frais. Dans la mesure du possible, les tâches de mise en production doivent être séparées des tâches de construction générale. Les approbations d'environnement et les environnements protégés doivent être utilisés pour les flux de travail qui peuvent déployer ou signer. GITHUB_TOKEN devraient être définies explicitement plutôt que d'être laissées larges par défaut. Aucun de ces contrôles ne fera disparaître les paquets Axios malveillants, mais ensemble, ils réduisent ce qu'une compromission réussie peut réellement toucher. Le modèle de sécurité de GitHub est construit autour de ce principe : compromettre l'impact d'une action, puis réduire les permissions et les secrets disponibles. (Docs GitHub)

L'âge minimum de libération, l'importance de la note sur les causes profondes de l'OpenAI

Une petite phrase de l'avis d'OpenAI mérite plus d'attention qu'elle n'en a reçu. L'entreprise a déclaré que l'action concernée n'était pas configurée. âge minimum de libération pour les nouveaux paquets. Cela semble être un problème mineur de réglage du gestionnaire de paquets jusqu'à ce que vous compreniez l'idée de sécurité qui se cache derrière.

La logique de base est simple. De nombreux paquets malveillants sont détectés rapidement après leur publication. Si votre logique d'installation refuse de consommer des paquets qui ont été publiés il y a seulement quelques minutes ou quelques heures, vous donnez à l'écosystème le temps de détecter, de signaler et de supprimer les téléchargements malveillants évidents avant qu'ils ne pénètrent dans votre environnement. Le guide de sécurité de la chaîne d'approvisionnement de la PNPM indique qu'en retardant les mises à jour de 24 heures, vous éviterez très probablement d'installer une mauvaise version, et définit âge minimum de libération comme le nombre de minutes qui doivent s'écouler après la publication d'une version avant que pnpm ne l'installe. Bun utilise un langage presque identique, en disant que vous pouvez configurer une exigence d'âge minimum pour que les versions de paquets récemment publiées soient filtrées lors de l'installation. (pnpm.io)

Ce contrôle n'est pas magique. Il s'agit d'un tampon temporel et non d'une garantie de provenance. Un attaquant patient peut attendre par la fenêtre. Une attaque sophistiquée de la chaîne d'approvisionnement peut cibler une cadence de mise à jour des dépendances ou maintenir une logique malveillante suffisamment longtemps pour survivre au refroidissement. Et si vous comptez sur les correctifs d'urgence de certains fournisseurs, une barrière d'âge générale peut s'avérer trop brutale. Mais pour la catégorie exacte d'événements représentée par la publication rapide de paquets malveillants, il s'agit d'une couche de friction significative. Le fait qu'OpenAI le mentionne suggère que l'entreprise considère le calendrier de publication comme une partie de la surface de défense, et pas seulement comme un épinglage de version. (openai.com)

Voici ce que cela donne en pratique avec pnpm :

# pnpm-workspace.yaml

minimumReleaseAge : 1440

minimumReleaseAgeExclude :

- typescript

- webpack

pnpm dit a âge minimum de libération de 1440 attend un jour avant d'installer une nouvelle version publiée, et sa documentation sur les paramètres prend également en charge les exclusions pour les paquets qui ont besoin d'une adoption plus rapide. Cela rend le contrôle utilisable dans des environnements réels plutôt que purement académiques. (pnpm.io)

Et voici la même idée avec Bun :

# bunfig.toml[installer]

minimumReleaseAge = 259200 minimumReleaseAgeExcludes = ["@types/node", "typescript"]

La documentation de Bun indique que la valeur est en secondes, que toutes les dépendances directes et transitives sont filtrées lors de la nouvelle résolution, et que les paquets récemment publiés peuvent être exclus de manière sélective. C'est un exemple concret d'un gestionnaire de paquets qui intègre les leçons de la chaîne d'approvisionnement dans son comportement lors de l'installation. (brioche.com)

Le point le plus important est que "ne pas utiliser la dernière version" n'est pas suffisant. De nombreuses équipes épinglent déjà des plages de semver mais autorisent toujours les rafraîchissements de lockfile ou les installations de CI à extraire la version la plus récente à une cadence régulière. L'âge minimum d'une version est une deuxième question après la correspondance des versions : même si une version est syntaxiquement acceptable, est-elle assez ancienne pour qu'on lui fasse confiance ? C'est un changement subtil mais important dans l'hygiène des paquets. (pnpm.io)

Publications immuables et attestations d'artefacts, des contrôles côté éditeur qui ont plus d'importance que ne le pensent la plupart des équipes

Les contrôles effectués par les consommateurs, tels que l'épinglage full-SHA et la limitation de l'âge de diffusion, ne représentent que la moitié du tableau. Les contrôles côté éditeur sont également importants, en particulier dans les écosystèmes où les balises, les actifs des versions ou les résultats de la construction constituent une surface de confiance normale. La fonction "immutable releases" de GitHub indique qu'une fois qu'une version est marquée comme immuable, ses actifs ne peuvent pas être ajoutés, modifiés ou supprimés, et les balises des nouvelles versions immuables sont protégées et ne peuvent pas être déplacées. GitHub dit explicitement que cela protège les artefacts distribués contre les attaques de la chaîne d'approvisionnement. (Le blog de GitHub)

C'est important, car les étiquettes mutables sont apparues à plusieurs reprises lors d'incidents réels. Si les consommateurs font confiance aux v1, v2ou d'autres balises mobiles, et qu'un compte de responsable ou un processus de publication est compromis, ces références peuvent devenir un mécanisme de diffusion d'attaques. Les versions immuables s'attaquent à ce problème du côté de l'éditeur en réduisant la possibilité de réécrire l'historique des versions après leur publication. Elles ne résolvent pas tous les scénarios de compromission, mais elles modifient le champ d'action de l'attaquant. (Le blog de GitHub)

Les attestations d'artefacts comblent une lacune différente mais connexe. Selon GitHub, les attestations d'artefacts créent un moyen vérifiable de relier les artefacts logiciels au code source et aux instructions de construction. En pratique, cela signifie que les consommateurs en aval et les équipes de publication internes peuvent se demander non seulement "Ai-je téléchargé les mêmes octets ?" mais aussi "Puis-je vérifier d'où viennent ces octets et comment ils ont été construits ?". Le support d'attestation de publication et les commandes de vérification de GitHub rendent cela de plus en plus pratique plutôt que théorique. (Le blog de GitHub)

Pour les équipes qui envoient des clients de bureau, des CLI, des actions GitHub ou d'autres artefacts hautement fiables, ces contrôles ne sont pas seulement un théâtre d'hygiène open source. Ils constituent la couche suivante après l'épinglage. L'épinglage dit "consommer une référence immuable". Les versions immuables disent "publier des références immuables". Les attestations disent "prouver que l'artefact provient de la version déclarée". Lorsque vous combinez ces contrôles avec le modèle de signature de code et de notarisation d'Apple, vous commencez à obtenir une histoire de confiance de bout en bout beaucoup plus solide. (Le blog de GitHub)

Voici un exemple minimal de vérification à l'aide de l'outil de vérification des versions de GitHub :

gh release verify v1.2.3

gh release verify-asset v1.2.3 myapp-macos-arm64.zip

La documentation de GitHub indique que les versions immuables reçoivent des attestations signées et peuvent être vérifiées avec GitHub CLI. Cela ne remplace pas votre propre pipeline de signature, mais ajoute une autre vérification entre la sortie de la compilation et la confiance en aval. (Le blog de GitHub)

Les CVE qui expliquent le schéma général

L'incident d'Axios n'a pas été classé comme un CVE de produit soigné, comme les défenseurs ont l'habitude de voir les vulnérabilités ordinaires. Mais si vous voulez comprendre sa forme de sécurité, deux CVE récents sont très pertinents.

Le premier est CVE-2025-30066, le tj-actions/changed-files Compromission de la chaîne d'approvisionnement des actions GitHub. NVD indique que le problème permet à des attaquants distants de découvrir des secrets en lisant les journaux d'action, et note explicitement que les tags v1 à travers v45.0.7 ont été affectées parce qu'elles ont été modifiées pour pointer vers un commit malveillant. Ceci est directement lié à l'histoire d'Axios et d'OpenAI parce qu'il démontre le coût de sécurité de la confiance dans les références mutables dans l'informatique décisionnelle. Le mécanisme est différent, mais la leçon est la même : si votre flux de travail consomme de l'automatisation tierce par le biais de références qui peuvent se déplacer, votre CI fait confiance à du code mutable. (nvd.nist.gov)

La condition d'exploitation de CVE-2025-30066 est également parfaitement compatible avec le durcissement de l'IC. La partie dangereuse n'était pas un bogue traditionnel de corruption de mémoire ou une faille d'application accessible à distance. Il s'agissait de la capacité à rediriger des références de flux de travail de confiance vers un code malveillant qui pouvait exposer des secrets dans les journaux. C'est la raison pour laquelle l'épinglage full-SHA apparaît si souvent dans les conseils de GitHub et qu'il devrait être traité comme une référence plutôt que comme un effort. Si une balise peut se déplacer, la relation de confiance est plus fragile que ne le pensent de nombreuses équipes. (nvd.nist.gov)

Le second est CVE-2024-3094NVD a découvert une porte dérobée, la porte dérobée XZ Utils. NVD indique que le code malveillant a été découvert dans les fichiers tarballs en amont à partir de la version 5.6.0, et qu'à travers un processus complexe de construction, la porte dérobée a extrait un fichier objet préconstruit à partir de données de test déguisées et a modifié le comportement de la bibliothèque au cours de la construction. La leçon à tirer n'était pas simplement que "xz avait un bogue". La leçon était que la chaîne d'approvisionnement en artefacts et le chemin de construction avaient été compromis. (nvd.nist.gov)

C'est pourquoi CVE-2024-3094 est à mettre sur le même plan que la compromission de l'outil de développement d'Axios. Dans les deux cas, l'attaquant a abusé de la confiance dans la distribution du logiciel et le matériel de construction plutôt que d'attaquer l'application finale de l'extérieur. Dans le cas de XZ, la logique malveillante se trouvait dans le matériel de distribution et s'est activée pendant la construction. Dans le cas d'Axios, la logique malveillante se trouvait dans le registre de distribution des paquets et a été activée pendant l'installation. Dans le cas en aval d'OpenAI, cette exécution pendant l'installation a atteint un flux de travail de signature. Mécanismes différents, même vérité stratégique : les chemins de construction et de distribution fiables sont des surfaces d'attaque privilégiées. (nvd.nist.gov)

Un tableau comparatif est utile à cet égard :

| Incident | Position d'attaque | Pourquoi c'est important pour cette histoire | Thème clé de l'atténuation |

|---|---|---|---|

| CVE-2025-30066 | Actions GitHub : confiance de référence et exposition des logs | Montre comment les références d'action mutables peuvent transformer l'IC en une voie de fuite secrète. | Épinglage Full-SHA, minimisation des jetons, examen du flux de travail |

| CVE-2024-3094 | Compromis d'artefact et de chemin de construction en amont | Cela montre qu'une publication de confiance peut être malveillante même si l'histoire de la source semble normale. | Contrôles de la provenance, vérification de la mise en circulation, création d'une ségrégation de la confiance |

| Compromis Axios 2026 | Compromission d'un paquet de registre par un logiciel malveillant installé au moment de l'installation | Montre comment les paquets empoisonnés peuvent atteindre les hôtes des développeurs, les CI et les flux de travail de signature. | Épinglage des versions sûres, contrôle de l'âge des versions, rotation des hôtes, isolation des flux de travail à haute valeur ajoutée |

La comparaison est basée sur les descriptions CVE de la NVD, les conseils de sécurité de GitHub et le rapport public sur l'incident d'Axios. (nvd.nist.gov)

Ce que ces incidents ont en commun est plus important que ce qui les différencie. Ils exploitent tous le fait que la confiance dans les logiciels modernes n'est pas un contrôle unique. Il s'agit d'une chaîne d'hypothèses à travers les registres, les mainteneurs, la résolution des paquets, les flux de travail réutilisables, les références des versions, les systèmes de construction, les systèmes de signature et la validation des points d'extrémité. Si un lien est à la fois fiable et faiblement contrôlé, les attaquants n'ont pas besoin d'un exploit logiciel classique. Ils peuvent suivre la voie normale du développement. (nvd.nist.gov)

Le modèle pratique de renforcement après un tel incident

Après un incident dans la chaîne d'approvisionnement, les équipes se concentrent souvent sur l'éradication et la rotation des secrets, ce qui est nécessaire. Mais la victoire la plus profonde en matière d'ingénierie vient de la modification de la manière dont la confiance est distribuée dans la chaîne d'approvisionnement.

Le premier principe de conception consiste à traiter les flux de travail à forte valeur ajoutée différemment des tâches de construction ordinaires. Si un travail signe du code, notarise un logiciel, publie des paquets, télécharge des actifs ou déploie des services de production, il ne devrait pas être l'endroit où l'environnement résout par hasard du code tiers frais avec des autorisations étendues. Ce principe découle directement de l'incident de l'OpenAI et de l'avertissement de GitHub concernant l'importance d'une action compromise au sein d'un flux de travail secret. (openai.com)

Le deuxième principe consiste à supposer que les références mutables ne constituent pas des limites de sécurité. Les étiquettes sont utiles pour les humains. Ils ne sont pas suffisants pour une automatisation privilégiée. GitHub affirme que l'épinglage SHA des livraisons complètes est le seul modèle de publication immuable pour les actions aujourd'hui, et le travail de GitHub sur l'immutabilité des publications est essentiellement une admission que l'écosystème a besoin de valeurs par défaut plus fortes du côté de la publication également. Si la sécurité de vos versions dépend encore de "personne ne déplacera jamais cette étiquette", vous faites plus confiance à une histoire de politique qu'à un contrôle technique. (Docs GitHub)

Le troisième principe consiste à réduire la valeur secrète au sein de l'infrastructure de communication. La documentation OIDC de GitHub est importante non pas parce qu'elle résout le problème de la compromission de la chaîne d'approvisionnement, mais parce qu'elle réduit les dommages à long terme en cas de compromission. Remplacer les secrets du nuage à longue durée de vie par des jetons fédérés à courte durée de vie ne sécurise pas les informations d'identification volées. Il le rend moins durable, moins réutilisable et plus facile à adapter étroitement au contexte du flux de travail. Dans le cadre d'un travail de confiance, il s'agit d'une amélioration majeure. (Docs GitHub)

Le quatrième principe consiste à raccourcir la confiance dans les paquets nouvellement publiés. L'âge minimum de publication est un exemple concret. Les registres internes avec approbation ou mise en quarantaine en sont un autre. Les flux de travail sécurisés des fichiers de verrouillage en sont un autre. Il ne s'agit pas de créer de la bureaucratie pour le plaisir. Le fait est qu'un nombre surprenant de compromissions réelles de paquets reposent sur le fait que la victime fait immédiatement confiance à une nouvelle version. Le temps peut être un contrôle de sécurité si vous l'utilisez intentionnellement. (pnpm.io)

Le cinquième principe consiste à vérifier les artefacts distribués, et pas seulement le code source. L'attestation d'artefacts et le travail de publication immuable de GitHub, le processus de notarisation d'Apple et les contrôles standard de verrouillage des paquets et de provenance sont tous des réponses au même problème structurel : les référentiels de sources, les actifs de publication, les versions du registre des paquets et les binaires finaux ne racontent pas toujours la même histoire, à moins que vous ne les y obligiez. C'est là le cœur de la défense de la chaîne d'approvisionnement moderne. (Le blog de GitHub)

Le problème de la vérification après l'incident

Beaucoup de comptes rendus d'incidents se terminent une fois que le paquet est déclassé et que les secrets sont retournés. C'est compréhensible, mais incomplet. Les équipes de sécurité n'ont pas seulement besoin de mesures correctives. Elles ont besoin de preuves que la voie dangereuse a été empruntée.

Dans le cas d'OpenAI, les questions qui se posaient après l'incident étaient évidentes. Toutes les applications macOS actives sont-elles désormais signées avec le nouveau certificat ? L'ancien certificat peut-il encore être utilisé pour les nouvelles notarisations ? Les événements de notarisation prévus ont-ils été examinés ? Les utilisateurs ne sont-ils poussés que par des voies de mise à jour légitimes ? Existe-t-il de faux installateurs qui exploitent la fenêtre de confusion. L'avis public d'OpenAI répond à certaines de ces questions à un niveau élevé, mais il s'agit exactement du type de questions que chaque organisation concernée devrait se poser sur ses propres surfaces de confiance après la compromission d'un pipeline. (openai.com)

C'est pourquoi la validation post-incident est une discipline différente de l'examen statique. Après un événement survenu dans la chaîne d'approvisionnement, les équipes doivent souvent vérifier non seulement qu'une version vulnérable a disparu du contrôle des sources, mais aussi que le chemin d'exécution dangereux a disparu dans la pratique, que les anciennes voies de diffusion ne peuvent pas être utilisées abusivement, que les surfaces de téléchargement et de mise à jour externes se comportent comme prévu, et que les preuves sont suffisamment solides pour satisfaire les parties prenantes internes, les auditeurs et les clients. Ce travail implique généralement des tests contradictoires plutôt qu'un simple inventaire passif. (Docs GitHub)

C'est l'un des rares endroits où une petite mention de Penligent est naturelle plutôt que forcée. La page d'accueil publique de Penligent présente sa plateforme autour de chaînes d'attaques vérifiées, de résultats de premier niveau, de conclusions reproductibles et de rapports exportables pour les ingénieurs en sécurité et les équipes rouges. La rédaction de sa propre chaîne d'approvisionnement se concentre également sur les mêmes contrôles pratiques exposés par ces incidents, y compris les références immuables, les jetons CI surpuissants et la différence entre une découverte normale et un chemin d'impact vérifié. En d'autres termes, la valeur dans ce contexte n'est pas "l'IA résumant un CVE". Il s'agit d'utiliser l'automatisation pour retester les chemins externes ou adjacents au flux de travail à risque et de produire des preuves que le chemin dangereux ne se reproduit plus. (penligent.ai)

C'est la leçon la plus importante que l'on peut tirer de cet événement. Un incident dans la chaîne d'approvisionnement n'est pas complètement clos lorsque le mauvais paquet disparaît. Il est clos lorsque l'organisation peut montrer que la frontière de confiance qui a échoué a été reconstruite, limitée et testée à nouveau. Pour les logiciels de bureau, cela signifie la signature et les canaux de mise à jour. Pour CI/CD, cela signifie des références de flux de travail, des références de publication et la provenance des artefacts. Pour les attaquants externes, cela signifie souvent essayer d'atteindre le système par le mauvais chemin et confirmer qu'il n'accepte plus le même chemin. (openai.com)

Une liste de contrôle pratique pour les équipes qui fournissent des logiciels fiables

La liste de contrôle ci-dessous est intentionnellement classée par ordre d'urgence plutôt que par frontière d'équipe.

| Priorité | Action | Pourquoi c'est important |

|---|---|---|

| Aujourd'hui | Audit pour Axios 1.14.1, 0.30.4, et plain-crypto-js dans le code, les lockfiles, les CI et les hôtes | Déterminer si vous vous trouvez dans le rayon d'action de l'explosion |

| Aujourd'hui | Rotation des secrets sur tout hôte ayant installé les versions malveillantes | Google et Microsoft considèrent tous deux les hôtes concernés comme potentiellement compromis. |

| Aujourd'hui | Ne plus consommer de références d'actions tierces mutables dans les flux de travail privilégiés | GitHub affirme que la SHA complète est le seul modèle de référence d'action immuable |

| Cette semaine | Déplacer l'accès privilégié au nuage de CI vers l'OIDC lorsque c'est possible | Réduction de l'exposition aux secrets à longue durée de vie dans les flux de travail |

| Cette semaine | Séparer les flux de travail de signature, de publication et de déploiement des contextes de construction plus larges | Réduit ce qu'une dépendance compromise peut toucher |

| Cette semaine | Examiner l'exposition des runners auto-hébergés pour les flux de travail sensibles | Les coureurs persistants étendent le rayon d'action |

| Ce trimestre | Permettre des versions immuables et des attestations d'artefacts pour les résultats critiques | Améliore l'intégrité des artefacts et la vérification de la provenance |

| Ce trimestre | Introduire le "release-age gating" ou une quarantaine équivalente pour les mises à jour de paquets à risque. | L'écosystème a le temps de repérer les téléchargements malveillants. |

| En cours | Retester les chemins de mise à jour et de distribution après les corrections | Confirme que la mauvaise voie a disparu, et qu'il ne s'agit pas d'une simple rustine sur le papier. |

Chaque ligne de ce tableau s'appuie sur les mesures correctives publiées par OpenAI, sur les conseils de Google et de Microsoft en cas d'incident publiés par Axios ou sur la documentation officielle de GitHub relative à la sécurité des actions. (openai.com)

Le véritable enseignement de la compromission de l'outil de développement d'Axios

La façon la plus simple de mal comprendre le compromis de l'outil de développement Axios est de le considérer comme une histoire de niche d'OpenAI ou une peur passagère de npm. Ce n'est ni l'un ni l'autre. Il s'agit d'un exemple clair de la manière dont la compromission d'un paquet en amont peut traverser plusieurs couches de confiance : confiance dans le registre, exécution au moment de l'installation, confiance dans l'IC, confiance dans la signature, confiance dans la plateforme et confiance dans l'utilisateur. La réponse publique d'OpenAI rend cela visible car la société a dû faire face non seulement à une dépendance empoisonnée, mais aussi à la possibilité que le chemin de légitimité du logiciel pour ses applications Mac ait été touché. (openai.com)

La leçon d'ingénierie plus large est inconfortable mais utile. La sécurité des logiciels modernes ne se définit pas uniquement par la présence de bogues exploitables dans votre application. Elle est également définie par l'endroit où vous récupérez le code, la vitesse à laquelle vous lui faites confiance, les flux de travail qui peuvent l'exécuter, les secrets que ces flux de travail peuvent atteindre, la manière dont vous publiez ce qu'ils produisent et la manière dont les plates-formes d'extrémité décident si les utilisateurs doivent faire confiance à l'artefact final. Lorsque ces couches sont clairement séparées, un paquet malveillant peut rester local. Lorsqu'elles se fondent en un seul pipeline vaste, pratique et excessivement privilégié, un problème de dépendance peut se transformer en un incident de confiance dans la distribution. (Docs GitHub)

C'est la raison pour laquelle OpenAI a modifié le certificat. Non pas parce que le pire des cas a été prouvé, mais parce que l'ancre de confiance est entrée dans l'ensemble des incertitudes. Dans un programme de sécurité mature, cela suffit. (openai.com)

Pour en savoir plus

- OpenAI, Notre réponse à la compromission de l'outil de développement d'Axios (openai.com)

- Sécurité Microsoft, Atténuer la compromission de la chaîne d'approvisionnement npm d'Axios (microsoft.com)

- Groupe de renseignement sur les menaces de Google, Un acteur de menace nord-coréen compromet l'utilisation d'un NPM d'Axios dans le cadre d'une attaque de la chaîne d'approvisionnement (Google Cloud)

- Développeur Apple, Signer vos applications pour Gatekeeper (Développeur Apple)

- Développeur Apple, Soutien à l'identification du développeur (Développeur Apple)

- GitHub Docs, Référence d'utilisation sécurisée pour les actions GitHub (Docs GitHub)

- GitHub Docs, Renforcement de la sécurité d'OpenID Connect (Docs GitHub)

- GitHub Changelog, Les versions immuables sont désormais disponibles (Le blog de GitHub)

- GitHub Changelog, Les versions supportent désormais l'immutabilité en avant-première publique (Le blog de GitHub)

- GitHub Blog, Présentation des attestations d'artefacts (Le blog de GitHub)

- NVD, CVE-2025-30066 (nvd.nist.gov)

- NVD, CVE-2024-3094 (nvd.nist.gov)

- Page d'accueil de Penligent (penligent.ai)

- Laboratoire de piratage de Penligent, Sécurité de la chaîne d'approvisionnement en IA après Mercor (penligent.ai)

- Laboratoire de piratage de Penligent, LiteLLM sur PyPI a été compromis, ce que l'attaque a changé et ce que les défenseurs devraient faire maintenant (penligent.ai)