Résumé

La fraude par "deepfake" n'est plus une histoire théorique d'abus d'IA. Nous disposons désormais de cas documentés dans lesquels des criminels ont utilisé des clones vidéo et vocaux générés par l'IA pour se faire passer pour des cadres lors de conférences téléphoniques en direct et pousser des employés à virer $25 millions d'euros. La même technologie est utilisée pour contourner les contrôles d'identité des clients, déjouer les vérifications de la vivacité des visages, se faire passer pour des clients de banques et effectuer des virements urgents par ingénierie sociale.(Forum économique mondial)

Il ne s'agit pas seulement d'un problème de fraude. Il s'agit d'un problème de sécurité de base de la fintech, d'un problème de réglementation (GDPR / FCA / FTC) et d'un risque au niveau du conseil d'administration pour toute organisation qui déplace de l'argent à grande vitesse ou qui permet l'ouverture de comptes à distance.(Fortune)

A quoi ressemble la "deepfake fraud" dans la finance ?

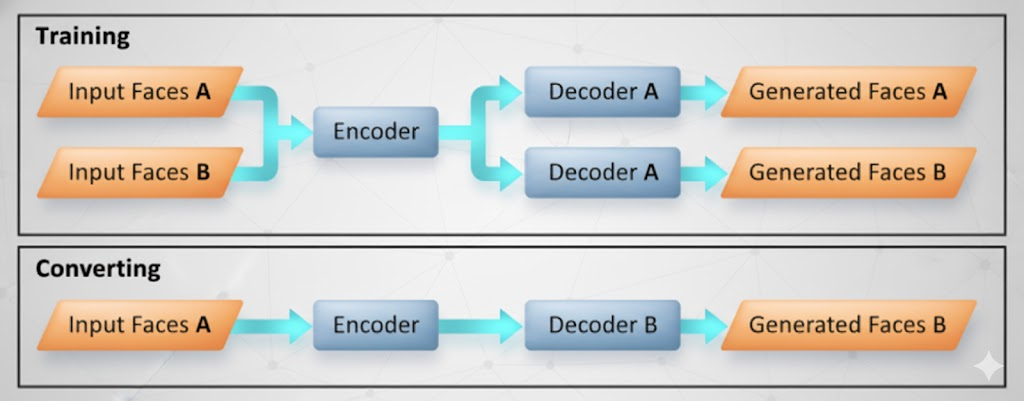

Les "deepfakes" sont des contenus audio/vidéo générés ou modifiés par l'IA qui imitent de manière convaincante le visage, la voix, les micro-mouvements du visage, la cadence et le mode d'élocution d'une personne réelle. Les attaquants les utilisent aujourd'hui pour se faire passer pour.. :

- Le directeur financier ou le vice-président régional d'une entreprise donnant des "instructions de transfert confidentielles urgentes".

- Un client d'une banque qui demande à réinitialiser les contrôles de son compte.

- Un responsable de la conformité qui demande des factures, des passeports ou des informations sur les virements bancaires.

- Le responsable financier d'un fournisseur de confiance demande une mise à jour du compte de paiement.

Ce qui a changé, ce n'est pas seulement le réalisme visuel. C'est l'accessibilité. Les outils de synthèse vocale disponibles dans le commerce peuvent cloner une voix à partir de quelques secondes d'audio public, puis lire n'importe quel script avec cette voix - suffisamment pour passer les faibles flux de "vérification de la voix" dans certaines banques.(Business Insider)

Cela met fin à la vieille idée selon laquelle "si je peux les entendre ou les voir en direct, c'est forcément eux".

Les études de cas et leur importance

$25M deepfake executive order over video call (en anglais)

Au début de l'année 2024, des criminels ont organisé une fausse "réunion urgente des cadres supérieurs" par vidéo avec le bureau de Hong Kong d'une multinationale. Tous les participants à l'écran - y compris ce qui ressemblait à s'y méprendre au directeur financier de l'entreprise - étaient générés par l'IA. L'employé du service financier qui participait à cet appel a été poussé à autoriser plusieurs virements d'un montant total d'environ $25 millions d'euros.Forum économique mondial)

Cette attaque mêlait l'ingénierie sociale à une présence extrêmement convaincante de type "deepfake". La victime pensait qu'elle suivait des ordres exécutifs directs, en temps réel, devant une caméra. Les retombées ont donné lieu à des analyses médico-légales et à l'intervention des forces de l'ordre, et pas seulement à un "procès-verbal de fraude" interne.Financial Times)

Le clonage vocal contre les flux de travail bancaires

Des chercheurs en sécurité et des journalistes ont démontré qu'avec un clonage vocal de qualité grand public, il est possible d'appeler le service clientèle d'une banque, de se faire passer pour le titulaire du compte et de demander des modifications de vérification ou de limites. Lors des tests, les contrôles de correspondance vocale de première ligne de certaines institutions financières n'étaient pas assez robustes pour rejeter l'appelant synthétique.Business Insider)

La prise de contrôle d'un compte n'est donc plus une opération ponctuelle d'ingénierie sociale, mais quelque chose d'évolutif et d'automatisable.

KYC bypass et onboarding à distance

Les banques, les prêteurs et les applications de paiement s'appuient sur le KYC à distance : "Montrez-nous votre visage, lisez cette phrase, tenez votre pièce d'identité près de votre visage". Les attaquants génèrent désormais des vidéos de visages de haute qualité avec des clignements d'yeux réalistes, des tours de tête et des indices de profondeur, puis les superposent à un vrai corps humain pour tromper les contrôles de présence et ouvrir des comptes frauduleux. Résultat : des comptes de passeurs d'argent instantanés et de nouveaux canaux de blanchiment.(Cybernews)

Il ne s'agit pas de cas isolés. Deloitte a prévu que la fraude induite par l'IA pourrait coûter aux banques et à leurs clients des dizaines de milliards de dollars d'ici à 2027, à mesure que les escroqueries basées sur les deepfakes s'industrialiseront et prendront de l'ampleur.(Deloitte Brésil)

Manuel de l'attaquant : comment les "deepfakes" sont réellement utilisés

Usurpation de l'identité d'un cadre / fraude "transfert urgent maintenant".

- Un employé du service financier est amené à participer à un appel vidéo avec "le directeur financier", qui exige des transferts confidentiels et immédiats en dehors des canaux d'approbation habituels.

- Le deepfake utilise l'autorité, le secret et la pression du temps pour passer outre la politique.

- L'exposition à un seul incident peut dépasser huit chiffres.Forum économique mondial)

Fraude KYC et ouverture de comptes

- Une vidéo synthétique "en direct" et une pièce d'identité trafiquée permettent d'accéder à l'embarquement.

- Les attaquants obtiennent des comptes bancaires / fintech / boursiers sous de fausses identités, ce qui permet la fraude, le blanchiment d'argent et l'abus de crédit.(Cybernews)

Escroqueries au clonage vocal

- Les criminels imitent un cadre ou un client fortuné et donnent des instructions par téléphone.

- Les agents des centres d'appel et les jeunes employés des services financiers ne peuvent souvent pas défier "le patron".Business Insider)

L'hameçonnage, maintenant avec une preuve vidéo

- Les anciens courriels d'hameçonnage semblaient peu soignés.

- Les nouvelles campagnes de phishing intègrent des "messages vidéo" ou des "notes vocales" personnalisés provenant de ce qui semble être un contact connu, ce qui accroît considérablement la crédibilité.(Business Insider)

Fraude au fournisseur / à la facture

- Les attaquants se font passer pour le directeur financier d'un fournisseur de longue date, avec le même visage et la même voix, et demandent à la comptabilité fournisseurs de "mettre à jour les instructions de virement".

- Les fonds sont silencieusement réacheminés vers des comptes contrôlés par l'attaquant.

Pourquoi la finance, la fintech et la banque sont exposées de manière unique.

- Tout est désormais à distance.

L'inscription, la pré-approbation des prêts, les changements de limites élevées et les opérations de trésorerie passent tous par des canaux à distance. Si les deepfakes font échouer l'étape "êtes-vous vraiment vous ?", le reste du flux de travail suppose la confiance.(Cybernews) - La vitesse est une caractéristique.

Les banques Fintech et challenger se targuent d'offrir la possibilité d'ouvrir un compte en quelques minutes. L'examen manuel et l'approbation par plusieurs personnes sont considérés comme des frictions. Les attaquants exploitent ce préjugé culturel en faveur de la rapidité. - Une dépendance excessive à l'égard des données biométriques.

De nombreuses organisations considèrent encore que "la voix sonne juste" ou que "le visage correspond à la photo d'identité" sont des preuves solides. Les "deepfakes" ont été littéralement conçus pour éliminer cette hypothèse.Business Insider) - Rayon d'explosion multiplateforme.

Une fois qu'un attaquant a convaincu le service financier de transférer de l'argent, le service juridique de signer et le service des opérations de partager des informations d'identification - souvent au cours du même faux appel - vous êtes en présence d'une violation synchronisée et multidépartementale. Il ne s'agit plus d'un courriel d'hameçonnage à canal unique.Forum économique mondial) - Asymétrie des ressources.

Les banques de premier rang peuvent se permettre d'effectuer en interne la détection des anomalies, l'analyse des fraudes et l'analyse judiciaire des médias. Une start-up régionale spécialisée dans les paiements ne le peut probablement pas. C'est précisément sur cette lacune que le crime organisé se concentrera la prochaine fois.(Deloitte Brésil)

Défense : passer de "Est-ce que je reconnais ce visage ?" à "Est-ce que cette transaction est cohérente sur le plan comportemental ?".

La défense moderne est stratifiée. Elle associe la détection technique, l'analyse comportementale, le contrôle des processus et la préparation à la réglementation.

Vérification par couches (comportement + dispositif + défi hors bande)

- Analyse comportementale : cadence de frappe, dynamique du curseur, rythme de navigation.

- Intelligence du dispositif : empreinte digitale de l'appareil, cohérence entre le système d'exploitation et le navigateur, géolocalisation et historique du compte.

- Authentification de l'élévation hors bande : OTP ou confirmation sécurisée in-app via un canal de confiance distinct avant les actions à haut risque.(Deloitte Brésil)

Contrôles avancés de la permanence et de l'usurpation d'identité

- Vidéo : taux de clignotement et synchronisation, latence des micro-expressions, indices de profondeur 3D, réflexion de la lumière sur la peau (arête du nez / front), miroitement des bords, artefacts de compression.

- Audio : trous de respiration, pauses non naturelles, anomalies du spectrogramme, bruits de fond robotiques.Cybernews)

Il s'agit de signaux qu'une simple recherche de correspondance entre le visage et la photo d'identité ne permet pas de détecter.

Contrôles au niveau des processus

- Les virements de grande valeur nécessitent une double ou triple approbation sur des canaux indépendants (vidéo + téléphone vérifié séparément + messagerie interne).

- Les termes "urgence" ou "confidentiel" ne prévalent pas sur la politique ; ils déclenchent une procédure d'urgence. plus vérification, pas moins.Forum économique mondial)

Information continue sur les menaces et formation du personnel

- Les équipes chargées de la sécurité, du SOC, de la fraude, de la trésorerie et de la comptabilité fournisseurs doivent établir des playbooks réalistes ("transfert urgent du PDG", "modification des informations bancaires du fournisseur", "appel vocal d'un client VIP").

- Il faut apprendre aux employés qu'un visage convaincant sur Zoom n'est plus une preuve d'identité.Forum économique mondial)

Conformité et auditabilité

- Les régulateurs (FCA au Royaume-Uni, FTC aux États-Unis, GDPR dans l'UE) attendent de plus en plus des institutions qu'elles puissent prouver ils ont vérifié l'identité et autorisé une transaction par le biais de contrôles à plusieurs niveaux, et non pas simplement par l'intermédiaire d'un interlocuteur qui leur a semblé correct au téléphone.Fortune)

- Les assureurs mettent à jour la couverture de la cybercriminalité et de l'ingénierie sociale. Ils demandent désormais si vous avez mis en place des protocoles de vérification et de suivi des incidents avant de souscrire des polices d'assurance.(Reuters)

Vous trouverez ci-dessous un exemple de matrice des risques de fraude (scénario par rapport aux contrôles requis) :

| Scénario | Menace principale | Contrôles requis |

|---|---|---|

| Embarquement à distance / KYC | Faux visage + fausse carte d'identité + "liveness" synthétique | Lividité avancée, analyse comportementale, vérification de l'authenticité des documents, empreintes digitales des appareils |

| Autorisation de transfert de grande valeur | Le "CFO" de Deepfake commande des fils confidentiels urgents | Rappel multicanal, flux de travail à double approbation, piste de vérification enregistrée |

| Augmentation de la limite des centres d'appel | Clone vocal du "client" | Analyse de la voix + questions pièges + OTP hors bande |

| Modification du paiement du fournisseur | Faux contact financier d'un fournisseur avec voix/vidéo clonée | Rappel d'un téléphone ou d'un courriel préenregistré, vérification de l'historique des factures, escalade financière interne |

Réponse aux incidents : traiter les fraudes de type "deepfake" comme des infractions

En cas de suspicion de fraude par deepfake, votre cahier des charges doit ressembler à un incident de sécurité, et non à un litige de routine avec un client :

- Geler le(s) virement(s) suspect(s) et bloquer les autres virements sortants.

- Préserver l'intégralité des preuves d'appel, de vidéo et de chat pour les besoins de la police scientifique et de la chaîne de traçabilité légale.

- Les services juridiques, les services de conformité, les services de lutte contre la fraude et les services cybernétiques doivent être saisis simultanément, et non pas successivement.

- Déclencher les divulgations obligatoires si elles sont exigées par la FCA/FTC/GDPR ou les régulateurs sectoriels ; documenter exactement les contrôles qui ont échoué.(Fortune)

- Réinitialiser les identifiants, revérifier les comptes à haut risque et forcer le multi-facteur pour toute entité concernée.

À ce stade, de nombreux assureurs et régulateurs considèrent déjà la fraude par deepfake comme un cyberincident, et non comme une simple erreur de jugement de la part d'un employé.Reuters)

Argument de clôture : la preuve d'identité n'est plus visuelle - elle est comportementale, procédurale et vérifiable.

La finance a toujours fait confiance aux confirmations visuelles et sonores : "Je les ai vus sur la vidéo", "J'ai entendu leur voix", "Ils ont tenu leur carte d'identité à côté de leur visage". Les fraudes de type "deepfake" détruisent ce modèle.Business Insider)

La nouvelle norme est stratifiée, contradictoire et réglementée. Elle associe la détection avancée de la présence, l'analyse comportementale, l'approbation multipartite stricte pour les actions de grande valeur et la réponse rapide aux incidents avec une conservation des preuves de qualité juridique.Fortune)

En d'autres termes, la question n'est plus "Est-ce que je reconnais ce visage ?". La question est : "Cette action peut-elle survivre à l'audit, au litige, à l'examen de l'assurance et à l'examen réglementaire demain matin ?"