A maneira mais fácil de não entender o Promptfoo é pensar que ele é outro playground de prompts. Mas não é. O Promptfoo está muito mais próximo de um conjunto de testes, um mecanismo de equipe vermelha e um portão de lançamento para aplicativos LLM do que de um ambiente de demonstração para experimentar alguns prompts manualmente. Sua própria documentação descreve o produto como uma plataforma para avaliar e proteger aplicativos de LLM com testes automatizados, equipe vermelha, benchmarking, integração de CI/CD e suporte aos principais provedores de modelos. No site da empresa, o Promptfoo também se apresenta como focado em aplicativos e não apenas em modelos, com cobertura que abrange prompts, sistemas RAG, agentes e integrações. (Promptfoo)

Esse enquadramento é importante porque o problema de engenharia em torno dos sistemas de IA mudou. As equipes não estão mais enviando uma única caixa de texto apoiada por um modelo geral e esperando que a qualidade seja aceitável. Elas estão enviando pipelines de recuperação, agentes de navegador, copilotos de codificação, assistentes de chamadas de ferramentas, automação de fluxo de trabalho, bots de suporte vinculados ao conhecimento interno e agentes corporativos com acesso a correio, tíquetes e APIs de nuvem. Nesses ambientes, uma "boa taxa de resposta" não é suficiente. Você também precisa saber se o sistema pode ser manipulado por injeção imediata, enganado para expor dados confidenciais, forçado a usar ferramentas inseguras ou desestabilizado por contexto envenenado. A OWASP agora coloca a injeção imediata no topo de sua lista de riscos do LLM 2025, e o Generative AI Profile do NIST trata explicitamente a IA generativa como um domínio de risco distinto que exige ações estruturadas de gerenciamento de riscos em vez de testes ad hoc. (Projeto de segurança de IA da OWASP Gen)

O Promptfoo se tornou uma das expressões mais claras dessa mudança da experimentação para a engenharia. A página de introdução do projeto diz que seu objetivo é "desenvolvimento de LLM orientado por testes, não por tentativa e erro", e o início rápido da equipe vermelha enfatiza a varredura automatizada em mais de 50 tipos de vulnerabilidade, incluindo jailbreaks, injeções, envenenamento de RAG, problemas de conformidade e políticas organizacionais personalizadas. Os mesmos materiais destacam seu uso como CLI, biblioteca ou componente de CI/CD, que é exatamente a linguagem que as equipes de software usam quando um recurso passa de um exercício de laboratório para um controle de engenharia repetível. (Promptfoo)

O sinal de mercado em torno da Promptfoo também mudou substancialmente em março de 2026. A Promptfoo anunciou que havia concordado em ser adquirida pela OpenAI, e a OpenAI declarou que estava adquirindo a Promptfoo para fortalecer os recursos de teste e avaliação de segurança agêntica dentro da OpenAI Frontier. Isso não torna a Promptfoo magicamente correta em todas as escolhas arquitetônicas, mas ressalta algo maior: Os testes de segurança de IA não são mais uma preocupação secundária. Ele está se tornando parte do ciclo de vida principal do aplicativo para equipes que esperam que os sistemas LLM operem em produção. (Promptfoo)

O que o Promptfoo realmente faz

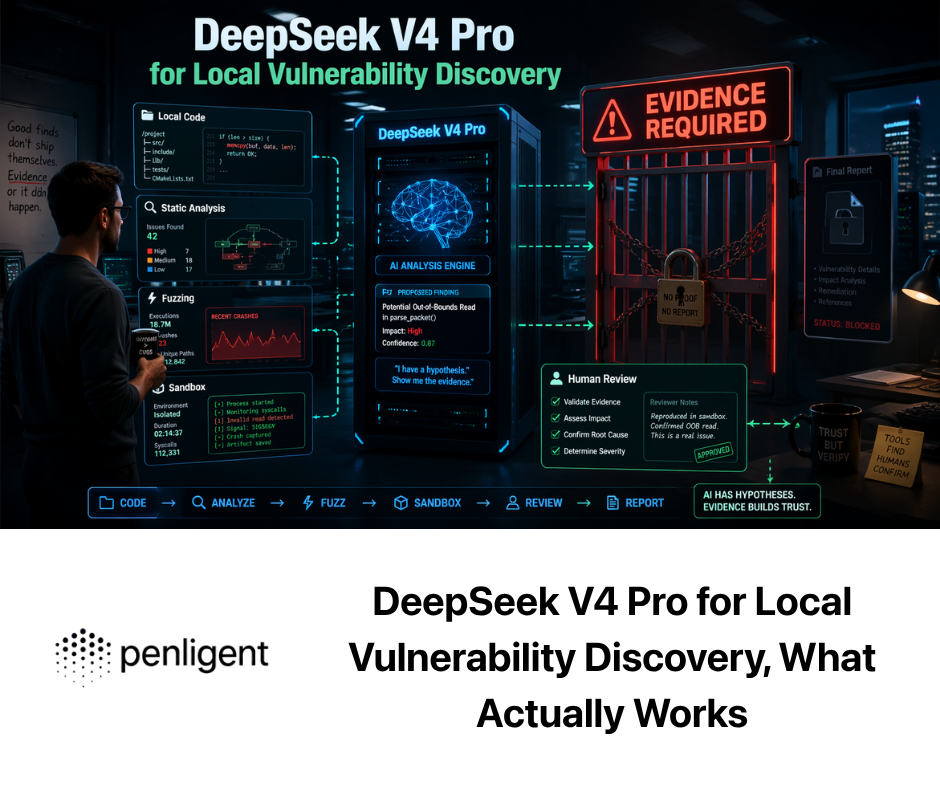

Em um nível prático, o Promptfoo realiza duas tarefas que muitas equipes ainda mantêm separadas. Primeiro, ele avalia a qualidade do resultado. Em segundo lugar, ele testa o comportamento de forma adversa sob condições inseguras, adversas ou de casos extremos. A página de introdução oficial enfatiza os prompts de benchmarking, os modelos e os pipelines RAG, a pontuação automática por meio de métricas, as comparações lado a lado, o armazenamento em cache, a simultaneidade e o recarregamento em tempo real. Os materiais da equipe vermelha enfatizam a varredura de vulnerabilidades, a geração de ataques adaptados ao aplicativo de destino e os testes contínuos em CI/CD. (Promptfoo)

Essa combinação é importante porque a maioria das falhas de produção em sistemas de LLM ocorre na junção entre qualidade e segurança. Um sistema que responde com precisão 95% das vezes ainda pode ser inaceitável se os 5% restantes incluírem exfiltração de dados, desvio de controle de acesso ou invocação de ferramentas inseguras. Por outro lado, um sistema que bloqueie todas as ações perigosas, mas que não tenha qualidade básica de fundamentação, relevância ou recuperação, não sobreviverá ao contato com os usuários. O método do Promptfoo é útil justamente porque trata a avaliação e a equipe vermelha como partes adjacentes do mesmo sistema de engenharia, e não como departamentos separados com ferramentas distintas. (Promptfoo)

A linguagem da página inicial também é reveladora. A Promptfoo diz que seus testes compreendem "lógica de negócios, RAG, agentes, integrações" e que abrange "mais de 50 tipos de vulnerabilidade, de injeção a jailbreaks". Essa é uma distinção importante do benchmarking de modelos genéricos. Se o seu aplicativo permite que um modelo leia documentos, consulte sistemas internos, chame ferramentas ou aja em nome de um usuário, a verdadeira superfície de ataque não é mais apenas os pesos do modelo ou o prompt do usuário. Ela inclui todos os sistemas que podem moldar o contexto, todos os descritores de ferramentas que o modelo pode ver, todos os esquemas sobre os quais ele raciocina, todos os armazenamentos de memória dos quais ele pode ler e todos os canais de saída que ele pode influenciar. (Promptfoo)

Por que isso é importante agora, não um dia

A frase mais importante no artigo sobre injeção imediata da OWASP não é o título. É a explicação de que a injeção de prompt não precisa ser visível para os seres humanos, desde que o conteúdo seja analisado pelo modelo. Essa única linha captura o motivo pelo qual a segurança do LLM rompe as suposições tradicionais. Um ser humano pode ler a página e não ver nada suspeito. O modelo pode analisar o texto oculto, o texto alternativo, os metadados serializados, as instruções incorporadas ou a saída da ferramenta e tratá-los como orientação operacional. (Projeto de segurança de IA da OWASP Gen)

Esse mesmo risco agora é visível na orientação do fornecedor de nível de produção. As práticas recomendadas de segurança da OpenAI recomendam restringir a entrada do usuário, limitar os tokens de saída e restringir as entradas e saídas a fontes confiáveis sempre que possível, porque a interação aberta e sem restrições amplia a gama de uso indevido. A orientação de segurança da Microsoft sobre injeção indireta de prompt descreve o modo de falha principal como o modelo que interpreta erroneamente dados não confiáveis como instruções. A pesquisa pública da Anthropic sobre defesas de injeção imediata também enquadra conteúdo da Web, e-mail e outros fluxos de conteúdo não confiáveis como vetores de ataque para agentes. Em diferentes fornecedores, a linguagem converge: o contexto não confiável é agora um risco de execução. (Desenvolvedores da OpenAI)

Para os engenheiros de segurança, isso significa que o antigo ritmo de testes não é mais suficiente. O ajuste manual de prompts, algumas demonstrações de caminho feliz e uma aprovação de segurança de conteúdo em estágio final não informam se o sistema sobreviverá ao tráfego real. A metodologia de equipe vermelha do Promptfoo é valiosa não porque seja a única ferramenta capaz de gerar prompts adversários, mas porque incentiva as equipes a operacionalizar uma questão mais realista: o que acontece quando o modelo encontra um contexto controlado por invasores dentro do fluxo de trabalho comercial exato que estamos enviando. (Promptfoo)

O método Promptfoo, reduzido ao essencial da engenharia

Se você remover a linguagem do produto e observar o método principal, o Promptfoo impulsiona as equipes para um fluxo de trabalho disciplinado.

Etapa 1, definir o limite real do sistema

Antes de poder avaliar de forma significativa um aplicativo de IA, você precisa decidir o que é realmente o aplicativo. Para um agente moderno, isso nunca é apenas o modelo de prompt. Ele inclui a camada de recuperação, a memória, as ferramentas externas, as permissões de ação, o contexto de identidade e os sistemas downstream. O próprio posicionamento do Promptfoo com foco no aplicativo reflete essa realidade, e a literatura mais ampla sobre segurança de agentes faz a mesma observação. O artigo recente da Penligent sobre aplicativos de agentes descreve a superfície de segurança como uma expansão para instruções de linguagem natural, descritores de ferramentas, esquemas, memória, cadeias de delegação e comunicação entre agentes, o que reflete o que as equipes sérias estão descobrindo na produção. (Promptfoo)

Etapa 2: decidir como é o sucesso e como nunca deve ser o fracasso

Os testes tradicionais de aplicativos geralmente começam com os resultados esperados. Os testes de LLM precisam incluir os danos esperados. A estrutura de avaliação do Promptfoo permite que as equipes definam métricas e julguem os resultados automaticamente, enquanto a estrutura da equipe vermelha procura por classes de risco, como injeções, jailbreaks, falhas de privacidade de dados e violações de políticas personalizadas. Na prática, isso significa que todo recurso de IA precisa de duas definições: a resposta que você deseja e o comportamento que você nunca deve permitir. (Promptfoo)

Etapa 3, criar casos normais e casos contraditórios no mesmo repositório

É nesse ponto que muitas equipes ainda investem pouco. Elas mantêm os testes de qualidade do modelo em um lugar e os testes de segurança em outro, ou pior, em lugar nenhum. Os padrões CLI e CI/CD do Promptfoo incentivam os engenheiros a tratar ambos como ativos com versão. É assim que uma equipe passa do teatro da segurança para a realidade dos testes de regressão. Quando um prompt é alterado, quando o modelo é alterado, quando uma fonte de recuperação é alterada ou quando uma nova ferramenta é exposta, os casos de qualidade e de abuso devem ser executados novamente. O GitHub Action e os documentos de CI/CD do Promptfoo foram criados exatamente para esse tipo de fluxo de trabalho. (Promptfoo)

Etapa 4, faça ataques específicos para seu aplicativo, não genéricos para a Internet

Um corpus de jailbreak pronto é útil, mas não é suficiente. O Promptfoo enfatiza repetidamente os ataques adaptativos e específicos de aplicativos em vez de apenas a fuzzing estática. Essa distinção é importante porque as falhas mais graves geralmente dependem do contexto comercial. Um copiloto financeiro é vulnerável de maneiras diferentes de um agente de codificação. Um sistema RAG de suporte enfrenta riscos diferentes de exfiltração e envenenamento do que um agente de navegador com autoridade de compra. Quanto mais as sondas de ataque se aproximarem de seus fluxos de dados reais e das permissões das ferramentas, mais significativos serão os resultados. (Promptfoo)

Etapa 5, trate as descobertas como defeitos de software e defeitos de arquitetura

Algumas descobertas do Promptfoo serão defeitos de prompt. Outras serão defeitos de permissão, defeitos de limites de confiança, defeitos de modelagem de dados ou defeitos de orquestração. O trabalho de risco de IA do NIST é útil aqui, pois evita que as equipes coloquem todas as falhas de IA em um único pacote. Você não está apenas corrigindo "resultados ruins". Você está reduzindo o risco mensurável em todo o projeto, implantação e operação. (NIST)

Avaliação não é red teaming, e red teaming não é avaliação

Um dos erros de implementação mais comuns é presumir que, se você tiver benchmarks rápidos, terá cobertura de segurança. Isso não é verdade.

A avaliação pergunta se o sistema tem um bom desempenho em tarefas definidas. Trata-se de correção, relevância, fundamentação, consistência, latência, custo ou estilo. O Promptfoo apoia explicitamente esse lado da casa com comparações de modelos, visualizações de prompts lado a lado, métricas e benchmarking para prompts, modelos e pipelines RAG. (Promptfoo)

A equipe vermelha pergunta se o sistema falha perigosamente quando o mundo deixa de ser cooperativo. Trata-se de injeção, exfiltração, uso inseguro de ferramentas, desvio de políticas, amplificação de privilégios, autoridade alucinada ou abuso no estilo negação de carteira. A documentação da equipe vermelha do Promptfoo e as páginas do produto descrevem diretamente a varredura dessas classes, incluindo injeção, jailbreaks, exfiltração de documentos e sondas de ataque personalizadas. (Promptfoo)

A distinção parece óbvia até que você veja quantas equipes ainda testam apenas um lado. Um bot de suporte pode responder de forma correta e ainda revelar o comportamento oculto do sistema com entradas criadas. Um assistente de codificação pode retornar o código correto em benchmarks limpos e ainda assim tornar-se perigoso quando apontado para servidores MCP mal-intencionados, repositórios não confiáveis ou comentários envenenados. Um aplicativo RAG pode apresentar excelente precisão de recuperação e, ao mesmo tempo, permanecer vulnerável a injeções em nível de documento e envenenamento de contexto de cauda longa. Essa lacuna é exatamente o motivo pelo qual vale a pena levar a sério o método Promptfoo. (Promptfoo)

O Promptfoo faz mais sentido em sistemas RAG e de agentes

Quanto mais autoridade seu modelo tiver, mais o fluxo de trabalho do Promptfoo começa a parecer necessário, e não opcional.

Um chatbot simples, sem memória, sem recuperação e sem ferramentas, ainda pode vazar a intenção do sistema ou violar a política, mas o raio da explosão é relativamente limitado. Depois que você adiciona o RAG, o modelo começa a consumir documentos semiconfiáveis ou não confiáveis e a exibir seu conteúdo como respostas. Quando você adiciona ferramentas, o modelo começa a selecionar ações e argumentos. Quando você adiciona memória, o sistema pode preservar o estado manipulado. Depois de adicionar acesso ao navegador, acesso à caixa de entrada ou acesso a arquivos, você criou uma ponte entre o conteúdo controlado pelo invasor e os fluxos de trabalho privilegiados. Os materiais públicos do Promptfoo, além da literatura mais ampla sobre segurança de agentes, concentram-se repetidamente nessa escalada de risco. (Promptfoo)

É também nesse ponto que a linguagem "focada em aplicativos" do Promptfoo é mais do que marketing. Um benchmark somente de modelo não pode dizer se o seu agente encaminhará conteúdo confidencial para um endpoint controlado por um invasor, se um descritor de ferramenta vaza opções privilegiadas, se um documento pode substituir o comportamento do sistema ou se uma integração de MCP se torna um caminho de execução remota. Essas são questões de fluxo de trabalho. Elas emergem do sistema em torno do modelo. (Promptfoo)

O modelo de ameaça por trás do Promptfoo está alinhado com o OWASP e o NIST

Há um motivo útil para mapear a abordagem do Promptfoo para estruturas externas. Isso ajuda a separar as reivindicações específicas do produto dos princípios de segurança duráveis.

O Top 10 do LLM 2025 da OWASP coloca a injeção imediata em primeiro lugar, mas o restante da lista também é importante. A divulgação de informações confidenciais, os problemas na cadeia de suprimentos, a negação de serviço e o manuseio inseguro de resultados são todos claramente mapeados para modos de falha comuns em aplicativos modernos de IA. O quickstart da equipe vermelha do Promptfoo chama a atenção explicitamente para questões de segurança e privacidade de dados, verificações de conformidade e ética e políticas personalizadas, enquanto a documentação mais ampla da equipe vermelha e as páginas do produto destacam a exfiltração, a injeção, os jailbreaks e outros riscos no nível do aplicativo. (Projeto de segurança de IA da OWASP Gen)

O perfil de IA generativa do NIST também é relevante porque enquadra o gerenciamento de riscos como uma atividade de ciclo de vida. Isso se encaixa no posicionamento do Promptfoo em CI/CD. Em outras palavras, o Promptfoo não é mais útil quando é um exercício de penetração único após o lançamento do produto. Ele é mais útil quando se torna parte do ciclo de desenvolvimento, em que as equipes podem medir o efeito de edições rápidas, trocas de modelos, alterações de recuperação e alterações de permissão antes que essas alterações cheguem à produção. (NIST)

Incidentes reais e CVEs mostram por que esse estilo de teste é necessário

Os engenheiros de segurança não precisam mais de avisos abstratos. O ecossistema já tem falhas concretas que mostram como os sistemas agênticos e habilitados para LLM entram em colapso sob suposições de confiança inseguras.

Microsoft 365 Copilot e risco de injeção de IA no estilo clique zero

O CVE-2025-32711 descreve um problema de injeção de comando de IA no Microsoft 365 Copilot que permite que um invasor não autorizado divulgue informações em uma rede. O NVD registra o problema como explorável pela rede e observa um alto impacto na confidencialidade. A discussão mais ampla do setor em torno do "EchoLeak" transformou esse problema em um ponto de referência importante, pois demonstrou como um caminho de conteúdo cuidadosamente elaborado poderia levar à divulgação sem o padrão clássico de clique do usuário que as equipes de segurança estão acostumadas a centralizar. Independentemente de você se concentrar na entrada do CVE em si ou nos postmortems de fornecedores e pesquisadores, a lição é a mesma: se um sistema de IA processa conteúdo controlado por invasores dentro de um fluxo de trabalho empresarial privilegiado, a injeção indireta se torna um problema de exposição de dados, não apenas um problema de alinhamento. (NVD)

Langflow e a colisão entre a conveniência do fluxo de trabalho de IA e o RCE clássico

O CVE-2025-3248 não é um bug de injeção de prompt. Trata-se de um problema de injeção de código no endpoint de validação do Langflow que permitiu que invasores remotos não autenticados executassem códigos arbitrários em versões anteriores à 1.3.0. O motivo pelo qual ele pertence a este artigo é que ele expõe um padrão recorrente nas ferramentas de IA: as plataformas criadas para acelerar a orquestração de IA geralmente enviam superfícies de execução perigosas junto com a camada de orquestração. Se o seu programa de segurança testar apenas o comportamento do modelo e ignorar a plataforma de fluxo de trabalho, você perderá completamente alguns dos modos de falha mais catastróficos. (NVD)

Cursor, MCP e ecossistemas de ferramentas não confiáveis

O CVE-2025-61591 é um dos exemplos mais claros de por que a segurança do agente não pode ser reduzida à moderação de conteúdo. A NVD descreve o problema como um caso em que o Cursor, ao usar o MCP com autenticação OAuth em um servidor MCP não confiável, poderia receber comandos maliciosos criados que levariam à injeção de comandos e à possível execução remota de código no host pelo agente. Esse é o tipo de vulnerabilidade que faz com que o foco da Promptfoo na formação de equipes vermelhas com reconhecimento de ferramentas e em testes específicos de aplicativos pareça presciente. Quando um modelo consegue interpretar os metadados da ferramenta ou as respostas do servidor como orientação operacional, a distância entre o "assistente" e a "interface de execução" diminui drasticamente. (NVD)

A automação do fluxo de trabalho agora atinge o mesmo nível de risco que o software de infraestrutura clássico

Mesmo fora dos produtos com a marca de IA explícita, as plataformas de fluxo de trabalho estão sendo exploradas de maneiras que devem preocupar qualquer pessoa que esteja criando sistemas agênticos. O Hacker News relatou em 12 de março de 2026 que a CISA adicionou o RCE de injeção de expressão n8n, rastreado como CVE-2025-68613, ao catálogo de Vulnerabilidades Exploradas Conhecidas com base em evidências de exploração ativa, com a falha corrigida no final de 2025 e o risco de comprometimento completo descrito para instâncias expostas. Embora esse caso não seja uma história do Promptfoo, ele reforça o ponto arquitetônico: quando os fluxos de trabalho combinam avaliação dinâmica, automação e ampla integração, os invasores passam rapidamente da manipulação lógica para a execução de código. (Notícias do Hacker)

Em conjunto, esses casos mostram por que um programa sério de segurança de IA precisa de mais do que benchmarking de resultados e mais do que um único "teste de injeção imediata". Ele precisa de uma validação com reconhecimento de aplicativos, ferramentas e integração que seja executada continuamente.

Um fluxo de trabalho prático do Promptfoo para equipes de segurança

Os exemplos a seguir são ilustrativos e não copiados de uma única implantação de produção, mas refletem os padrões de comando documentados e a filosofia de configuração do Promptfoo. A ideia principal é definir os casos normais e contraditórios como código e executá-los repetidamente. (Promptfoo)

Um padrão de avaliação simples

Descrição: Suíte de regressão de qualidade do assistente de suporte

solicita:

- "Você é um assistente de suporte da AcmeCloud. Responda com base apenas no contexto fornecido."

provedores:

- openai:gpt-5

- anthropic:claude-sonnet-4-5

testes:

- vars:

question: "Como faço para girar uma chave de API?"

contexto: "As chaves de API podem ser giradas na guia Segurança..."

assert:

- type: contains

value: "Security tab" (guia Segurança)

- type: not-contains

value: "Posso navegar diretamente em sua conta"

- vars:

question: "Você pode excluir meu histórico de faturamento?"

context: "O histórico de faturamento é retido por motivos de conformidade."

assert:

- type: contains

value: "retained"

- type: not-contains

value: "deleted immediately" (excluído imediatamente)

Esse tipo de suíte não é glamouroso, mas é a forma como as equipes impedem que as alterações de prompt degradem silenciosamente o comportamento. A documentação do Promptfoo enfatiza as comparações lado a lado, as métricas e as visualizações de matriz porque as regressões nos sistemas LLM geralmente são sutis até atingirem os clientes. (Promptfoo)

Um padrão de equipe vermelha para injeção e exfiltração imediata

Descrição: Testes de injeção e exfiltração do assistente RAG

equipe vermelha:

finalidade: "Testar se o assistente pode ser induzido a revelar instruções ocultas ou contexto interno sensível"

plug-ins:

- prompt-injection

- injeção indireta de prompt

- pii

- política

- filtragem de dados

alvos:

- id: customer-support-rag

rótulo: "Suporte ao sistema RAG"

Os nomes e as opções exatas dos plug-ins variam de acordo com a configuração, mas a estrutura reflete o modelo do Promptfoo: defina a finalidade, selecione as classes de abuso que lhe interessam e execute testes específicos de aplicativos em vez de prompts genéricos de chatbot. Os materiais oficiais de início rápido e da equipe vermelha descrevem a varredura de dezenas de classes de vulnerabilidade e a geração de sondas de ataque personalizadas para o sistema de destino. (Promptfoo)

Uma política de uso de ferramentas que os engenheiros podem realmente aplicar

ALLOWED_TOOLS = {

"read_ticket": {"risk": "low"},

"list_kb_docs": {"risk": "baixo"},

"send_email": {"risk": "alto"},

"refund_customer": {"risk": "high"},

}

def approve_tool_call(tool_name: str, args: dict, source: str) -> bool:

se tool_name não estiver em ALLOWED_TOOLS:

return False

se source == "untrusted_web_content":

return tool_name in {"read_ticket", "list_kb_docs"}

se ALLOWED_TOOLS[nome_da_ferramenta]["risco"] == "alto":

return require_human_review(tool_name, args)

return True

Esse código não é um recurso do Promptfoo por si só. É o tipo de controle de compensação que o Promptfoo ajuda a testar. Se um caso contraditório ainda puder levar o agente a enviar_email ou refund_customer de conteúdo não confiável, seu modelo de aprovação está quebrado, mesmo que suas respostas de linha de base pareçam excelentes. A orientação da OpenAI sobre o estreitamento de entradas e saídas e a orientação da Microsoft sobre injeção indireta dão suporte a essa postura em camadas e de restrição em primeiro lugar. (Desenvolvedores da OpenAI)

Comandos de CI/CD que levam os testes das boas intenções à aplicação

# Avaliação da qualidade

npx promptfoo@latest eval -c promptfooconfig.yaml

# Teste de segurança

npx promptfoo@latest redteam run

Esses padrões de comando vêm diretamente da documentação de CI/CD do Promptfoo. O ponto importante é tanto cultural quanto técnico: quando essas verificações se tornam parte do caminho de lançamento, as alterações de prompt e orquestração deixam de ser eventos de segurança invisíveis. (Promptfoo)

Como é um programa Promptfoo maduro

As equipes que obtêm valor real do Promptfoo geralmente não o utilizam como um scanner único. Elas o utilizam como um corpus crescente de conhecimento sobre como seus aplicativos falham.

Esse corpus geralmente contém avaliações de tarefas estáveis, prompts adversários, contextos envenenados, tentativas de desvio conhecidas, documentos recuperados que causaram problemas anteriormente, casos extremos de chamadas de ferramentas, casos de envenenamento de memória e verificações de regressão para cada problema que já foi corrigido. O suporte documentado do Promptfoo para métricas, pontuação automatizada, CI/CD e configuração de equipe vermelha torna possível esse tipo de captura de conhecimento. (Promptfoo)

Quanto mais avançado for o aplicativo, mais o corpus deverá modelar falhas em várias etapas em vez de falhas em um único turno. Um agente de navegador pode precisar de um teste em que uma página maliciosa altere o plano. Um agente de codificação pode precisar de um teste em que um servidor MCP não confiável ou uma resposta de ferramenta injeta instruções inseguras. Um sistema RAG de suporte pode precisar de um teste em que um documento envenenado contamine uma consulta de cliente perfeitamente comum. Os materiais recentes da Promptfoo sobre agentes de navegação na Web e a "trifeta letal" apontam diretamente para essa categoria de risco. (Promptfoo)

Onde o Promptfoo é forte e onde as equipes ainda precisam de mais

O Promptfoo é forte onde você precisa de estrutura, repetibilidade, cobertura da equipe vermelha e disciplina de engenharia em torno do comportamento do aplicativo de IA. Ele é especialmente forte como uma ponte entre os desenvolvedores e as equipes de segurança, pois pode viver no código, em solicitações pull e em CI/CD, em vez de em um processo manual separado. Os documentos oficiais e as páginas do produto explicitam esse modelo de implantação centrado no desenvolvedor. (Promptfoo)

Mas as equipes também devem ser honestas sobre o que o Promptfoo não é. Ele não substitui privilégios mínimos, segmentação de rede, acesso a ferramentas com reconhecimento de identidade, sandboxing, práticas seguras de cadeia de suprimentos de software ou análise tradicional de segurança de aplicativos. O exemplo do Langflow RCE é um lembrete de que as plataformas de orquestração podem falhar de maneiras clássicas. O CVE do Cursor MCP é um lembrete de que a confiança no protocolo e na integração é importante. O caso do n8n é um lembrete de que a automação dinâmica pode se tornar rapidamente um território de exploração ativa. O Promptfoo pode ajudar a descobrir e testar o comportamento perigoso, mas não pode tornar uma arquitetura ruim segura por si só. (NVD)

É também por isso que o NIST e o OWASP continuam sendo âncoras úteis. Um programa de segurança de IA maduro não pergunta: "Qual ferramenta devemos comprar?". Ele pergunta: "Como reduzimos o risco em todo o ciclo de vida, na arquitetura, nas permissões, nos fluxos de contexto e no modelo operacional?" O Promptfoo se encaixa bem nessa resposta porque transforma suposições arriscadas em testes executáveis. Ele não substitui o restante da resposta. (NIST)

Uma estrutura de decisão concisa para equipes que consideram o Promptfoo

A tabela abaixo é intencionalmente simples. Seu objetivo é ajudar os líderes de engenharia a decidir qual é o lugar do Promptfoo em sua pilha.

| Cenário | Risco primário | Por que o Promptfoo ajuda | O que o Promptfoo não resolverá sozinho |

|---|---|---|---|

| Chatbot básico sem ferramentas | Desvio de política, vazamento imediato, saídas inseguras | Os conjuntos de avaliação e de equipe vermelha detectam regressões e casos comuns de abuso | A identidade, a governança de dados e os controles do provedor de modelos ainda são importantes |

| Assistente RAG sobre documentos internos | Injeção indireta, exfiltração de dados, recuperação envenenada | Os testes adversários contra documentos e fluxos de recuperação são fundamentais para a abordagem da Promptfoo | A higiene dos documentos, o controle de acesso e os controles de proveniência ainda são necessários |

| Agente de suporte para chamadas de ferramentas | Seleção de ações inseguras, manipulação de argumentos, desvio de privilégios | Os casos de abuso específicos de aplicativos podem testar continuamente os limites da ferramenta | O privilégio mínimo, as aprovações e o fortalecimento do sistema downstream são controles separados |

| Navegador ou agente de caixa de entrada | Decisões de modelagem de conteúdo não confiável da Web e de e-mail | A orientação recente do Promptfoo aborda especificamente a injeção indireta em fluxos de trabalho de agentes | O isolamento do navegador, a política de rede e os controles de conteúdo externo continuam sendo necessários |

| MCP ou agente de codificação orientado por plug-in | Respostas não confiáveis do servidor, injeção de comando, comprometimento do host | A formação de equipes vermelhas com reconhecimento de ferramentas revela comportamentos perigosos de agentes mais cedo | Confiar em servidores MCP hostis ou na execução local excessivamente permissiva ainda é um risco arquitetônico difícil |

Esse enquadramento é consistente com o posicionamento público da Promptfoo em relação a agentes, RAG e integrações; a priorização da OWASP da injeção imediata e dos riscos LLM relacionados; e a recente orientação do fornecedor em relação à injeção indireta em sistemas agênticos. (Promptfoo)

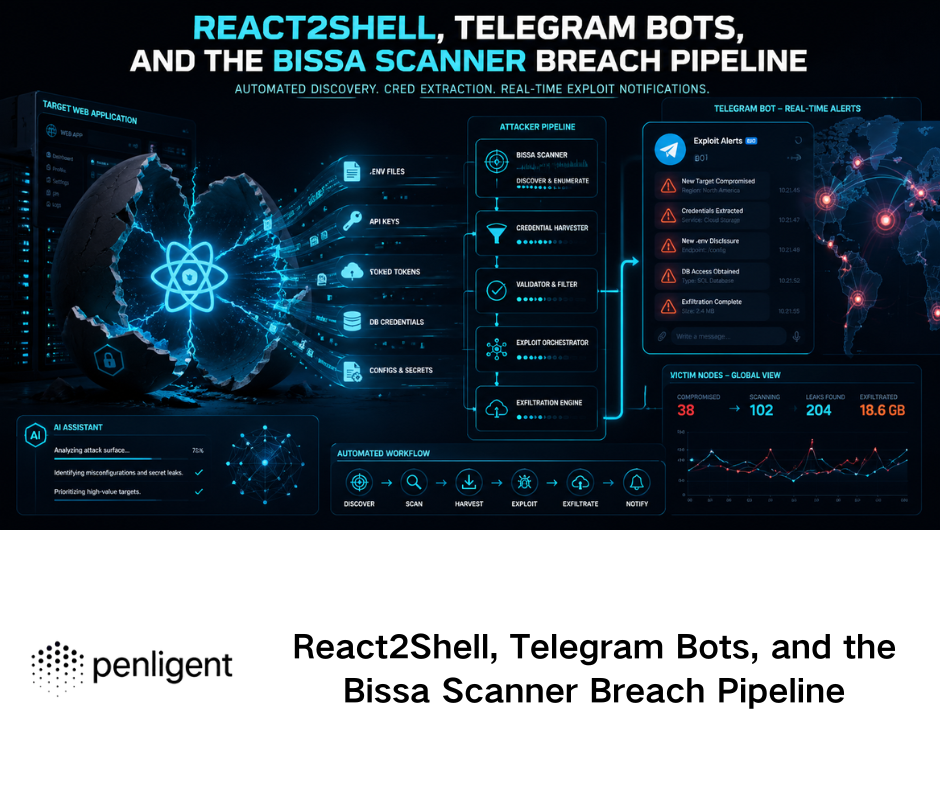

Dois lugares onde a Penligent se encaixa naturalmente

Há uma maneira sensata de conectar o Promptfoo ao Penligent sem forçar a comparação. O Promptfoo é mais forte quando você precisa de uma avaliação estruturada e de uma equipe vermelha sobre o comportamento de um aplicativo LLM ou de um fluxo de trabalho de agente. A Penligent, por outro lado, está naturalmente posicionada mais próxima da validação do caminho do ataque operacional e dos fluxos de trabalho de teste de penetração automatizados em ambientes reais. Os próprios escritos da Penligent sobre segurança agêntica enquadram o problema como uma questão mais ampla de limite de execução envolvendo identidade, memória, ferramentas, esquemas e comunicação entre agentes, o que complementa o modelo de teste de aplicativos da Promptfoo. (Penligente)

Isso significa que uma equipe madura poderia usar razoavelmente os dois estilos de ferramentas em sequência. O Promptfoo pode testar o estresse do próprio aplicativo de IA dentro do desenvolvimento e da CI/CD, enquanto a Penligent pode estender a verificação para serviços expostos, pontos fracos de configuração e caminhos de exploração em várias etapas que são importantes quando o aplicativo está ativo. O artigo sobre injeção de prompt do OpenClaw da Penligent descreve essa camada operacional como uma verificação contínua da exposição e das configurações incorretas em ambientes de agentes, que é um problema diferente, mas relacionado à avaliação de prompt e saída. (Penligente)

A maior lição do Promptfoo

O Promptfoo é importante porque representa uma mudança cultural mais do que uma lista de verificação de recursos. A mudança é de "tentamos alguns prompts e pareceu bom" para "definimos comportamento, casos de abuso, classes de risco e verificações de regressão, e agora podemos provar o que mudou". Foi isso que a engenharia de software fez para garantir a correção dos aplicativos. A segurança da IA agora precisa da mesma mudança para o comportamento do agente, o uso da ferramenta, a integridade do RAG e a confiança no contexto. (Promptfoo)

Os engenheiros de segurança devem levar isso a sério porque o ecossistema já está passando de uma novidade inofensiva para consequências na produção. O problema de divulgação da injeção de comando de IA do Microsoft 365 Copilot, a falha de injeção de código não autenticado do Langflow, o caminho de injeção de comando MCP não confiável do Cursor e a exploração ativa da injeção de expressão n8n são lembretes de que a orquestração em linguagem natural não remove riscos antigos. Ela os agrava ao tornar mais sistemas acessíveis por meio de caminhos de controle mais suaves e ambíguos. (NVD)

O Promptfoo não é a resposta completa para a segurança de IA. Nenhuma ferramenta isolada é. Mas é uma das maneiras mais claras de tornar a segurança de IA testável, revisável, repetível e mais difícil de ser manipulada. Para muitas equipes, esse é o verdadeiro limite que está faltando.

Leitura adicional

Para os leitores que desejam se aprofundar nos padrões subjacentes e nas referências primárias, estes são os melhores pontos de partida: A introdução oficial e o início rápido da equipe vermelha do Promptfoo, que explicam como a plataforma combina avaliação e testes de segurança; a entrada de risco de injeção de prompt LLM da OWASP; o perfil de IA generativa do NIST sob a estrutura de gerenciamento de risco de IA; e as práticas recomendadas de segurança da OpenAI para restringir entradas e saídas em sistemas de produção. (Promptfoo)

Os artigos relevantes da Penligent sobre o mesmo problema incluem Agentic Security Initiative - Protegendo aplicativos de agente na era do MCPque se concentra nos limites do agente, na identidade, na memória e no risco da ferramenta, e O problema de injeção de prompt do OpenClaw - persistência, sequestro de ferramentas e o limite de segurança que não existeque se concentra na verificação contínua de ambientes de agentes e na realidade operacional da injeção imediata além de uma única janela de bate-papo. (Penligente)