Cuando la gente busca un shannon ai pentesting tool alternativa...suelen hacer la pregunta equivocada en la categoría adecuada. La pregunta equivocada es: "¿Qué producto es igual que Shannon, pero más barato, más grande, más rápido o más publicitado?". La pregunta correcta es: "¿Para qué está optimizado Shannon exactamente y qué necesito yo que Shannon no prometa públicamente?". Una vez planteado así, el mercado es mucho más fácil de entender. Shannon no es una "seguridad de IA" genérica. Se trata de un producto centrado y con opiniones técnicas que se posiciona públicamente como un pentester de IA autónomo y de caja blanca para aplicaciones web y API, creado para analizar código fuente, identificar vectores de ataque y ejecutar exploits reales antes de la producción. Su repositorio abierto hace que el posicionamiento sea inusualmente concreto: Shannon Lite es AGPL-3.0, pensado para pruebas locales de tus propias aplicaciones, y espera explícitamente acceso al código fuente y a la disposición del repositorio. (GitHub)

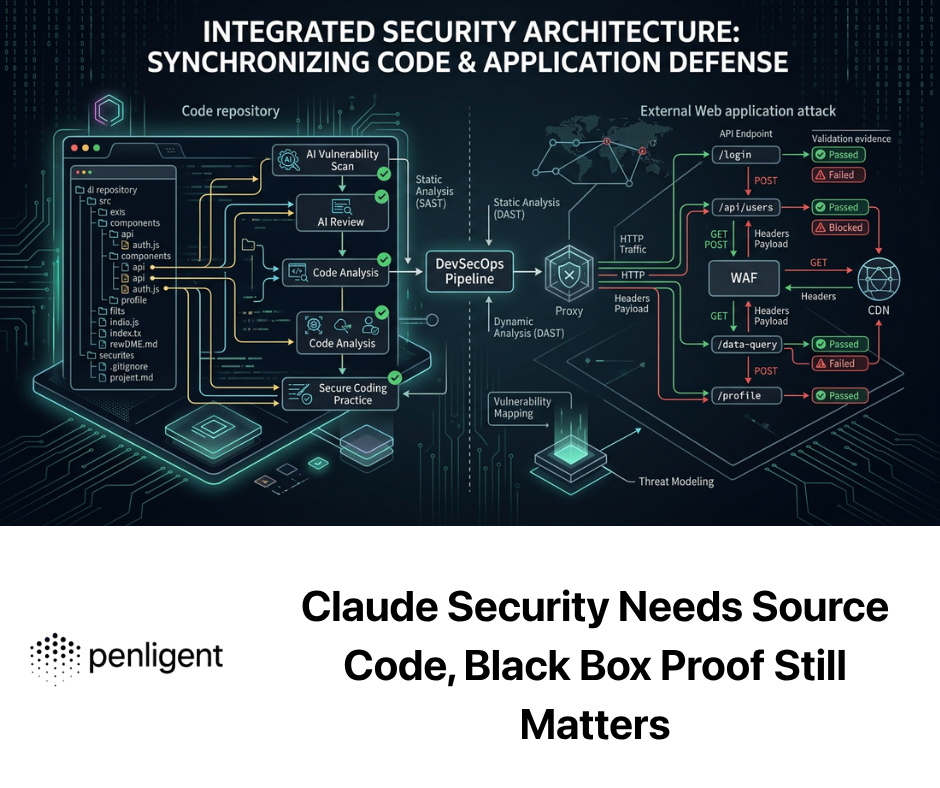

Esto es importante porque gran parte de la conversación sobre el pentesting de IA sigue atrapada en la niebla del marketing. El material público serio de 2025 y 2026 se ha trasladado a algún lugar más útil. El propio repositorio de Shannon hace hincapié en la prueba por explotación y en la filosofía "sin explotación, no hay informe". La reciente cobertura de Help Net Security de las herramientas de pentesting de IA de código abierto sostiene que estos sistemas están empezando a imitar cómo trabajan realmente los probadores humanos, en lugar de limitarse a emitir resultados de análisis estáticos. El escrito público de Aikido plantea un punto muy similar desde el ángulo del producto: un verdadero pentesting de IA no es un chatbot que comenta los hallazgos, sino un sistema que valida los hallazgos contra un objetivo en vivo y descarta lo que no puede confirmar. Ese es el supuesto de fondo que merece esta palabra clave. La verdadera comparación no es chatbot contra chatbot. Es motor de pruebas contra motor de pruebas. (GitHub)

El siguiente error que comete la gente es suponer que existe una "mejor" alternativa universal. No la hay. Si su principal necesidad es validación de exploits en repositorios antes de su publicaciónPuede que Shannon ya esté muy cerca de lo que usted quiere. Si su principal necesidad es validación de la ruta de ataque que conecta el abuso de Internet con el impacto en la identidad y la infraestructuraSin embargo, plataformas como NodeZero se están posicionando públicamente en torno a ese mismo problema. Si su principal necesidad es validación continua de la exposición en todas las capas de seguridadPentera se refiere a la validación de seguridad basada en inteligencia artificial y no a un motor de explotación centrado exclusivamente en aplicaciones. Si su principal necesidad es Pruebas de lógica empresarial nativa de API, Escape se centra públicamente en DAST consciente de la lógica empresarial y en el descubrimiento, el pentesting y la corrección continuos basados en agentes de IA. Si su principal necesidad es profundidad humana con aceleración de IASin embargo, el posicionamiento público de Cobalt sigue siendo fundamentalmente un pentesting dirigido por humanos y aumentado por IA. Y si su principal necesidad es orquestación en lenguaje natural de muchas herramientas ofensivas con informes respaldados por pruebas y flujos de trabajo en equipo, Penligent es una de las alternativas más claras a examinar. (Horizon3.ai)

Así que la forma útil de leer este artículo no es como un concurso de belleza. Es un análisis de ajuste. Shannon es real. La categoría es real. Las alternativas son reales. Lo difícil es entender dónde están realmente los límites, porque esos límites determinan si una herramienta se convierte en un arma diaria en tu flujo de trabajo o simplemente en otra demo que olvidas después de un sprint. (GitHub)

Shannon es creíble, pero su fuerza pública es específica

Una de las razones por las que Shannon se ha abierto paso entre el ruido es que sus materiales públicos son refrescantemente precisos. El repositorio no describe un vago "copiloto de seguridad". Describe un pentester de caja blanca para aplicaciones web y API que combina el análisis del código fuente con la explotación en vivo. La lista pública de características también es concreta: ejecución autónoma de un solo comando, manejo de inicios de sesión 2FA y TOTP, incluido SSO, exploits de prueba de concepto reproducibles, cobertura centrada en inyección, XSS, SSRF y autenticación y autorización rotas, pruebas dinámicas conscientes de la fuente, uso integrado de herramientas como Nmap, Subfinder, WhatWeb y Schemathesis, y fases de análisis y explotación paralelas. Se trata de una afirmación más tajante que la que publican muchos proveedores. (GitHub)

La historia del punto de referencia es parte de la razón por la que el producto llama la atención. El repositorio de Shannon Lite afirma que obtuvo una puntuación del 96,15 por ciento, 100 de 104 exploits, en una variante sin pistas y consciente de la fuente de la prueba de seguridad XBOW. El repositorio también publica informes de muestra contra OWASP Juice Shop, Checkmarx c{api}tal API y OWASP crAPI, con ejemplos de resultados que van desde la omisión de autenticación e inyección SQL hasta SSRF y asignación masiva. Aunque se tomen con la cautela habitual las evaluaciones comparativas de los proveedores, lo importante no es la cifra exacta. Lo importante es que Shannon está apostando su identidad pública por finalización real de la hazañay no en la "calidad del resumen de IA". Eso por sí solo lo sitúa en un grupo más estrecho y serio que la mayoría de las herramientas que utilizan el lenguaje de la IA en el marketing de seguridad. (GitHub)

Su arquitectura refuerza esa identidad. Shannon documenta públicamente un diseño multiagente que ejecuta tareas de reconocimiento, análisis de vulnerabilidades, explotación y elaboración de informes, con el objetivo explícito de minimizar los falsos positivos mediante pruebas. El repositorio afirma que Shannon utiliza el SDK Claude Agent de Anthropic como motor de razonamiento, combina el análisis de código fuente de caja blanca con la explotación dinámica, y guarda extensos artefactos de auditoría, como datos de sesión, registros por agente, instantáneas rápidas y entregables. También es compatible con Google Vertex AI y puntos finales personalizados compatibles con Anthropic, mientras que describe el enrutamiento de proveedores alternativos como experimental y no compatible. Esto nos dice algo importante: Shannon no es sólo "IA en torno a la seguridad". Es un sistema de ejecución con una fuerte opinión sobre cómo debe comportarse la pila de ejecución. (GitHub)

Esa especificidad pública es exactamente la razón por la que existe la palabra clave "alternativo". Los usuarios serios no buscan alternativas porque el original sea falso. Buscan alternativas porque un sistema claramente definido también tiene límites claramente definidos. Shannon Lite hace explícito uno de esos límites en lenguaje llano: es sólo caja blanca y espera el acceso a la fuente. No se trata de una pequeña nota a pie de página. Es la línea divisoria central en la comparación. Si usted es un cazarrecompensas de errores que trabaja con programas de caja negra, una consultoría que prueba superficies de producción de clientes sólo con acceso con credenciales, o un equipo de empresa que no puede entregar bases de código a una nueva cadena de herramientas, el modo público más fuerte de Shannon puede no coincidir con su realidad. En otras palabras, cuanto más creíble parece Shannon, más precisa se vuelve la pregunta alternativa. (GitHub)

El verdadero problema no es reemplazar a Shannon, es reemplazar el vacío alrededor de Shannon.

Los equipos de seguridad a menudo piensan que están comprando una herramienta cuando en realidad están comprando una capa que falta en el flujo de trabajo. La literatura pública en torno al pentesting de IA vuelve una y otra vez al mismo problema estructural. El documento original de PentestGPT descubrió que los grandes modelos lingüísticos eran a menudo fuertes en subtareas como la interpretación de los resultados de las herramientas y la propuesta de las siguientes acciones, pero débiles a la hora de mantener una comprensión integrada del escenario general de las pruebas. La principal lección arquitectónica del documento no era "usa un modelo más grande". Era "dividir el trabajo en módulos coordinados para que el sistema pueda conservar el estado y el contexto". Esa lección sigue siendo importante. La mayoría de las evaluaciones fallidas de esta categoría no son fallos del modelo en abstracto. Son fallos de orquestación, fallos de alcance, fallos de pruebas o fallos de estado. (arXiv)

Por eso la mejor "alternativa a Shannon" puede no parecerse a Shannon en absoluto. Si su problema es que su flujo de trabajo actual pierde el contexto entre el reconocimiento, la explotación, la repetición de pruebas y la generación de informes, es posible que necesite una capa de orquestación más que un motor de explotación de caja blanca. Si su problema es que los ataques modernos se encadenan desde el abuso de la Web a la identidad y la infraestructura, puede que necesite una plataforma de ruta de ataque más que un comprobador de aplicaciones consciente de la fuente. Si su problema es la lógica de autorización de la API y el abuso del flujo de negocio, puede que necesite pruebas especializadas en la API más que una síntesis de exploits consciente de los repositorios. La palabra clave de búsqueda es la misma. La respuesta de ingeniería no lo es. (Horizon3.ai)

El material de OWASP plantea el mismo punto desde un ángulo diferente. OWASP Top 10 2025 mantiene el Control de Acceso Roto en el número uno, incluye SSRF en esa categoría, y sigue tratando la Inyección como una de las categorías más probadas con una gran huella de CVE. OWASP API Security Top 10 2023 destaca Autorización de nivel de objeto rota, Autenticación rota, Autorización de nivel de función rota, SSRF, Gestión de inventario inadecuada y Consumo inseguro de API. No se trata de firmas de escáner aisladas. Son problemas de flujo de trabajo. Viven en la intersección del código, el comportamiento en tiempo de ejecución, la lógica de autorización, la configuración del entorno y la proliferación de activos. Cualquier herramienta que pretenda ser una alternativa seria a Shannon tiene que demostrar cómo gestiona esa intersección, no sólo lo ingeniosamente que escribe los avisos. (Fundación OWASP)

La forma más rápida de tomar una mala decisión de compra es pedir a un producto que resuelva un tipo de problema distinto para el que fue creado. Los materiales públicos de Shannon sugieren que es más fuerte donde la disponibilidad de la fuente, la prueba de explotación y la validación centrada en la aplicación son la prioridad. Eso ya es una porción valiosa. La cuestión es qué se necesita más allá de esa porción. (GitHub)

Lo que Shannon hace especialmente bien, según las pruebas públicas

Lo primero que Shannon hace claramente bien es convertir la señal teórica de AppSec en hallazgos de aplicaciones respaldados por exploits. Su repositorio enfatiza repetidamente que las vulnerabilidades no se reportan a menos que puedan convertirse en pruebas de concepto. Para los equipos agotados por el ruido de los escáneres, se trata de una decisión de diseño significativa. También es una de las razones por las que el producto se siente más cercano a la validación ofensiva que al DAST convencional con una capa LLM adjunta. La documentación describe incluso cómo los hallazgos estáticos en Shannon Pro se transfieren a los agentes de explotación y, una vez confirmados, se rastrean hasta las ubicaciones de origen exactas. Públicamente, es una de las historias de correlación estática-dinámica mejor articuladas del mercado actual. (GitHub)

La segunda cosa que Shannon hace bien es utilizar el conocimiento de las fuentes para guiar la explotación dinámica. Esto es importante porque muchas vulnerabilidades web no son difíciles en abstracto, pero son caras de alcanzar en la práctica. El trabajo duro consiste a menudo en encontrar la ruta correcta, el parámetro, el caso límite de autorización o el punto final heredado en el que el fallo es realmente accesible. El diseño público de Shannon dice que utiliza el análisis del código fuente para identificar probables vectores de ataque y luego los valida con exploits basados en navegador y CLI. Para un equipo que prueba su propia aplicación antes del lanzamiento, esa es exactamente la asimetría correcta: utilizar el acceso al código para reducir el coste de la búsqueda, y luego obligar a la herramienta a demostrar el impacto en tiempo de ejecución. (GitHub)

La tercera cosa que hace bien es publicar un límite estrecho pero legible. Shannon Lite es local y de caja blanca. Shannon Pro es comercial y se expande a una plataforma AppSec más amplia con SAST, SCA, secretos, pruebas de lógica empresarial, integración CI/CD y despliegue autoalojado. Esta división es útil porque indica a los evaluadores cuál es el artefacto abierto y cuál es la historia comercial más amplia. Demasiadas herramientas ocultan esta distinción. Shannon no lo hace. Si usted es un constructor decidiendo si incorporarlo en las pruebas internas de sus propias aplicaciones, esa transparencia es útil. (GitHub)

La cuarta cosa que hace bien es producir artefactos de auditoría. El repositorio afirma que Shannon almacena instantáneas de avisos, registros de agentes, datos de sesión y resultados finales. En una herramienta ofensiva de IA, eso importa más de lo que muchos compradores creen. Uno de los mayores problemas operativos de los sistemas de seguridad basados en agentes es la incapacidad de reconstruir por qué un agente tomó una decisión, qué pruebas vio y qué hizo exactamente. Los registros documentados públicamente y las instantáneas de los avisos no resuelven todo el problema, pero son un paso significativo hacia la reproducibilidad. (GitHub)

Por eso, descartar a Shannon como "otra demostración de pentest de IA" sería un análisis perezoso. Es más disciplinado que eso. El movimiento más productivo es respetar el diseño público, y luego identificar dónde su entorno necesita un centro de diseño diferente. (GitHub)

Donde el límite público de Shannon se convierte en tu restricción

La primera restricción obvia es dependencia de la fuente. Shannon Lite es sólo de caja blanca, y el repositorio lo dice directamente. Si no tiene el código fuente, o no puede conceder acceso al código fuente de forma operativa, ya no está utilizando el producto en su modo público más potente. Esto afecta inmediatamente al trabajo de bug bounty, a las evaluaciones de terceros, a la diligencia de fusiones y adquisiciones, a algunos escenarios empresariales regulados y a cualquier entorno en el que el equipo de seguridad esté validando sistemas accesibles externamente a través de muchas unidades de negocio sin acceso a nivel de repositorio. En esos entornos, la alternativa ideal no es "Shannon, pero mejor". Es "un sistema optimizado para la realidad de caja negra o señal mixta". (GitHub)

La segunda restricción es ámbito centrado en la aplicación. Shannon es público sobre aplicaciones web y API. Eso ya es mucho, pero muchos compromisos reales no se detienen ahí. El posicionamiento público de Horizon3.ai en torno a NodeZero WebApp Pentest es un contraste útil: habla de rastrear rutas de ataque desde el acceso autenticado y el abuso de aplicaciones hasta el compromiso de la nube y el host local, argumentando explícitamente que los ataques reales se encadenan a través de aplicaciones web, identidad e infraestructura. Esto no hace a Shannon más débil en su propia tarea. Simplemente muestra un centro de gravedad diferente. Si su conversación sobre riesgos está dominada por el movimiento lateral y el radio de explosión en lugar de la prueba de aplicaciones aisladas, un tipo diferente de plataforma puede encajar mejor. (Horizon3.ai)

La tercera restricción es forma del flujo de trabajo. Muchos equipos no buscan un motor autónomo de un solo mando, sino un banco de trabajo ofensivo controlable. Esta distinción suena semántica hasta que se observa cómo trabajan realmente los ingenieros. Quieren ajustar el alcance, intercambiar herramientas, preservar artefactos, volver a ejecutar sólo las partes costosas, manejar flujos autenticados de múltiples roles, colaborar con compañeros de equipo y convertir los hallazgos en un informe sin reconstruir el contexto a mano. La guía de seguridad pública de Aikido es útil en este caso porque argumenta que la aplicación del alcance no puede depender únicamente de avisos, y que la verificación de la propiedad y las listas de permisos a nivel de red son requisitos básicos. Los materiales públicos de Penligent plantean una cuestión diferente pero complementaria: editar las indicaciones, bloquear el alcance, personalizar las acciones, orquestar muchas herramientas y mantener las pruebas juntas. Son respuestas diferentes al mismo problema operativo. (Aikido)

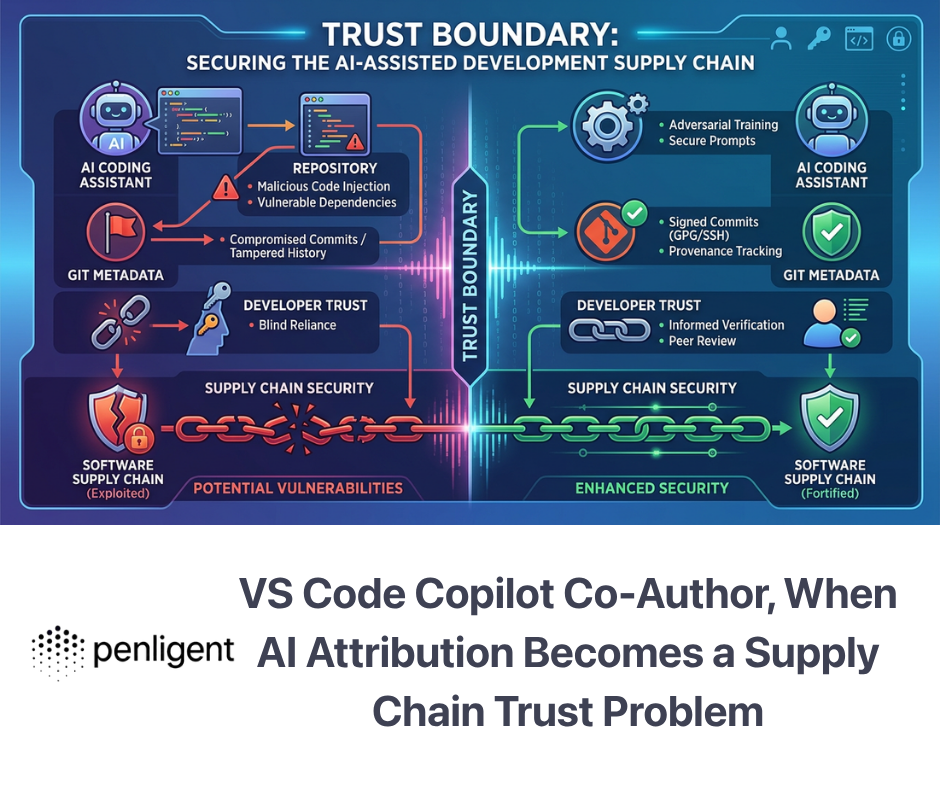

La cuarta restricción es dependencia de la pila del modelo. Shannon declara públicamente que está construido sobre el SDK de Agente de Anthropic y probado principalmente con modelos de Claude, mientras que el enrutamiento de proveedor alternativo es experimental y no está soportado y puede producir resultados inconsistentes, incluyendo fallos en fases tempranas como el reconocimiento. Esto no es un defecto en sí mismo. La concentración suele generar fiabilidad. Pero sí importa si su organización se ha estandarizado en una pila de inferencia diferente, o quiere un control más estricto sobre dónde se produce la ejecución del modelo y cómo se envuelve la aplicación de políticas. El despliegue y la arquitectura de inferencia forman parte del producto, no son una ocurrencia tardía. (GitHub)

Si siente esas limitaciones mientras lee, eso no es un argumento en contra de Shannon. Es el comienzo de una buena evaluación alternativa. La palabra clave cobra sentido en el momento en que se deja de tratar "alternativa" como un concurso de popularidad y se empieza a tratar como un diagnóstico de falta de capacidad. (GitHub)

Lo que una alternativa seria debería mejorar, no sólo imitar

Una alternativa seria a Shannon debería hacer al menos una de estas cinco cosas mejor.

Debería ser mejor en pruebas de caja negra y caja mixta. Eso significa trabajar bien cuando el acceso al código es parcial, no existe o está bloqueado por motivos organizativos. Una herramienta que sólo brilla cuando puede leer el repositorio puede seguir siendo excelente, pero no es la respuesta adecuada para todos los compromisos.

Debería ser mejor en encadenamiento de ataques entre dominios. Si su modelo de amenazas se preocupa por cómo el abuso de aplicaciones se convierte en compromiso de identidad, acceso a la nube, toma de control del host o impacto en el dominio, entonces la prueba de sólo aplicaciones no es toda la historia.

Debería ser mejor en Abuso de la lógica de la API y del flujo de negocio. La lista de API de OWASP existe por una razón. BOLA, autorización a nivel de función rota, flujos de negocio sensibles y gestión de inventario inadecuada sobreviven rutinariamente a escaneos superficiales porque requieren contexto y estado, no sólo generación de carga útil. (Fundación OWASP)

Debería ser mejor en control del flujo de trabajo y ajuste del equipo. El bloqueo del alcance, la gestión de flujos autenticados, la colaboración, los activadores de CI/CD, la trazabilidad de auditoría y la implementación privada no son características glamurosas, pero son exactamente lo que separa las plataformas de uso diario de los experimentos puntuales. Los precios públicos y el material de flujo de trabajo de Penligent hacen hincapié en las pruebas multirol autenticadas, la integración de CI/CD, la trazabilidad lista para auditoría, la implementación privada y la orquestación en lenguaje natural a través de más de 200 herramientas. Tanto si esa es su interfaz preferida como si no, se trata de respuestas de flujo de trabajo reales. (Penligente)

O debería ser mejor en profundidad humana. El posicionamiento público de Cobalt sigue abogando por un pentesting dirigido por humanos y aumentado por IA. Si su entorno requiere abuso creativo, razonamiento lógico empresarial matizado o confianza a nivel directivo en investigadores nombrados, "alternativo" puede significar no sustituir la capa humana en absoluto. Puede significar acelerar todo lo que rodea a esa capa. (Cobalto)

Esa es la prueba. Una alternativa real no gana por parecer similar. Gana resolviendo el siguiente problema que surja después de que el diseño público de Shannon haya resuelto el primero. (GitHub)

El mapa del mercado, qué tipo de alternativa busca realmente

| Categoría | Posicionamiento público | Mejor ajuste | En qué se diferencia de Shannon | Fuente |

|---|---|---|---|---|

| Shannon Lite y Shannon Pro | Pentesting autónomo de caja blanca, prueba por explotación, Lite para aplicaciones de código fuente local, Pro añade AppSec y CI/CD más amplios. | Equipos que prueban sus propias aplicaciones web con acceso al código fuente | Más fuerte cuando se tiene en cuenta el repositorio y se centra en la aplicación | (GitHub) |

| NodeZero WebApp Pentest | Pruebas autónomas de aplicaciones web, identidad e infraestructura, con pruebas de rutas de ataque e impacto en la empresa. | Equipos que se preocupan por el radio de explosión de la aplicación y la exposición encadenada | Validación de rutas entre dominios más amplia que la de las pruebas de aplicaciones. | (Horizon3.ai) |

| Pentera | Validación continua de la seguridad por capas mediante IA | Las empresas dan prioridad a los bucles de validación y corrección de la exposición | Más orientado a la plataforma de validación que al motor de explotación consciente de los repositorios. | (Pentera) |

| Escapar | Detección, pentesting y corrección basados en agentes de IA, DAST con conciencia de la lógica empresarial | Organizaciones con muchas API y equipos de AppSec centrados en el abuso de la lógica | Más centrado en la API y la lógica empresarial | (Escapar) |

| Cobalto | Pentesting y PTaaS dirigidos por humanos y potenciados por IA | Compradores que quieren experiencia humana con aceleración de IA | Mantiene la profundidad humana como modelo básico | (Cobalto) |

| Penligente | Orquestación en lenguaje natural, más de 200 herramientas, cadenas de ataque respaldadas por pruebas, pruebas de flujo autenticadas, CI/CD, trazabilidad lista para auditoría. | Equipos que desean una capa de flujo de trabajo ofensivo flexible, no sólo un motor de explotación fijo. | Más centrado en la orquestación y el flujo de trabajo, incluidos niveles de despliegue privados | (Penligente) |

El objetivo de esta tabla no es clasificar todos los productos en una línea. Es evitar que la comparación se derrumbe en "cuál dice AI más alto". Públicamente, estas herramientas no prometen lo mismo. Shannon es más específico que eso. Sus alternativas son más diferentes de lo que la mayoría de los compradores esperan. (GitHub)

Si quiere la alternativa técnica más cercana, empiece por la clase de problema, no por la marca

La alternativa técnica más cercana a Shannon no es necesariamente el producto con más palabras coincidentes en el texto de la página de inicio. Es el producto que más se acerca a la clase de problema.

Si la clase del problema es validación de exploits antes de su despliegueEn el caso de Shannon Lite, antes de compararlo con el resto del mercado, hay que compararlo con su propia expansión comercial, Shannon Pro. Públicamente, Shannon Pro amplía el modelo Lite a SAST agéntico, SCA, detección de secretos, pruebas de seguridad de lógica empresarial, correlación estática-dinámica, integración CI/CD y despliegue autoalojado. Eso importa porque muchos evaluadores saltan directamente de un artefacto de código abierto a una familia de productos completamente diferente, cuando la comparación más nítida suele ser "modo de núcleo abierto frente a modo de pila completa comercial". (GitHub)

Si la clase del problema es validación de la ruta de ataque de la aplicación a la infraestructuraNodeZero es una de las alternativas públicas más claras. Horizon3.ai dice explícitamente que los atacantes no se limitan a "hackear"; entran, abusan de la lógica de la aplicación, escalan privilegios y pivotan en la infraestructura. Su material de pentest de aplicaciones web posiciona el producto en torno al acceso autenticado, el abuso encadenado y el impacto en el negocio en lugar de hallazgos aislados. Se trata de una distinción significativa si las partes interesadas se preocupan más por lo lejos que puede llegar un atacante que por si un exploit web tiene un rastro de código fuente limpio. (Horizon3.ai)

Si la clase del problema es validación continua en toda la pila de seguridadPentera está más cerca de una plataforma de validación que de un pentester de IA consciente de la fuente. Su marco público gira en torno a la validación de seguridad impulsada por IA y la reducción continua de la exposición a través de las capas de ciberseguridad. Esta es a menudo la alternativa correcta cuando su organización ya tiene una seguridad de aplicaciones profunda pero carece de una forma continua de poner a prueba su postura de seguridad. No se trata tanto de ser inteligente a la hora de encontrar un fallo en una aplicación como de identificar continuamente las brechas reales que importan desde el punto de vista operativo. (Pentera)

Si la clase del problema es Seguridad de las API y abuso de la lógica empresarialEscape es una de las alternativas más coherentes. Públicamente, hace hincapié en el DAST consciente de la lógica empresarial, el descubrimiento, las pruebas y la corrección impulsados por agentes de IA. Esto es útil en organizaciones donde la aplicación web es realmente una superficie API, el riesgo principal es la autorización y el abuso del flujo de negocio, y el equipo de ingeniería quiere una estrecha integración con los flujos de trabajo API modernos en lugar de un tiempo de ejecución ofensivo de propósito general. (Escapar)

Si la clase del problema es mantener a los humanos en el bucle, pero eliminar la pesadezCobalt sigue siendo más adecuado que muchos sistemas totalmente autónomos. El lenguaje de su plataforma pública es explícito: La IA se encarga del reconocimiento, la exploración y el triaje para que los pentesters humanos puedan centrarse en la explotación activa y la profundidad de alto impacto. Esto no es anticuado. En muchos entornos es exactamente lo correcto. Muchos equipos no quieren menos juicio humano. Quieren más juicio humano concentrado en la parte más estrecha y de mayor aprovechamiento del trabajo. (Cobalto)

Y si la clase problemática es comprimir la proliferación de herramientas en un flujo de trabajo controlable y respaldado por pruebasPenligent es una de las alternativas a Shannon más naturales que se pueden evaluar. Sus materiales públicos describen la orquestación en lenguaje natural a través de más de 200 herramientas, cadenas de ataque reproducibles, mapeos de pruebas y control, pruebas de flujo autenticadas, integración CI/CD, trazabilidad lista para auditoría, control de acceso basado en roles, SSO/SAML y opciones de despliegue on-prem. Esto no lo convierte en una copia de Shannon. Lo convierte en una opción sólida para equipos cuyo problema es menos "necesito el mejor motor de explotación de caja blanca" y más "necesito que el flujo de trabajo ofensivo deje de fragmentarse a través de terminales, pestañas, scripts y reconstrucciones de informes". (Penligente)

Por qué el flujo del CVE de 2025 a 2026 cambia esta decisión de compra

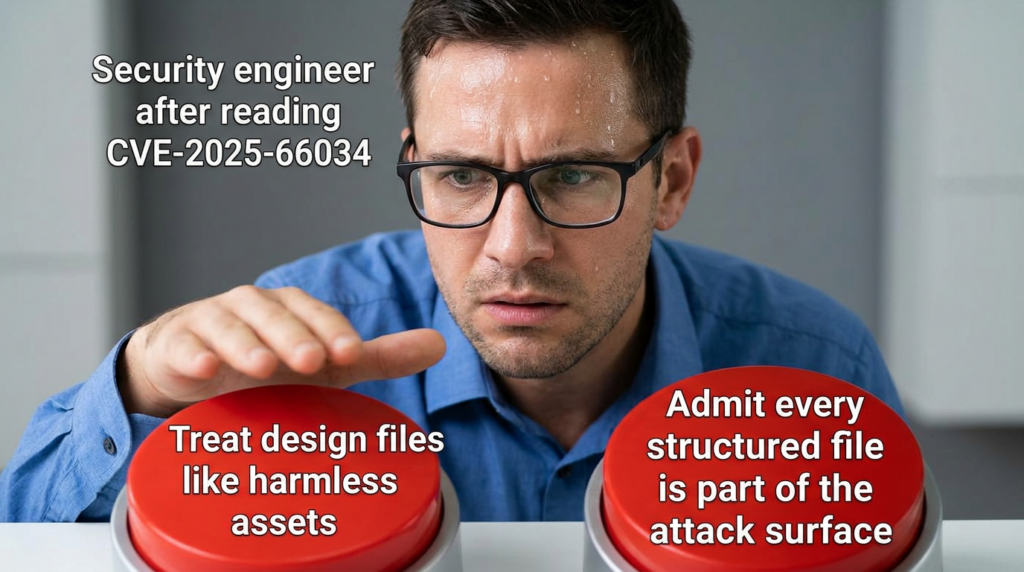

Un artículo alternativo útil no debería quedarse en el nivel de copia de producto. El reciente panorama de vulnerabilidades demuestra por qué la "validación de exploits" y el "ajuste al flujo de trabajo" importan más que los adjetivos de los proveedores.

Toma CVE-2025-29927La vulnerabilidad de Next.js, eludir la autorización del middleware. Tanto el aviso de GitHub como el NVD describen un fallo crítico por el que las comprobaciones de autorización podían ser eludidas si se producían en el middleware. Las versiones parcheadas incluyen 12.3.5, 13.5.9, 14.2.25 y 15.2.3, y el aviso de GitHub señala que los despliegues alojados en Vercel estaban protegidos automáticamente, mientras que las aplicaciones autoalojadas necesitaban parches o una mitigación basada en cabeceras. Este es el tipo de vulnerabilidad que expone una diferencia crucial entre productos. Un escáner superficial puede decirle que hay una versión de paquete vulnerable. Un sistema más serio necesita decirle si el patrón de middleware vulnerable está realmente en su ruta de petición, si la corrección existe en su entorno, si su pila de borde bloquea la cabecera de riesgo, y si las rutas de riesgo son accesibles bajo su modelo de autenticación real. (GitHub)

Entonces mira CVE-2025-25257El problema de inyección SQL no autenticada de FortiWeb. El propio PSIRT de Fortinet dice que puede permitir a un atacante no autenticado ejecutar código SQL no autorizado o comandos a través de peticiones HTTP o HTTPS y que la explotación se ha observado en la naturaleza. La entrada NVD refleja la inyección SQL no autenticada contra las versiones FortiWeb afectadas, y los avisos públicos destacan que no se trataba de un caso extremo hipotético. Aquí la lección es diferente. La cuestión no es sólo si una herramienta puede decir "existe inyección SQL". La cuestión es si puede reconocer una superficie de gestión orientada a Internet, priorizarla correctamente porque se observa explotación, y convertir ese conocimiento en un flujo de trabajo de validación y corrección específico. Ahí es donde las plataformas de validación continua, los probadores agénticos y los bancos de trabajo basados en pruebas empiezan a divergir de los escáneres genéricos. (Laboratorios FortiGuard)

Un tercer ejemplo es CVE-2025-53018, una vulnerabilidad SSRF crítica en Lychee's /api/v2/Foto::fromUrl punto final. Tanto el NVD como el aviso de seguridad de GitHub de Lychee describen un caso en el que las URL no validadas proporcionadas por el usuario permitían al backend obtener destinos arbitrarios, incluidos servicios localhost y puntos finales de metadatos en la nube. Este es un ejemplo perfecto de por qué SSRF sigue siendo una prueba de fuego para los sistemas de pentesting modernos. Detectar SSRF en teoría no es suficiente. Las preguntas útiles son si la herramienta puede ver que el punto final es accesible, si entiende qué objetivos internos de alto valor serían importantes en ese entorno, si respeta el alcance y la seguridad mientras realiza las pruebas, y si puede producir una ruta de remediación en la que los desarrolladores realmente confíen. (NVD)

El punto más amplio es que CISA continúa manteniendo y actualizando su Catálogo de Vulnerabilidades Explotadas Conocidas basado en evidencia de explotación activa. Esto debería determinar la forma de evaluar cualquier plataforma de pentesting de IA. Una verdadera plataforma no debería limitarse a enumerar las CVE. Debería ayudarle a decidir qué CVE importan en su ruta de ataque, en su modelo de despliegue, bajo su comportamiento de autenticación y enrutamiento. Eso es lo que separa la automatización ofensiva útil de la ansiedad automatizada. (CISA)

La lente moderna de OWASP, lo que su alternativa debe cubrir en la práctica

OWASP Top 10 2025 y API Security Top 10 2023 proporcionan una lente práctica para esta palabra clave, ya que mapean directamente donde los actuales sistemas de pentesting de IA tienen éxito o fracasan. Broken Access Control sigue siendo el número uno en OWASP 2025, y OWASP dice explícitamente que SSRF se ha incluido en esa categoría. La inyección sigue siendo una de las categorías más probadas y con la mayor huella de CVE asociada. Por el lado de las API, OWASP sigue haciendo hincapié en BOLA, autenticación rota, autorización a nivel de función rota, SSRF, gestión de inventario inadecuada y consumo inseguro de API. En pocas palabras, el riesgo más difícil de las aplicaciones modernas rara vez es "encontrar un XSS reflejado". Es "entender el modelo de autorización, entender el modelo de objetos, entender los puntos finales ocultos y probar el impacto en el negocio". (Fundación OWASP)

Esto tiene dos implicaciones para la pregunta alternativa de Shannon.

Primero, la autorización es el rey. Si una herramienta no puede razonar sobre la propiedad de los objetos, los límites de los roles, las variantes de ruta, las API heredadas ocultas y las transiciones de identidad en varios pasos, su rendimiento será inferior justo donde las aplicaciones modernas son más débiles. Los resultados de las muestras públicas de Shannon en torno a la omisión de autenticación, el abuso del flujo de trabajo de registro, la omisión de autenticación de API heredadas, la asignación masiva y los ataques JWT sugieren que entiende bien este espacio de problemas en entornos controlados de caja blanca. Las plataformas centradas en API, como Escape, abordan el mismo reto desde una dirección diferente. NodeZero lo enmarca como el comienzo de vías de ataque más amplias. El lenguaje de precios públicos de Penligent en torno a las pruebas de flujo autenticado con verificación multirol indica que también trata la complejidad de la autenticación como una arquitectura de producto y no como una nota a pie de página. (GitHub)

Segundo, el inventario y el contexto están infravalorados. OWASP API 2023 llama explícitamente la atención sobre la gestión inadecuada del inventario. Esto es importante porque muchos hallazgos graves viven ahora en rutas olvidadas, versiones de API obsoletas, puntos finales de depuración ocultos y límites de servicio que nadie documentó adecuadamente. El lenguaje del informe de muestra público de Shannon sobre puntos finales ocultos y API heredadas es revelador. También lo es el lenguaje público de Penligent en torno a la correlación de activos y el descubrimiento de API sensibles. También lo es la forma en que NodeZero habla de web, identidad e infraestructura como una cadena en lugar de silos separados. Los compradores a menudo piensan que están comparando "motores de búsqueda" cuando la mejor comparación es en realidad "motores de contexto". (Fundación OWASP)

Un ejemplo de código seguro, el tipo de mitigación y validación que revela la calidad de la herramienta

El bypass del middleware Next.js es un buen ejemplo de una vulnerabilidad en la que se hace evidente la diferencia entre un escáner y una plataforma útil. El aviso de GitHub recomienda bloquear las peticiones externas que contengan el código x-middleware-subrequest si la aplicación inmediata de parches es inviable. Una regla de borde temporal básica podría tener este aspecto en una implementación de estilo NGINX.

map $http_x_middleware_subrequest $block_middleware_subrequest {

por defecto 1;

"" 0;

}

servidor {

listen 443 ssl;

nombre_servidor app.ejemplo.com;

if ($block_middleware_subrequest) {

return 403;

}

location / {

proxy_pass http://next_upstream;

}

}

Esta no es la respuesta permanente. La respuesta permanente es parchear a una versión fija de Next.js. Pero muestra el tipo de flujo de trabajo que una plataforma seria debe soportar: detectar la versión del componente afectado, entender si la autorización basada en middleware está realmente en uso, validar si el encabezado de riesgo llega a la aplicación, confirmar si la mitigación de borde funciona, y registrar las pruebas para que la ingeniería pueda volver a probar después de parchear. Cualquier producto que se detenga en "CVE crítico detectado" no está resolviendo el problema operativo. (GitHub)

Un ejemplo de SSRF plantea la misma cuestión desde el punto de vista defensivo. Una puerta de lista de permisos mínima para las recuperaciones del lado del servidor no es glamurosa, pero revela si una herramienta puede razonar sobre el abuso real en tiempo de ejecución en lugar de limitarse a la coincidencia de firmas.

from urllib.parse import urlparse

import ipaddress

import socket

ALLOWED_SCHEMES = {"https"}

ALLOWED_HOSTS = {"images.example-cdn.com"}

def is_safe_remote_url(url: str) -> bool:

parsed = urlparse(url)

if parsed.scheme not in ALLOWED_SCHEMES:

return False

si parsed.hostname no está en ALLOWED_HOSTS:

return False

probar:

resolved_ip = socket.gethostbyname(parsed.hostname)

ip_obj = ipaddress.ip_address(resuelto_ip)

if ip_obj.is_private or ip_obj.is_loopback or ip_obj.is_link_local:

return False

excepto Excepción:

return False

return True

Lo que importa aquí no es el fragmento en sí. Es la pregunta de evaluación que lo rodea. ¿Puede el producto encontrar la ruta de obtención del servidor? ¿Puede distinguir una búsqueda saliente inofensiva de otra que puede llegar a rangos privados o servicios de metadatos? ¿Puede preservar los controles de alcance durante las pruebas? ¿Puede ayudar a los desarrolladores a convertir el hallazgo en un parche seguro en lugar de limitarse a volcar ideas sobre la carga útil SSRF en un informe? El aviso de Lychee es un recordatorio de que esta clase sigue siendo muy real. (GitHub)

Dónde encaja Penligent de forma natural en esta comparación

Hay una forma perezosa de inyectar Penligent en esta palabra clave y una forma útil. La forma perezosa es decir "la alternativa de Shannon es igual a Penligent, fin de la historia". La forma útil es identificar el perfil de comprador específico para el que Penligent encaja mejor que el diseño público de Shannon de "primero la caja blanca".

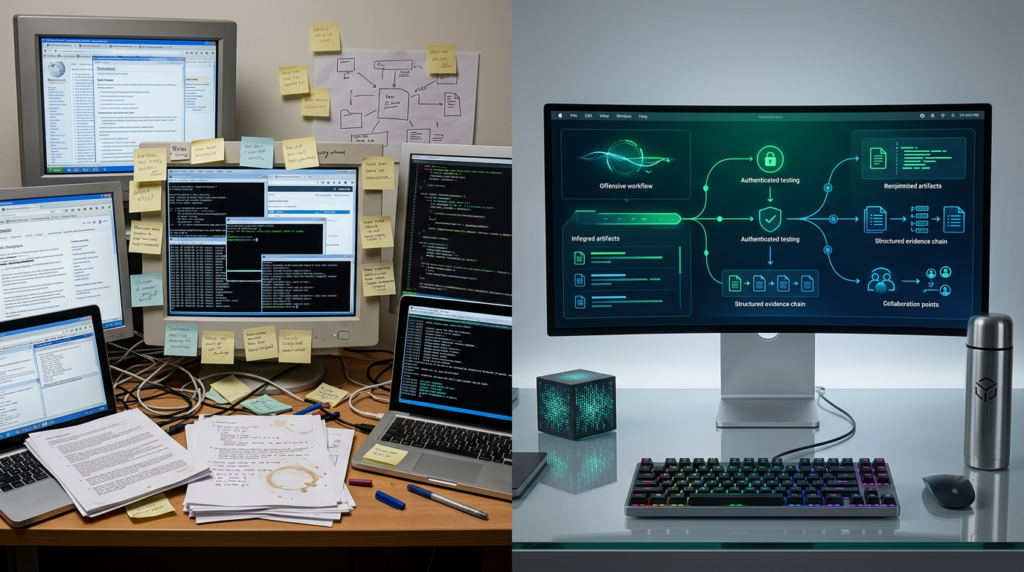

Ese perfil de comprador suele ser el siguiente: el equipo está menos interesado en un motor de exploits fijo y consciente de los repositorios y más interesado en comprimir un flujo de trabajo ofensivo fragmentado en un sistema controlable, auditable y respaldado por pruebas. El material público de Penligent es explícito sobre esa elección de diseño. Enmarca el problema en la proliferación de herramientas y la pérdida de contexto, y presenta el producto como una orquestación en lenguaje natural de más de 200 herramientas, que produce cadenas de ataque reproducibles con asignaciones de pruebas y control. El material de su plataforma pública también hace hincapié en los flujos de trabajo agénticos que el operador puede controlar, mientras que las páginas de precios añaden pruebas de flujo autenticadas con verificación multirol, integración CI/CD, informes estandarizados con trazabilidad lista para auditoría, SSO/SAML, pools de crédito compartidos y opciones de despliegue on-prem o aislado para niveles superiores. Si esas son las capacidades que faltan en su proceso actual, Penligent no es solo una alternativa de marketing. Es una alternativa de flujo de trabajo. (Penligente)

Esta distinción es aún más importante en los equipos que no quieren que una herramienta sustituya totalmente la opinión del operario. Muchos ingenieros experimentados no quieren una caja negra autónoma que funcione sin fricciones. Quieren un sistema que acorte el camino de la intención a la evidencia, manteniendo intactos el control del operador, la disciplina del alcance y la calidad de los artefactos. El lenguaje de Public Penligent en torno a la edición de avisos, el bloqueo del alcance y la personalización de acciones es importante en ese contexto. Implica una filosofía de producto más cercana a "AI-native offensive workbench" que a "hands-off autonomous pentester". Para muchos equipos reales, eso es una característica, no un compromiso. (Penligente)

Aquí es también donde Penligent se sitúa de forma diferente a Cobalt y de forma diferente a NodeZero. Cobalt sigue siendo más fuerte cuando el investigador humano es el centro de gravedad. NodeZero es más fuerte cuando la prueba de radio de explosión a través de la web, la identidad y la infraestructura es la cuestión principal. En cambio, los materiales públicos de Penligent apuntan hacia un modelo que da prioridad a la orquestación: reunir herramientas, flujos de autenticación, captura de pruebas, reproducción de exploits, colaboración y entrega. Por eso merece estar en esta conversación, pero no como un sustituto forzado para cada caso de uso de Shannon. (Horizon3.ai)

Un plan práctico de evaluación de una semana para cualquier alternativa de Shannon

La mayoría de los equipos evalúan mal estas herramientas. Ejecutan una demostración llamativa, ven un exploit impresionante y luego extrapolan la arquitectura a partir del teatro. Un método mejor es construir un benchmark pequeño, seguro y autorizado en torno a su propio flujo de trabajo. Los propios escritos públicos de Penligent sobre la evaluación de modelos dan en el clavo en este punto: no copie batallas rápidas de las redes sociales; construya un pequeño punto de referencia interno en torno al triaje de repositorios, el razonamiento de flujo autenticado, el filtrado de falsos positivos, la calidad de las pruebas y el tiempo ahorrado. Este consejo también se aplica a la evaluación de productos. (Penligente)

Comience seleccionando cuatro tipos de objetivos. Utilice una aplicación de prueba disponible en origen, una aplicación autenticada de caja negra, una API con límites de función reales y un entorno en el que el riesgo interesante sea el encadenamiento de ataques en lugar del abuso de aplicaciones aisladas. Esta combinación obliga a cada producto a revelar su verdadero centro de gravedad. Shannon debería hacerlo mejor en la aplicación disponible en origen. Las plataformas centradas en API deberían revelar su fuerza lógica de autorización en el objetivo API. Las plataformas de rutas de ataque deberían mostrar su valor en el entorno encadenado. Las plataformas de flujo de trabajo deben mostrar si preservan el control, el contexto y la reproducibilidad en los cuatro entornos.

Luego puntúa con una rúbrica como ésta.

evaluación:

exploit_validation:

pregunta: "¿El hallazgo viene con pruebas de que funcionó en el objetivo vivo?".

score_range: 0-5

estado_retención:

Pregunta: "¿Conserva el sistema el contexto a lo largo del reconocimiento, explotación, repetición de pruebas e informe?"

rango_puntuación: 0-5

razonamiento_de_autenticidad_y_de_rol:

Pregunta: "¿Puede manejar flujos autenticados y distinguir múltiples roles limpiamente?".

rango_puntuación: 0-5

alcance_y_seguridad:

Pregunta: "¿Son los controles de alcance ejecutables, auditables y no sólo basados en avisos?"

rango_puntuación: 0-5

api_and_business_logic_depth:

pregunta: "¿Puede razonar sobre BOLA, autenticación rota a nivel de función y abuso del flujo de negocio?"

rango_puntuación 0-5

ci_cd_and_team_fit:

Pregunta: "¿Puede la salida ajustarse a cómo trabajan realmente ingeniería, AppSec y auditoría?".

score_range: 0-5

evidence_quality:

Pregunta: "¿Están los logs, capturas de pantalla, peticiones, PoCs e informes lo suficientemente estructurados como para enviarlos?".

score_range: 0-5

ajuste_despliegue_y_privacidad:

Pregunta: "¿Se ajusta el modelo de despliegue a nuestras restricciones de fuente, modelo y red?".

rango_puntuación: 0-5

Este estilo de evaluación es mejor porque evita que la categoría se colapse en una métrica de vanidad. El 96,15% de referencia de Shannon es impresionante en el contexto en que se realizó. Pero su equipo no está comprando una cifra. Está comprando un flujo de trabajo, un modelo de seguridad, un modelo de despliegue y un modelo de confianza. Por eso también son útiles los requisitos de seguridad pública de Aikido. La validación de la propiedad, la autorización técnica y la lista de permisos a nivel de red no son extras opcionales. Son prerrequisitos para tomarse en serio cualquier sistema agentivo ofensivo. (GitHub)

Qué deben elegir realmente los distintos compradores

Si usted es un desarrollador o equipo interno de AppSec que prueba su propia aplicación web de código fuente disponible antes de su publicaciónShannon es una de las opciones públicas más sólidas de la actual categoría abierta. Ese es el escenario para el que está más visiblemente construido. Antes de buscar en otra parte, compara si Shannon Lite más el proceso interno es suficiente, o si la expansión comercial más amplia de AppSec de Shannon Pro es la comparación real que necesitas hacer. (GitHub)

Si usted es un cazador de bichos o evaluador de cajas negrasEl requisito público de caja blanca de Shannon es el desajuste más obvio. Es más probable que se beneficie de una alternativa orientada al flujo de trabajo, un sistema de pruebas de caja negra o simplemente un banco de trabajo sólido que preserve el contexto y las pruebas sin asumir el acceso al repositorio. En ese carril, Penligent es más fácil de justificar que Shannon en materiales públicos, porque su posicionamiento es menos dependiente del acceso a la fuente y más centrado en la orquestación de flujos de trabajo ofensivos y el manejo de pruebas autenticadas y entrega de pruebas. (GitHub)

Si es usted un Empresa API-firstEspecialmente en el caso de las amenazas del BOLA, la autenticación rota y el abuso de la lógica empresarial, fíjate bien en las plataformas especializadas en API, como Escape, y en cualquier sistema que pueda demostrar que entiende los flujos multirol y la autorización a nivel de objeto. OWASP API 2023 debería ser su lente aquí, no las afirmaciones genéricas de "AI pentest". (Escapar)

Si usted es un seguridad de plataformas o equipo de seguridad empresarial Preocupados por la forma en que el compromiso de la web se convierte en un mayor impacto en el negocio, las plataformas orientadas a las rutas de ataque, como NodeZero, merecen más atención que las herramientas exclusivamente para aplicaciones. Los materiales públicos dejan claro que NodeZero intenta responder a una pregunta más amplia: no sólo "¿hay un fallo?", sino "¿hasta dónde puede llegar un atacante real desde este punto de apoyo?" (Horizon3.ai)

Si usted es un empresa regulada que necesita colaboración, RBAC, SSO, informes listos para auditoría, despliegue privado e integración limpia en flujos de trabajo de ingeniería, Penligent y Shannon Pro son más relevantes que Shannon Lite. La diferencia pública es que Shannon Pro crece desde un núcleo de validación de exploits de caja blanca hacia una correlación AppSec más amplia, mientras que Penligent se inclina públicamente hacia la orquestación del lenguaje natural, los flujos de trabajo en equipo y un comportamiento más amplio del banco de trabajo ofensivo. Su elección debe seguir su modelo operativo, no su fascinación por una captura de pantalla de referencia. (GitHub)

Si usted es un líder de seguridad que sigue queriendo nombrar el juicio humano en el centroCobalt sigue siendo una opción más limpia que el campo totalmente autónomo. Eso no es anti-AI. Es una respuesta diferente al mismo problema de escala. La IA puede encargarse de las partes repetitivas y dejar que los humanos dediquen su tiempo a lo que más importa, su creatividad. (Cobalto)

Para saber más

- Shannon, repositorio GitHub de KeygraphHQ

- PentestGPT, el artículo original en arXiv

- OWASP Top 10 2025

- OWASP API Security Top 10 2023

- Aviso de Next.js para CVE-2025-29927

- PSIRT de Fortinet para CVE-2025-25257

- Aviso de lichi para CVE-2025-53018

- Catálogo de vulnerabilidades explotadas conocidas de CISA

- AI Pentest Tool, cómo será el ataque automatizado real en 2026

- Pentest GPT, qué es, qué hace bien y dónde sigue fallando el Pentesting de IA

- La Guía Definitiva 2026 para Pruebas de Penetración con IA, La Era del Red Teaming Agentic

- Penligent.ai, orquestación en lenguaje natural para pruebas de penetración automatizadas con IA

- Shannon AI Pentesting Tool vs Penligent, lo que los ingenieros de seguridad deberían comparar realmente en 2026