Hacker AI GPT kulağa tek bir şeymiş gibi geliyor. Ama öyle değildir. Bu ifade PentestGPT gibi akademik sistemler, ticari AI pentest asistanları, yeraltı "sansürsüz" chatbot markaları ve dosyaları okuyabilen, araçları çağırabilen ve kod çalıştırabilen ajan kodlama ortamları için kullanılmaktadır. Tüm bunları tek bir kategori olarak ele almak, kötü tehdit modellerine, kötü satın alma kararlarına ve tembel teknik yazıma yol açar. (USENIX)

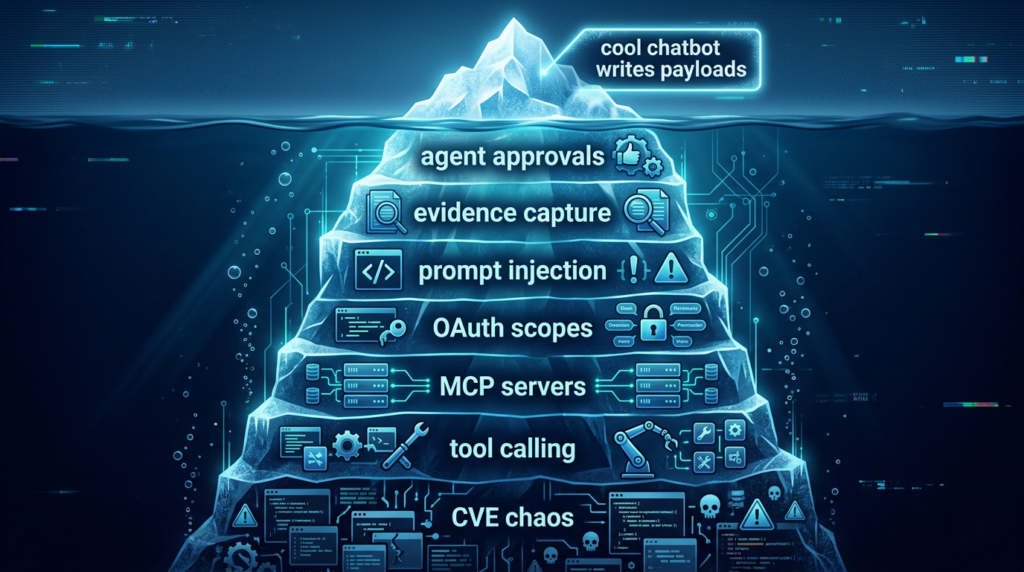

Yararlı soru artık GPT tarzı bir modelin saldırgan güvenlik çalışmalarına yardımcı olup olamayacağı değildir. Araştırmalar zaten evet diyor, en azından işin önemli kısımları için. Tehdit istihbaratı raporları, kötü niyetli aktörlerin keşif, kimlik avı, kötü amaçlı yazılımla ilgili görevler ve operasyonel destek için zaten yapay zekayı kullandığını söylüyor. Son CVE'ler, bu sistemler dosyalara, veritabanlarına, terminallere, IDE'lere, tarayıcı oturumlarına ve MCP sunucularına bağlandığında, ana güvenlik hikayesinin metin üretiminden yürütme sınırlarına, güven sınırlarına ve yan etkilere kaydığını göstermektedir. (USENIX)

Bu ayrım, bu konuyla ilgilenen neredeyse herkes için önemlidir. Güvenlik mühendisleri mantıklı değerlendirme kriterleri oluşturmak için buna ihtiyaç duyarlar. Kırmızı ekip çalışanları faydalı iş akışı hızlandırmasını tiyatrodan ayırmak için buna ihtiyaç duyar. Alıcılar, sohbet robotuna sarılmış bir tarayıcıya ödeme yapmaktan kaçınmak için buna ihtiyaç duyarlar. Savunucuların, istem enjeksiyonu, MCP kapsamı, araç onayları ve artifakt yakalamanın neden artık aynı konuşmaya ait olduğunu anlamak için buna ihtiyacı var. (OpenAI Geliştiricileri)

Doğru zihinsel model basittir: sözde hacker AI GPT, bir sohbet penceresindeki sihirli bir hacker değildir. O bir yığındır. Model sadece bir katmandır. Gerçek yetenekler ve gerçek tehlike, sistemin neleri görmesine izin verildiğinden, hangi araçları çağırabileceğinden, hangi ortamda çalışabileceğinden, hangi onaylara ihtiyaç duyduğundan ve olaydan sonra herhangi birinin gerçekte ne yaptığını yeniden oluşturup oluşturamayacağından gelir. (OpenAI Geliştiricileri)

Bu ifade dört farklı sisteme işaret etmektedir

Temizlemeye değer ilk şey kelime dağarcığıdır. Uygulamada, insanlar hacker AI GPT'yi en az dört farklı sisteme işaret etmek için kullanmaktadır. Birincisi, PentestGPT ve daha sonraki akademik kıyaslamalar tarafından en açık şekilde temsil edilen araştırma prototipidir. İkincisi, tarayıcı çıktısını özetleyebilen, sonraki adımları önerebilen veya test görevlerini düzenleyebilen bir ürün olan ticari pentest asistanıdır. Üçüncüsü, daha az korkuluk vaat eden WormGPT ve FraudGPT marka sınıfı olan suç amaçlı pazarlanan sohbet robotudur. Dördüncüsü, bir kodlama aracısı, IDE veya otomasyon çerçevesi içinde yaşayabilen ve dosyalara, kimlik bilgilerine, terminallere veya uzak hizmetlere dokunabildiği için tehlikeli bir kaldıraç elde edebilen ajan çalışma zamanıdır. (USENIX)

Bu kategoriler birbiriyle örtüşür, ancak birbirlerinin yerine kullanılamazlar. Bir araştırma sistemi kıyaslama tasarımı, tekrarlanabilirlik ve hata analizi ile değerlendirilir. Ticari bir asistan kanıt kalitesi, kapsam kontrolü ve gerçek iş akışlarıyla entegrasyona göre değerlendirilir. Bir suç markası, yeniden paketlenmiş jailbreak erişimine karşı ne kadarının gerçek olduğuna göre değerlendirilir. Bir ajan çalışma zamanı izinler, onaylar, telemetri ve patlama yarıçapı ile değerlendirilir. Birisi bunlardan hangisini kastettiğini belirtmeden "hacker AI GPT" dediğinde, genellikle dördünde de geçerli olmayan varsayımlarda bulunur. (USENIX)

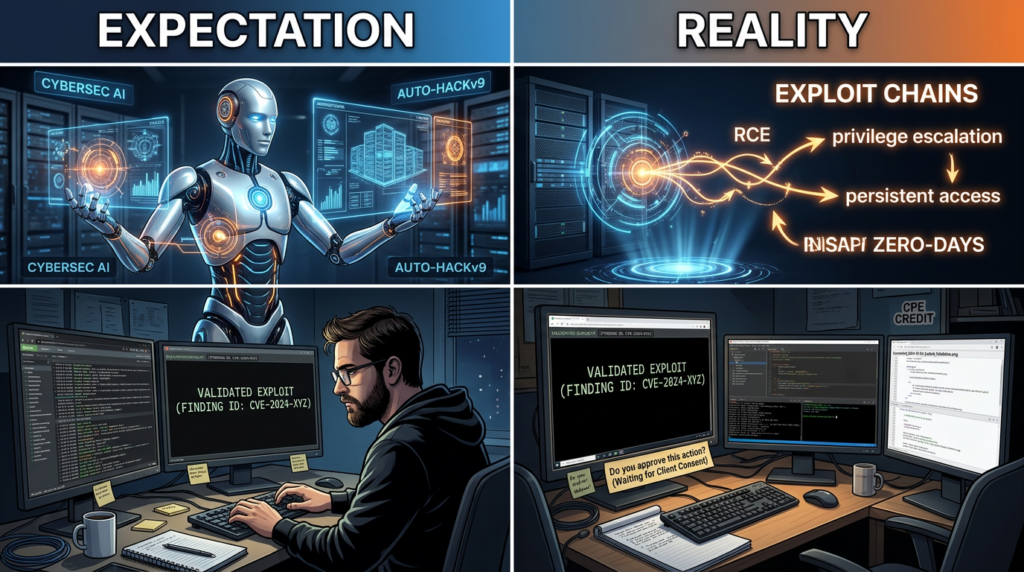

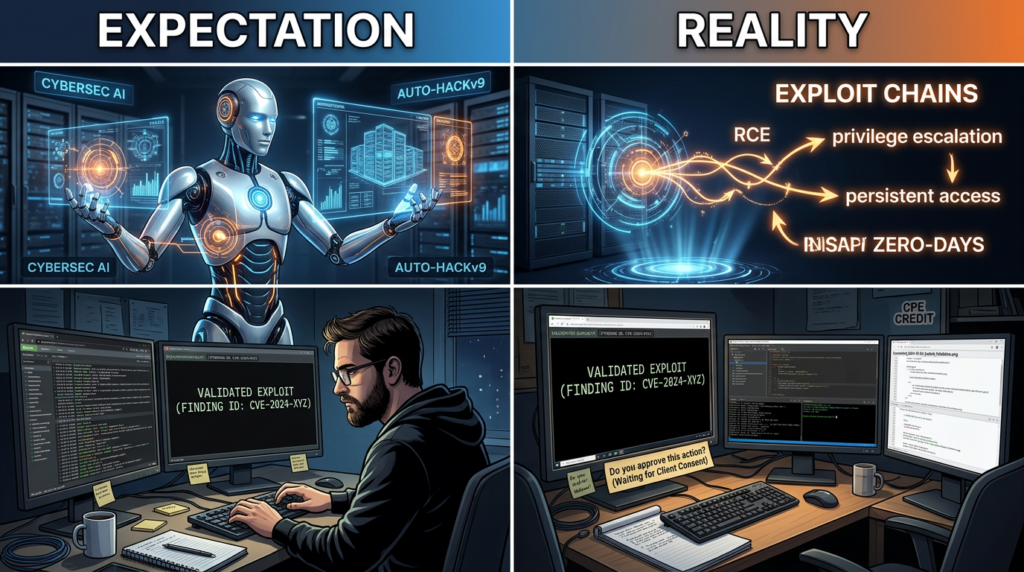

İfadenin en yanıltıcı versiyonu tek soruluk fantezidir. Bu fantezi, modelin kendisinin saldırgan olduğunu hayal eder. Gerçekte, model genellikle muhakeme ve düzenleme katmanıdır. Bağlamı yorumlar, araçları seçer, eylemler önerir ve sonuçları özetler. Zarar verme yeteneği, etrafındaki sistemden gelir: ulaşabileceği terminal, devralabileceği tarayıcı oturumu, okuyabileceği sırlar, çağırabileceği API'ler ve yazabileceği dosyalar. OpenAI'nin işlev çağırma belgeleri, araç çağırmayı modellerin web araması, kod yürütme ve MCP sunucuları dahil olmak üzere eğitim kümelerinin dışındaki işlevlere ve verilere erişmesinin bir yolu olarak tanımlayarak bu mimari değişimi açıkça ortaya koymaktadır. (OpenAI Geliştiricileri)

Bu nedenle etiketin kendisi sistem sınırından daha az kullanışlıdır. Bir ürün sayfasında "AI hacker" yazıyorsa, ciddi takip soruları operasyoneldir. Gerçek bir iş akışı boyunca doğrulanmış durumu koruyabilir mi? Hipotezleri doğrulanmış bulgulardan ayırabilir mi? Ham istek ve yanıt kanıtlarını gösterebilir mi? Güvenilmeyen bağlamın araç çağrılarını sessizce yönlendirmesini önleyebilir mi? Yıkıcı bir eylemin açık onay olmadan gerçekleşmediğini kanıtlayabilir mi? Bu sorular gerçek güvenliğe, özerklikle ilgili herhangi bir iddiadan çok daha yakındır. (OpenAI Geliştiricileri)

Araştırma aslında neyi gösteriyor

PentestGPT makalesi, sorunun disiplinli bir versiyonunu sorduğu için hala başlamak için en temiz yerdir. Yazarlar, OWASP Top 10 kategorilerini ve birden fazla CWE'yi kapsayan 13 hedef ve 182 alt görevi kapsayan gerçek dünya sızma testi hedeflerinden bir kıyaslama oluşturdular. Temel gözlemleri dil modellerinin işe yaramaz olduğu değildi. Daha spesifik ve daha ilginçti: modeller genellikle araçları kullanma, çıktıları yorumlama ve sonraki eylemleri önerme gibi yerel alt görevlerde yeterliydi, ancak zaman içinde genel test senaryosunun tüm bağlamını korumakta zorlandılar. (USENIX)

Çözümleri sihirli değil, mimariydi. PentestGPT, bağlam kaybını azaltmak ve iş akışını daha iyi yapılandırmak için kendi kendine etkileşime giren üç modül kullandı. Değerlendirmede, bu tasarım kıyaslama hedeflerinde GPT-3.5'e göre yüzde 228,6'lık bir görev tamamlama artışı sağladı ve makale ayrıca doğrudan GPT-4 kullanımına göre yüzde 58,6'lık bir alt görev tamamlama artışı bildirdi. Bu anlamlı bir sonuçtur, ancak tam olarak okunmalıdır. İskele kurmanın, ayrıştırmanın ve etki alanına duyarlı düzenlemenin çok önemli olduğunu göstermektedir. Mevcut sistemlerin keyfi gerçek hedefler üzerinde kararlı, uçtan uca otonom pentesterler gibi davrandığını kanıtlamaz. (USENIX)

Bu makale, zayıflıkları gizlemediği için özellikle değerlidir. Günümüzde de acı bir şekilde aşina olunan hata modellerini belgelemektedir: yanlış komut oluşturma, kilitlenme işlemleri, yanlış tarama-çıktı yorumlama, yanlış kaynak kodu yorumlama ve doğru zamanda doğru yerde geçerli açıklar oluşturamama. Kolay ve orta hedeflerde, genel modeller gerçek bir kabiliyet gösterirken; zor hedeflerde performans keskin bir şekilde düşmüştür. Bu, yardımcı bir saldırı-güvenlik yardımcı pilotu ile güvenilir bir otonom operatör arasındaki farktır. (USENIX)

Daha sonraki kıyaslamalar da aynı noktayı keskinleştirmiştir. Cybench profesyonel düzeyde 40 CTF görevi sunmuş ve en iyi modellerin insan ekiplerinin dakikalar içinde çözdüğü bazı görevleri eksiksiz olarak çözebildiğini göstermiştir, ancak birçok görev mevcut ajan kapasitesinin ötesinde kaldığı için kıyaslama tam olarak alt görevler sunmak zorunda kalmıştır. Bu makale, bir ajanı, komutları uygulayabildiği ve çıktıları gözlemleyebildiği etkileşimli bir ortamda ölçtüğü için kullanışlıdır; bu, gerçek saldırı iş akışına statik QA kıyaslamalarından çok daha yakındır. (OpenReview)

3CB çalışması daha doğrudan saldırı kabiliyeti üzerinde durmuştur. Çalışmanın özetinde GPT-4o ve Claude 3.5 Sonnet gibi öncü modellerin birden fazla alanda keşif ve istismar gibi saldırı görevlerini yerine getirebildiği, daha küçük açık kaynaklı modellerin ise çok daha sınırlı kaldığı belirtilmektedir. Bu önemli, çünkü öncü modelleri zararsız oyuncaklar olarak görmenin artık entelektüel açıdan ciddi olmadığı anlamına geliyor. Ancak 3CB'nin var olma sebebi, sahanın anekdotlara ve demolara dayanmak yerine gerçek dünyadaki saldırı kabiliyetini anlamak için titiz bir değerlendirmeye ihtiyaç duymasıdır. (arXiv)

CAIBench belki de aşırı güvene karşı en faydalı düzelticidir. Önceden eğitilmiş LLM'lerdeki siber güvenlik bilgisinin otomatik olarak saldırı ve savunma yeteneğine dönüşmediğini açıkça savunmaktadır. Değerlendirmesinde, son teknoloji ürünü modeller güvenlik bilgisi ölçütlerinde yaklaşık yüzde 70 başarı ile doygunluğa yaklaşmış, ancak çok adımlı düşmanca senaryolarda yüzde 20 ila 40 aralığında önemli ölçüde gerilemiş ve robotik hedeflerde yine daha kötü performans göstermiştir. Kavramsal bilgi ile uyarlanabilir kapasite arasındaki bu boşluk, tüm bu alandaki en önemli gerçeklerden biridir. (arXiv)

CyberExplorer aynı olgunluk noktasını farklı bir şekilde ortaya koymaktadır. Yazarlar, kıyaslamanın kasıtlı olarak savunmasız, izole ortamlarda, canlı hedefler olmadan, sıfır gün olmadan ve harici ağlar olmadan yapıldığını ve amacın ajan davranışını, verimlilik ödünleşimlerini ve başarısızlık modlarını anlamak olduğunu vurgulamaktadır. Bu çerçeve sadece bir güvenlik feragatnamesi değildir. Bilimin durumunu da yansıtmaktadır. Alan, kontrolsüz gerçek dünya otonomisine hazır olduklarını iddia etmeden önce bu sistemlerin kontrollü ortamlarda nasıl mantık yürüttüklerini ve başarısız olduklarını ölçmek için hala çok çalışıyor. (arXiv)

Bir araya getirildiğinde, araştırma kararı açıktır. Hacker AI GPT sahte değildir. Arama alanını daraltmak, gürültülü çıktıları okumak, sonraki adımları hazırlamak, araç sonuçlarını açıklamak ve operatörlerin daha hızlı hareket etmesine yardımcı olmak için zaten yararlıdır. Aynı zamanda literatür, durum yönetimi, stratejik adaptasyon, uzun ufuklu muhakeme ve aday ve doğrulanmış bulgular arasında temiz bir ayrım yapmanın zor olduğunu tekrar tekrar göstermektedir. Bu nedenle ciddi ekipler, modelin kendisi sızma testini çözmüş gibi davranmak yerine iş akışı kontrolleri etrafında tasarım yaparlar. (USENIX)

Canlı tehdit resmi

Tehdit ortamı çoktan spekülasyonun ötesine geçmiştir. OpenAI'nin Haziran 2025 tehdit raporu, dolandırıcılık, spam, gizli etki operasyonları ve diğer zararların yanı sıra önlemek için çalıştığı kötüye kullanım kategorileri arasında kötü niyetli siber faaliyetleri açıkça listeliyor. Bu, bir marka ifadesinden ziyade, siber suiistimalin artık kamusal konuşlandırmada varsayımsal olmadığının temel bir kabulü olarak önemlidir. (OpenAI)

Google Tehdit İstihbarat Grubu Şubat 2026 raporunda daha da ileri gitti. GTIG, tehdit aktörlerinin bilgi toplamak, son derece gerçekçi kimlik avı içeriği oluşturmak ve kötü amaçlı yazılım geliştirmek için yapay zekayı kullandığını gözlemlediğini söyledi. Aynı güncellemede Google, APT aktörleri tarafından sınır modellerine doğrudan saldırılar gözlemlemediğini, ancak özel sektör kuruluşlarından sık sık model çıkarma saldırıları gördüğünü ve hafiflettiğini söyledi. Bu önemli bir ayrımdır. Saldırgan ekonomisi sadece başkalarına saldırmak için modelleri kullanmakla ilgili değildir; aynı zamanda YZ sistemlerinin kendilerine saldırmakla da ilgilidir. (blog.google)

Anthropic'in Ağustos 2025 tehdit istihbarat raporu operasyonel açıdan daha da spesifiktir. Claude Code kullanan bir siber suçlunun, potansiyel olarak en az 17 farklı kuruluşu etkileyen ölçekli bir veri gaspı operasyonunu tanımlamaktadır. Raporda Claude Code'un keşif, kimlik bilgisi toplama, ağa sızma desteği, ayrıcalık yükseltme rehberliği, yanal hareket desteği, veri çıkarma ve Chisel'in gizlenmiş sürümleri ve yeni TCP proxy kodu dahil olmak üzere kötü amaçlı yazılımdan kaçınma çalışmaları için kullanıldığı belirtiliyor. Bu teorik bir "olabilirlik" değil. Bu, canlı bir izinsiz giriş iş akışının ortasında bir yapay zeka kodlama ajanının kullanıldığı belgelenmiş bir durumdur. (Antropik)

Bu raporun bu kadar önemli olmasının bir nedeni, konuşmayı "danışman olarak YZ "den "daha büyük bir saldırı döngüsü içinde aktif operatör olarak YZ "ye değiştirmesidir. Anthropic bu modeli, saldırganın bağlamı ve talimatları şekillendirdiği ve böylece ajanın ısrarla meşru bir operatör gibi davrandığı "vibe hacking" olarak tanımladı. Bu etiket standart hale gelsin ya da gelmesin, operasyonel nokta değişmez: bir ajan bağlamı koruyabildiğinde, araçlara erişebildiğinde ve bir saldırgan hedefine doğru yinelemeye devam edebildiğinde, ağırlık merkezi tek bir istemin kötüye kullanılmasından iş akışı manipülasyonuna kayar. (Antropik)

Trend Micro'nun Ocak 2026 değerlendirmesi önemli bir düzeltme daha ekliyor. Kriminal yapay zekanın deneysellikten sanayileşmeye doğru ilerlediğini savunuyor, ancak aynı zamanda yeraltı "kriminal LLM" pazarının gerçekten yeni bağımsız sınır modellerinden ziyade hizmet olarak jailbreak ve ticari platformların parazit olarak kötüye kullanılması etrafında birleştiğini söylüyor. Bu da her gösterişli yeraltı isminin etrafındaki mitolojinin delinmesine yardımcı oluyor. Markalaşmanın bir kısmı gerçektir, ancak ekosistemin anlamlı bir kısmı, temelde yeni bir model sınıfı icat etmekten ziyade erişimi paketlemek, sürtünmeyi ortadan kaldırmak ve kötüye kullanımı operasyonel hale getirmekle ilgilidir. (www.trendmicro.com)

Bu nedenle WormGPT ve FraudGPT önemlidir, ancak her zaman pazarlamacıların öne sürdüğü nedenle değil. Önemleri sihirli bir şekilde yeni bir süper zeka türü yaratmış olmaları değildir. Önemleri, daha az korkuluk, daha fazla operasyonel kolaylık ve siber suçlara özgü çerçeveleme için bir pazar talebi göstermeleridir. Daha sonraki tehdit raporları, perdenin arkasındaki "model" genellikle satış kopyasının ima ettiğinden daha az egzotik olsa bile, operasyonel ekosistemin olgunlaşmaya devam ettiğini göstermektedir. (www.trendmicro.com)

Daha geniş kapsamlı ders rahatsız edici ama basittir. Gerçek dünyanın kötüye kullanımı kusursuz bir otonom hacker gerektirmez. Sadece emeği sıkıştırmak, makul bir metin oluşturmak, yerel sorun çözmeyi desteklemek ve bir saldırganın bir operasyonun bir aşamasından diğerine geçmesi için gereken süreyi azaltmak için yeterli yetkinlik gerektirir. Bunu araç erişimi ve kalıcılıkla birleştirdiğinizde, kusurlu sistemler bile bir saldırgan için operasyonel olarak değerli olabilir. (blog.google)

Etiketin arkasındaki sistem

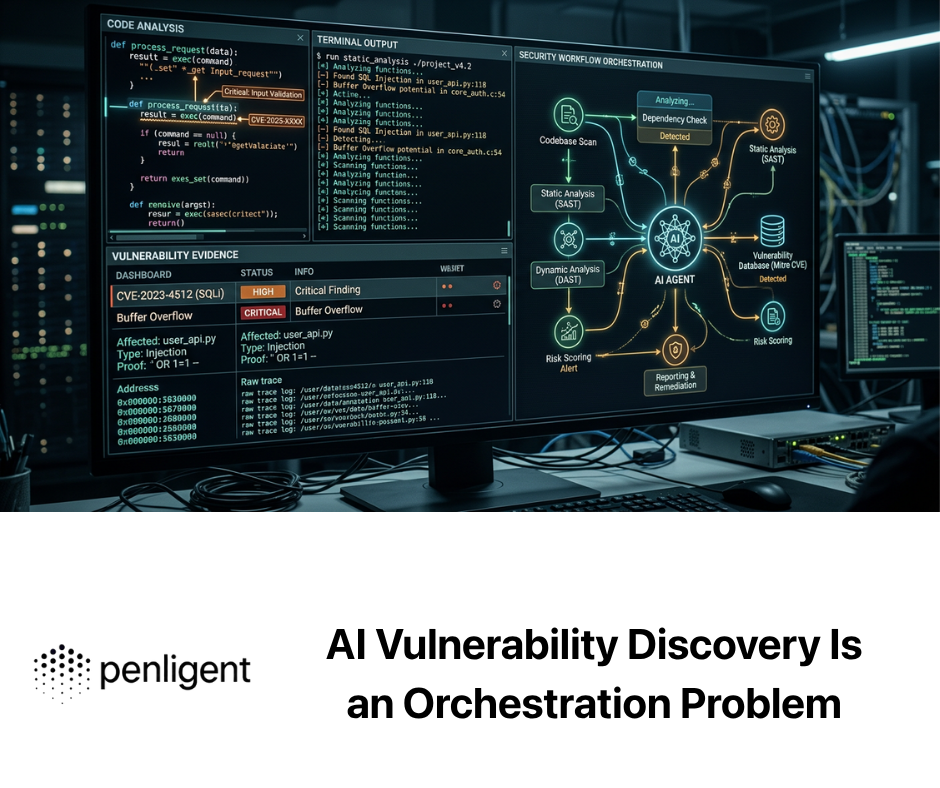

Hacker AI GPT'yi doğru bir şekilde anlamak için yığını katmanlara ayırmak yardımcı olur. Model katmanı dil anlama, muhakeme ve karar desteğini ele alır. Araç katmanı, kabuk yürütme, web istekleri, tarayıcı kullanımı, veritabanı sorguları, e-posta erişimi veya SaaS entegrasyonları gibi eylemleri ortaya çıkarır. Yürütme katmanı, bu eylemlerin bir terminalde, bir konteynerde, bir bulut çalışanında veya yerel bir IDE'de gerçekte gerçekleştiği yerdir. Kontrol katmanı politika, onaylar, şemalar, izin listeleri, kapsamlar ve telemetri ekler. Kanıt katmanı, ne olduğunu ve iddia edilen bir bulgunun gerçekten tekrarlanabilir olup olmadığını depolar. (OpenAI Geliştiricileri)

OpenAI'nin işlev çağırma kılavuzu, araç katmanının ne kadar kaldıraç etkisi yarattığını açıklıyor. Belgeler, işlev çağırmayı modellere yeni işlevlere ve harici verilere erişim sağlamanın bir yolu olarak tanımlıyor ve aynı kılavuz, yerleşik araçların web'de arama yapabileceğini, kod çalıştırabileceğini ve MCP sunucularına erişebileceğini belirtiyor. Bu, konuşan bir asistan ile hareket eden bir sistem arasındaki farktır. Bu aynı zamanda güvenlik konusunun çok daha somut hale gelmesi gereken bir noktadır. (OpenAI Geliştiricileri)

MCP spesifikasyonu da aynı derecede açık sözlüdür. Güven ve güvenlik bölümü, protokolün keyfi veri erişimi ve kod yürütme yolları aracılığıyla güçlü yetenekler sağladığını ve keyfi kod yürütmeyi temsil ettikleri için araçların uygun bir dikkatle ele alınması gerektiğini söylüyor. Ayrıca, ana bilgisayarların araçları çağırmadan önce açık kullanıcı onayı alması gerektiğini söylüyor. Bunlar yan notlar değildir. Bunlar, yürütme sınırının ana güvenlik sınırı olduğunu protokolün kendi kabulüdür. (Model Bağlam Protokolü)

Yetkilendirme tarafı da bir o kadar önemlidir. MCP'nin yetkilendirme spesifikasyonu OAuth tabanlı keşif gerektirir ve MCP sunucularının korumalı kaynak meta verilerini uygulaması gerektiğini, istemcilerin ise yetkilendirme sunucularını keşfetmek için bunları kullanması gerektiğini söyler. Ayrıca, sunucuları uygun kapsamların reklamını yapmaya teşvik ederek kapsam işlemeyi en az ayrıcalık etrafında açıkça çerçevelendirir. WWW-Kimlik Doğrulama Zorluklar. Bir ürün "MCP desteği" olduğunu iddia ediyor ancak keşif, token depolama, kapsam minimizasyonu ve sunucu güvenini açıklayamıyorsa, güvenli MCP dağıtımının amacını kaçırıyor demektir. (Model Bağlam Protokolü)

OpenAI'nin ajan güvenliği kılavuzu da uygulama açısından aynı yere çıkıyor. Aracıların, araç çağrılarını etkileyen güvenilmeyen metinleri işlediklerinde özellikle savunmasız oldukları konusunda uyarmakta ve yapılandırılmış çıktılar, araç onayları, korkuluklar ve güvenilmeyen değişkenlerin dikkatli bir şekilde ele alınmasını önermektedir. Ayrıca, modelin bir MCP'ye kullanıcının amaçladığından daha fazla veri göndermesi durumunda, açık bir saldırgan olmasa bile özel veri sızıntısının meydana gelebileceğini belirtmektedir. Bu, gerçek risk modelinin mevcut en net ifadelerinden biridir. Bir ajan sadece saldırıya uğrayarak değil, aynı zamanda bağlı araçlar aracılığıyla verileri aşırı paylaşarak, aşırı hareket ederek veya yanlış yönlendirerek de başarısız olabilir. (OpenAI Geliştiricileri)

Bu noktada hacker AI GPT ifadesi mistik olmaktan çıkar ve sıradan bir güvenlik mühendisliği haline gelir. Sorular tanıdık gelmeye başlar. Sistemin yetenekleri nelerdir? Hangi kimlikler altında hareket ediyor. Hangi verilere güveniliyor. Hangi veriler güvenilmezdir. Hangi eylemler onay gerektirir. Hangi günlükler var. Nelerin tekrar oynatılabileceği. Nelerin geri alınabileceği. Hangi belirteçler uzun ömürlüdür. Hangi araçların yazmasına izin verilir. Hangi entegrasyonlar üretime ulaşabilir. Ürün ne kadar "AI-native" olursa, bu sorular o kadar sıkıcı hale gelir. Bu iyiye işaret, kötüye değil. (Model Bağlam Protokolü)

Hızlı enjeksiyon artık sadece bir model sorunu değil

NIST'in Üretken Yapay Zeka Profili, doğrudan ve dolaylı istem enjeksiyonu arasında önemli bir ayrım yapmaktadır. Doğrudan istem enjeksiyonu, bir saldırgan doğrudan sisteme kötü niyetli girdi sağladığında gerçekleşir. Dolaylı komut enjeksiyonu ise saldırganın kötü niyetli talimatları bir belge, web sayfası ya da dosya gibi sistemin daha sonra alacağı verilere yerleştirmesiyle gerçekleşir. Bu ikinci kategori etmen sistemleri için en önemli olanıdır, çünkü etmenler bir kullanıcı adına hareket etmek için dış bağlamı almak üzere inşa edilmiştir. (NIST Yayınları)

OWASP'ın LLM uygulamalarına yönelik kılavuzu aynı soruna başka bir açıdan yaklaşmaktadır. Mevcut LLM Top 10'da, istem enjeksiyonu, güvensiz çıktı işleme, güvensiz eklenti tasarımı, aşırı temsilcilik ve tedarik zinciri güvenlik açıklarının tümü risk modelinin en üstünde yer almaktadır. Bu liste tam da dikkatleri chatbot'un beceriksizliğinden sistem zararlarına kaydırdığı için faydalıdır: aşağı akış kod yürütme, açığa çıkan veriler, kötü tasarlanmış entegrasyonlar ve yeterli kısıtlama olmaksızın verilen çok fazla özerklik. (OWASP)

NIST'in ajan ele geçirme çalışması riski somutlaştırmaktadır. Ocak 2025 tarihli teknik blogunda NIST, ajan ele geçirmeyi, bir ajanın meşru bir kullanıcı görevini tamamlamaya çalışırken aldığı verilere kötü niyetli talimatların yerleştirildiği bir dolaylı istem enjeksiyonu biçimi olarak tanımlamaktadır. NIST'in deneyleri, değerlendirme çerçevesine uzaktan kod yürütme, veritabanına sızma ve otomatik kimlik avı gibi yüksek etkili senaryolar eklemiş ve aracıların genellikle kötü niyetli talimatları izlemeye teşvik edildiğini tespit etmiştir. Bu doğru değerlendirme zihniyetidir çünkü model bir göreve, bir araca ve bir yan etkiye dokunduktan sonra ne olduğunu ölçer. (NIST)

NIST blogundaki en değerli bulgu tanım değildir. Uyarlanabilir test dersidir. Ajans, yeni bir modeli bu model için özel olarak oluşturulmuş saldırılarla yeniden eşleştirdiğinde, saldırı başarı oranı en güçlü temel saldırı için yüzde 11'den en güçlü yeni saldırı için yüzde 81'e sıçradı. Bu, her "AI hacker" sistemi kurucusunun hatırlaması gereken bir rakamdır. Dünün saldırı setine karşı yapılan statik değerlendirmeler güvenliğin kanıtı değildir. Saldırganlar uyum sağlar ve gerçekçi bir değerlendirme çerçevesi de uyum sağlamak zorundadır. (NIST)

OpenAI'nin güvenlik kılavuzu bunu sistem tasarımına dönüştürmektedir. Güvenilmeyen değişkenleri asla doğrudan geliştirici mesajlarına koymamanızı, düğümler arası veri akışını kısıtlamak için yapılandırılmış çıktılar kullanmanızı, araç onaylarını açık tutmanızı ve bir ajanın nasıl davrandığını incelemek için değerlendirmeler ve izleme derecelendirmesi kullanmanızı önerir. Mesele, bu önlemlerin sorunu ortadan kaldırması değildir. Aynı sayfada, aracıların hala hata yapabileceği ya da kandırılabileceği açıkça belirtilmektedir. Mesele şu ki, iş akışını güvenilmeyen bağlam eninde sonunda ayrıcalıklı bir eylemi yönlendirmeye çalışacakmış gibi tasarlarsanız saldırı yüzeyini azaltabilirsiniz. (OpenAI Geliştiricileri)

Jailbreak'lerle ilgili güncel tartışmaların daha önemli olan mühendislik meselesini gözden kaçırmasının nedeni de budur. Jailbreak'ler önemlidir. Ancak bir sohbet penceresindeki bir jailbreak, ayrıcalıklı bir ajanın bir yapılandırma dosyası yazmasına, yanlış veritabanını sorgulamasına, kimlik bilgilerine sahip bir isteği iletmesine veya bağlı bir araç aracılığıyla bir belgeyi dışarı sızdırmasına neden olan dolaylı bir istem enjeksiyonundan genellikle daha az tehlikelidir. Güvenlik sorusu yalnızca modelin söylememesi gereken bir şeyi söyleyip söylemediği değildir. Sistemin yapmaması gereken bir şeyi yapıp yapmadığıdır. (OWASP Gen AI Güvenlik Projesi)

Pratik bir kontrol modeli doğrudan bu içgörüden kaynaklanır. Her harici belgeyi, e-postayı, sorun yorumunu, README'yi ve alınan web sayfasını güvenilmez olarak değerlendirin. Yalnızca gerçekten ihtiyacınız olan yapılandırılmış alanları ayıklayın. Serbest biçimli harici metnin doğrudan ayrıcalıklı araç çağırma bağlamlarına geçmesine izin vermeyin. Okuma işlemlerini ucuz, yazma işlemlerini pahalı ve durum değiştirme işlemlerini insan onaylı hale getirin. İzleri koruyun, böylece kötü bir sonucun bir model hatasından mı, zehirli bir bağlamdan mı, kötü bir araç tanımından mı yoksa aşırı geniş bir izin hakkından mı kaynaklandığını daha sonra anlayabilirsiniz. (OpenAI Geliştiricileri)

Önemli olan CVE'ler

Hacker AI GPT'yi bir pazarlama cümlesinden ziyade bir güvenlik sorunu olarak anlamak istiyorsanız, CVE akışı çoğu ürün sayfasından daha dürüsttür. Gerçek kırılganlığın nerede yaşadığını gösterir: güvenlik için yöneticiLLM'den sorguya köprüler, açık kod doğrulama yollarına sahip ajan iş akışı platformları, tehlikeli yapılandırma dosyalarına güvenen IDE'ler ve güven sınırlarını daraltan MCP bağlantılı yürütme yolları.

LangChain'deki CVE-2023-29374 en net erken örneklerden biridir. GitHub'ın gözden geçirilmiş danışmanlığı, LangChain'de 0.0.131, LLMMathChain Python aracılığıyla rastgele kod çalıştırabilen istem ekleme saldırılarına izin verdi yöneticive yamalı bir sürüm listelemiyor. Bu, birçok "hacker AI" sisteminin orijinal günahını yakaladığı için önemlidir: model çıktısını almak ve yeterli izolasyon olmadan bir değerlendiriciye veya yürütücüye beslemek. Buradan çıkarılacak ders sadece "yapabiliyorsanız yama yapın" değil, aynı zamanda "model kontrollü metni kum havuzu olmadan güçlü yorumlayıcılara yönlendiren tasarımları kaldırın veya değiştirin" olmalıdır. (GitHub)

CVE-2024-8309 aynı güven sınırı sorununu daha aşağıda da göstermektedir. NVD, LangChain'deki bir güvenlik açığının GraphCypherQAChain istem enjeksiyonu yoluyla SQL enjeksiyonuna izin verdi ve yetkisiz veri manipülasyonu, veri sızıntısı, tüm verileri silerek hizmet reddi ve çok kiracılı sınır ihlalleri gibi potansiyel sonuçlar doğurdu. GitHub'ın danışmanlığı yamalı sürümleri şu şekilde listeliyor langchain 0.2.0 ve langchain-community 0.2.19. Bu, hacker AI GPT ile ilgilidir çünkü tehlikeli atlamanın genellikle "modelden kabuğa" değil, "doğal dil sisteminden hassas veri düzlemine" olduğunu göstermektedir. Zincir serbest biçimli dili veritabanı işlemlerine dönüştürürse, enjeksiyon riski yapısal hale gelir. (GitHub)

Langflow'daki CVE-2025-3248 farklı bir nedenden dolayı önemlidir. NVD, 1.3.0'dan önceki sürümlerin kod enjeksiyonuna duyarlı olduğunu söylüyor /api/v1/validate/code uç noktası, uzaktan ve kimliği doğrulanmamış keyfi kod yürütülmesine izin verir. Burada sorun akıllıca bir komut istemi değildir. Sorun, aracı-iş akışı platformunun kendisinin ağ üzerinden tehlikeli kod doğrulama işlevselliğini açığa çıkarmasıdır. Savunucular için bu, "AI otomasyonu" etrafındaki tehdit modelinin yalnızca model hizalamasını değil, sıradan web uygulamasına maruz kalma, kimlik, yama temposu ve yönetim düzlemi sertleştirmesini de içermesi gerektiği anlamına gelir. (NVD)

Yine Langflow'da bulunan CVE-2026-33017 de aynı noktayı pekiştirmekte ve daha da keskinleştirmektedir. NVD, kimliği doğrulanmamış build_public_tmp uç noktası, rastgele çalıştırılabilir kod içeren saldırgan tarafından sağlanan akış verilerini kabul etti ve bu veriler daha sonra yönetici sandboxing olmadan, kimliği doğrulanmamış uzaktan kod yürütülmesine neden olur. NVD, sorunun 1.9.0 sürümünde düzeltildiğini söylüyor. Bu, hacker AI GPT tartışmasıyla doğrudan ilgilidir çünkü yürütme semantikleri yeterince sıkı bir şekilde çitle çevrilmediğinde "genel akış" kolaylığının nasıl uzak bir yürütme yüzeyine dönüşebileceğini göstermektedir. (NVD)

Cursor'daki CVE-2025-54135, konuşmayı ajan IDE'lere ve MCP'ye duyarlı dosyalara taşıyor. NVD, 1.3.9'un altındaki sürümlerin, hassas bir dosya oluşturmak için dolaylı istem enjeksiyonu ile zincirlenebilecek bir şekilde kullanıcı onayı olmadan çalışma alanı içi dosya yazmaya izin verdiğini söylüyor .cursor/mcp.json dosyasına erişebilir ve onay olmadan uzaktan kod çalıştırmayı tetikleyebilir. Bu, ajan kodlama ortamlarının neden saldırgan yapay zeka ile aynı güvenlik tartışmasına ait olduğunun en temiz örneklerinden biridir. Tehlike bağlam kaçırma, yerel dosya yazma ve güvenilir yapılandırma yükleme kombinasyonundan kaynaklanmaktadır. (NVD)

Yine Cursor'da bulunan CVE-2025-61591, aynı ekosistemin OAuth ve güven keşfi tarafını göstermektedir. NVD, MCP'nin güvenilmeyen bir MCP sunucusuyla OAuth kimlik doğrulaması kullandığında 1.7 ve altındaki sürümlerin savunmasız olduğunu ve kötü niyetli bir sunucunun etkileşim süreci sırasında hazırlanmış komutları döndürmesine ve potansiyel olarak aracı tarafından komut enjeksiyonu veya ana bilgisayar tarafı uzaktan kod yürütme elde etmesine izin verdiğini söylüyor. İşte tam da bu nedenle güvenli MCP desteği sadece "protokolle çalışır" meselesi değildir. Sunucu güveni, OAuth akış bütünlüğü ve kapsam disiplini yürütme sınırının bir parçasıdır. (NVD)

Burada bir nüans önemlidir. Yapay zeka ile ilgili her CVE eşit derecede yerleşmiş değildir. NVD'nin CVE-2025-46059 için girişi LangChain'in GmailToolkit hazırlanmış bir e-posta mesajı aracılığıyla keyfi kod yürütülmesine izin veren dolaylı bir istem enjeksiyonu sorunu içeriyordu, ancak tedarikçi kod yürütme yolunun LangChain güvenlik uygulamalarına uymayan kullanıcı tarafından yazılmış koddan geldiğini savunduğu için sorunu tartışmalı olarak işaretledi. Bu tam da ciddi okuyucuların ortaya çıkmasını isteyeceği türden bir anlaşmazlıktır. İhtilaflı bir CVE yine de operasyonel olarak ilgili olabilir, ancak kamuya açık kayıtların desteklediğinden daha kesin bir şekilde tanımlanmamalıdır. (NVD)

Birlikte okunduğunda, bu CVE'ler tutarlı bir hikaye anlatmaktadır. Hacker AI GPT ile ilgili anlamlı riskler, genel bir modelin aniden soyut bir süper saldırgan haline gelmesinden kaynaklanmamaktadır. Belirli yürütme köprülerinden kaynaklanırlar: istemi yöneticisorguya, güvenilmeyen içerik yapılandırma dosyasına, OAuth kötü niyetli MCP sunucusuna, genel iş akışı uç noktası kod yoluna ve otomasyon platformu yönetim düzlemi maruziyetine. Savunmacıların ilk bakması gereken yer orasıdır. (GitHub)

Hacker ai gpt olarak satılan bir ürün nasıl değerlendirilir?

İfadeye sihir gibi davranmayı bıraktığınızda, ürün değerlendirmesi kolaylaşır. Sorulması gereken ilk şey, sistemin gerçek bir etkileşim boyunca durumunu koruyup koruyamayacağıdır. Pentest çalışması izole edilmiş komut önerileri koleksiyonu değildir. Kimliği doğrulanmış adımlar, dallanan hipotezler, başarısız denemeler, eserler ve yeniden testlerden oluşan bir zincirdir. PentestGPT makalesi, sorunu klasik keşif, tarama, güvenlik açığı değerlendirmesi, istismar ve istismar sonrası raporlama aşamaları üzerinden çerçevelemiştir. Sadece bir aşamada iyi performans gösteren herhangi bir ürün tüm sorunu çözmüyor demektir. (Penligent)

İkinci soru, sistemin anlatıyı kanıttan ayırıp ayırmadığıdır. Bir model her zaman makul bir bulgu yazabilir. Daha zor olan sorun ise ham artefaktları, negatif kontrolleri, yeniden üretim adımlarını ve yeniden test rehberliğini koruyup korumadığıdır. Bunlar olmadan, alıcılar güven tiyatrosu için ödeme yaparlar. Yapay zeka pentestingi üzerine kamuoyunda yazılan daha iyi yazıların, zekice yönlendirmelere değil "doğrulanmış bulgulara" dönmeye devam etmesinin bir nedeni de budur. Sistem gözlemden kanıta geçmek zorundadır. (Penligent)

Üçüncü soru, tedarikçinin yürütme sınırı hakkında bir savunmacının düşündüğü gibi düşünüp düşünmediğidir. Araç çağrılarının günlüğe kaydedilip kaydedilmediğini sorun. Okuma ve yazmaların ayrı ayrı onaylanıp onaylanmadığını sorun. Dış bağlamın ayrıcalıklı araçlara ulaşmadan önce izole edilip edilmediğini sorun. MCP sunucularının güvenli bir şekilde bulunup bulunmadığını ve kimlik doğrulamasının yapılıp yapılmadığını sorun. Sistemin belirli bir eylemde hangi model sürümünün, istem şablonunun, araç sürümünün ve ilke kapısının yer aldığını kanıtlayıp kanıtlayamadığını sorun. Bunlar lüks detaylar değildir. Kullanılabilir bir güvenlik sistemi ile perili bir ev arasındaki farktır. (OpenAI Geliştiricileri)

Dördüncü soru ise ürünün hata modlarını dürüstçe kabul edip etmediğidir. Araştırma kıyaslamaları, bilginin uyarlanabilir saldırı kabiliyeti ile aynı şey olmadığını zaten göstermektedir ve NIST'in çalışması, bir sisteme uyarlanmış yeni saldırıların saldırı başarısını radikal bir şekilde artırabileceğini zaten göstermektedir. Eğer bir tedarikçi sadece otonomiden bahsediyor ve istem enjeksiyonu, ajan kaçırma, kapsam kontrolü, insan incelemesi veya eser yakalama hakkında hiç konuşmuyorsa, bir iş akışından çok bir demonun reklamını yapıyor demektir. (arXiv)

Bu, kamuya açık ürün iddialarının yorumlanmasının çok daha kolay hale geldiği noktadır. Penligent'in ana sayfasında 200'den fazla endüstri aracı, kanıt öncelikli sonuçlar, kapsam kontrolü ve sinyalden kanıta iş akışı için destek vurgulanıyor. Bir alıcı bu ürünü seçse de seçmese de, bunlar tam olarak sorgulanmaya değer türden iddialardır çünkü gerçek operasyonel gerekliliklerle eşleşirler: araç kapsamı, onay sınırları, tekrarlanabilirlik ve insan kontrolü. Bunlar, otonom korsanlıkla ilgili belirsiz vaatlerden çok daha anlamlıdır. (Penligent)

HackingLabs'ın yakın tarihli kamuya açık materyali de aynı ayrımı faydalı bir şekilde yapmaktadır. AI Pentest Tool makalesi, temel değerin ham sinyal ile savunulabilir kanıt arasındaki zor orta nokta olduğunu savunuyor ve Pentest GPT makalesi, komutları yazan bir modeli araçları, durumu, kanıtı ve raporlamayı düzenleyen bir sistemden ayırıyor. Alıcılar için doğru çerçeve budur. Soru, aracın hacker gibi şeyler söyleyip söyleyemeyeceği değildir. Asıl soru, gürültülü kanıtlardan doğrulanmış, gözden geçirilebilir bir güvenlik sonucuna giden yolu kısaltıp kısaltamayacağıdır. (Penligent)

Yasal ekipler için daha güvenli bir iş akışı

Meşru saldırı-güvenlik ekipleri için en güvenli yol azami özerklik değildir. Açık kanıt gereksinimleri olan kısıtlı özerkliktir. Yalnızca sahip olunan hedeflerle veya sözleşmeyle yetkilendirilmiş hedeflerle başlayın. Salt okunur keşifleri ucuz, durum değiştirme eylemlerini ise pahalı hale getirin. Gözlemi istismardan ayırın. Aday bulguları doğrulanmış bulgulardan ayırın. Herhangi bir şey rapora terfi etmeden önce ham eserler isteyin. Araç çağrılarının ve onayların tekrar oynanabilir bir izini koruyun. Bu ilkeler, mevcut araştırmaların yönü, NIST'in ajan kaçırma kılavuzu, OWASP'nin LLM risk çerçevesi ve güvenli ajan tasarımına ilişkin satıcı kılavuzu ile uyumludur. (NIST)

Asgari bir politika şu şekilde olabilir:

angajman:

hedefler:

- app.staging.example.com

- api.staging.example.com

yasaklanmıştır:

- production_data_exfiltration

- destructive_actions

- persistence_changes

tool_policy:

read_only_default: true

approval_required:

- shell_write

- file_write

- veritabanı_yazma

- privileged_api_action

evidence_requirements:

- raw_request_response

- reproduction_steps

- negative_control

- impact_statement

- retest_guidance

Bu tür bir politika kasıtlı olarak sıkıcıdır. Mesele de bu zaten. İyi bir saldırgan otomasyon, doğaçlama tiyatrodan ziyade disiplinli değişiklik kontrolü gibi hissettirmelidir. Bir iş akışı hedef sınırlarını, izin verilmeyen eylemleri, onay kapılarını ve kanıt gereksinimlerini bu kadar yalın bir biçimde ifade edemiyorsa, önemli hiçbir şeye dokunmaya hazır değildir. (OpenAI Geliştiricileri)

Bulgular için terfi mantığı da aynı derecede sıkıcı ve aynı derecede katı olmalıdır:

def promote_finding(finding: dict) -> str:

gerekli = [

"raw_artifacts",

"reproduction_steps",

"negatif_kontrol",

"impact_statement",

"affected_scope",

]

if any(not finding.get(k) for k in required):

return "aday"

if finding.get("state_change_performed") and not finding.get("human_approved"):

return "aday"

if finding.get("confidence") != "verified":

return "aday"

return "doğrulandı"

Bu, modeli daha akıllı yapmaz. İş akışını daha güvenli hale getirir. Bu genellikle daha önemli bir gelişmedir. Birçok sözde hacker AI GPT sistemi başarısız olur çünkü terfi disiplini yerine akıcı çıktı için optimizasyon yaparlar. Bir raporu bozmanın en hızlı yolu, bir modelin kanıt kapısı olmadan makul açıklamadan doğrulanmış bulguya atlamasına izin vermektir. (OpenAI Geliştiricileri)

Faydalı bir bulgu eseri, başka bir mühendisin düz yazıya güvenmeden inceleyebileceği kadar yapılandırılmış olmalıdır:

{

"finding_type": "idor",

"varlık": "api.staging.example.com",

"uç nokta": "GET /v1/invoices/{invoice_id}",

"tested_roles": ["customer_basic", "customer_admin"],

"beklenen": "Kiracılar arası nesne erişimi için 403 Forbidden",

"gözlemlendi": "200 OK with foreign tenant invoice data",

"raw_artifacts": [

"request_001.txt",

"response_001.txt",

"request_002.txt",

"response_002.txt"

],

"negative_control": "kendi kiracı faturası ile aynı istek beklenen 200 OK'yi döndürür",

"impact_statement": "kiracılar arası fatura açıklaması",

"retest_guidance": "aynı rol çiftini kullanarak nesne düzeyinde yetkilendirme düzeltmesinden sonra tekrarlayın"

}

Bu yapının faydası estetik değildir. Modelin raporlama hattına neleri kaçırmasına izin verildiğini sınırlar ve insan incelemesini çok daha kolay hale getirir. Ayrıca güvenlik mühendisleri, denetçiler ya da düzeltme sahipleri gibi sonraki tüketicilerin bir istismar iddiası ile yapıt destekli bir sonuç arasındaki farkı anlamalarına yardımcı olur. Bu tam da mevcut ajan güvenliği kılavuzunun yapılandırılmış çıktılar ve kontrollü veri akışı hakkında konuşurken tavsiye ettiği türden bir tasarım hamlesidir. (OpenAI Geliştiricileri)

Sahip olunan sistemlerde, basit envanter hijyeni de uzun bir yol kat eder. Şaşırtıcı sayıda kuruluş, yerel geliştirici ortamlarında veya CI çalıştırıcılarında ajan araçlarının nerede bulunduğunu bilmiyor.

python -m pip list | egrep 'langchain|langflow|openai|anthropic|mcp'

find "$HOME" -type f \( -name "mcp.json" -o -name "*.code-workspace" -o -path "*/.cursor/mcp.json" \) 2>/dev/null

Bu komutlar kendi başlarına hiçbir şeyi güvence altına almazlar, ancak bu alandaki ilk yetişkin sorusunu yanıtlamaya yardımcı olurlar: halihazırda çalışan neyimiz var ve halihazırda nereye ulaşabilir. Son CVE'ler LangChain bileşenlerinde, Langflow iş akışı yüzeylerinde ve Cursor artı MCP güven zincirlerinde gerçek risk olduğunu gösterdiğinde bu envanter adımı çok daha acil hale geliyor. (GitHub)

En güçlü meşru YZ pentest iş akışları giderek aynı şekle yaklaşmaktadır. Yorumlama ve planlama için yetenekli bir model, gözlem ve doğrulama için deterministik araçlar, durum değiştiren eylemler için açık onaylar ve terfi öncesi eser tabanlı kapılar kullanırlar. Bu aynı zamanda satıcıları değerlendirmek için en doğal yerdir. Penligent'in kamuya açık materyali, tekrarlanabilir kanıtları, kapsam kontrollerini ve sinyalden kanıta doğru adım adım ilerlemeyi ön plana çıkardığında bu modelle yönsel olarak uyumludur. Buradan çıkarılacak ders herhangi bir üründen daha büyüktür: ciddi bir "AI hacker" iş akışı kısıtlı, denetlenebilir ve kanıt odaklı olmalıdır. (Penligent)

Savunmacıların kaydetmesi gerekenler

Savunucular, bir temsilci güvenilmeyen içeriği okuyabiliyor ve araçları arayabiliyorsa, önemli olan günlüklerin yalnızca ağ günlükleri veya uç nokta uyarıları olmadığını varsaymalıdır. Bunlar aynı zamanda iş akışı günlükleridir. Model sürümünü, geliştirici talimatlarını, onay kararlarını, araç tanımlarını, araç çağırma argümanlarını, geri dönen eserleri ve nihai rapor çıktılarını koruyun. Bu zincir olmadan, olay müdahalesi kötü bir eylemin model halüsinasyonundan mı, kötü niyetli bağlam enjeksiyonundan mı, aşırı geniş araç erişiminden mi yoksa sarmalayıcı uygulamadaki bir hatadan mı kaynaklandığını söyleyemez. (OpenAI Geliştiricileri)

OAuth ve MCP telemetrisi özel bir ilgiyi hak etmektedir. Hangi MCP sunucusunun keşfedildiğini, yetkilendirme meta verilerinin nasıl elde edildiğini, hangi kapsamların talep edildiğini, hangi kapsamların verildiğini, sunucuya daha önce güvenilip güvenilmediğini ve kullanıcının bir araç çağrısını açıkça onaylayıp onaylamadığını günlüğe kaydedin. MCP spesifikasyonunun korumalı kaynak meta verilerine ve kapsam sinyallerine yaptığı vurgu evrak işi değildir. Bir araç çağrısına ilk etapta neden izin verildiğini yeniden yapılandırmanın tek güvenilir yollarından biridir. (Model Bağlam Protokolü)

Yapılandırma dosyası bütünlüğü de birçok ekibin fark ettiğinden daha önemlidir. Cursor CVE'leri, çalışma alanı dosyalarının ve MCP'ye duyarlı yapılandırma dosyalarının etkisiz olmadığını hatırlatmaktadır. Etmenli ortamlarda, yürütme eksenleri haline gelebilirler. Özellikle bir aracı güvenilmeyen proje içeriğini aldıktan sonra hassas yapılandırma yolları için dosya oluşturma veya değiştirme işlemlerinin izlenmesi, artık yapay zeka destekli geliştirme ortamları için savunma temelinin bir parçasıdır. (NVD)

Savunucular ayrıca sistemin yapmayı reddettiği şeylere ilişkin kanıtları da muhafaza etmelidir. Negatif izler değerlidir. Kullanıcı onaylı bir aracı tehlikeli bir yazma işleminden engellenmişse, bu kontrolün işe yaradığının bir işaretidir. Bir model harici bir belgeyi aldıktan sonra yüksek riskli bir aracı çağırmaya çalıştıysa, bu, eylem hiç tamamlanmamış olsa bile istem enjeksiyon yüzeyinin gerçek olduğunun bir işaretidir. Olgun telemetri sadece başarılı suistimallerle ilgili değildir. Bu, kontrol düzleminizin nerede zayıf olduğunu ortaya çıkaran neredeyse ıskalama ile ilgilidir. (OpenAI Geliştiricileri)

Son olarak, ekipler telemetrinin kendisini test etmelidir. NIST'in agent-hijacking çalışması burada faydalı bir modeldir çünkü tek bir toplam sayı yerine çoklu denemeleri, uyarlanabilir saldırı tasarımını ve göreve özel analizi vurgulamaktadır. Kağıt üzerinde yeterli görünen bir günlük tutma stratejisi, gerçek bir dolaylı istem enjeksiyonu, kötü niyetli bir MCP sunucusu veya yerel bir yapılandırma dosyası güven zinciri saldırısı altında başarısız olabilir. Bunu keşfetmenin zamanı, bir ajan başkasının izinleriyle hareket ettikten sonra değil, kontrollü bir kırmızı ekip tatbikatı içinde olur. (NIST)

2026'da doğru sonuç

Hacker AI GPT bir efsane değildir ve bitmiş bir otonom hacker da değildir. Araştırma kayıtları, modeller daha iyi bir iskele içine yerleştirildiğinde gerçek yetenek kazanımlarını göstermektedir. Tehdit-istihbarat raporları, kötü niyetli aktörlerin siber suç ve izinsiz giriş desteği için yapay zekayı zaten operasyonel hale getirdiğini göstermektedir. Mevcut CVE'ler, bu sistemlerin kırılganlığının genellikle tek başına dil modelinden ziyade yürütme köprülerinde, iş akışı platformlarında, IDE güven zincirlerinde ve bağlı araç sınırlarında yaşadığını göstermektedir. (USENIX)

Kategori hakkında düşünmenin yanlış yolu, modelin kendi başına "hack" yapıp yapamayacağını sormaktır. Bu çerçeveleme çok teatraldir ve yeterince teknik değildir. Doğru yol, sistemin neleri gözlemleyebileceğini, neleri yürütebileceğini, hangi izinleri devraldığını, hangi kanıtları ürettiğini ve aday bir eylemden doğrulanmış bir sonuca ne kadar güvenli bir şekilde geçtiğini sormaktır. İnşaatçılar, alıcılar ve savunucular için önemli olan tasarım sorunu budur. (OpenAI Geliştiricileri)

Şüphecilik için hala çok yer var. Kıyaslamalar, siber güvenlik bilgisi ile uyarlanabilir saldırı performansı arasında anlamlı bir uçurum olduğunu göstermeye devam ediyor. Statik güvenlik iddiaları uyarlanabilir kırmızı ekip karşısında başarısız oluyor. Yeraltı markalaşması model yeniliğini abartıyor. Yapay zekaya bağlı olduğu bildirilen bazı güvenlik açıkları konusunda tedarikçiler arasında anlaşmazlık var. Bunların hiçbiri rehaveti haklı çıkarmaz. Bu sadece, alanın abartıdan ziyade hassasiyetle tartışılması gerektiği anlamına gelmektedir. (arXiv)

Bu teknolojiden en fazla faydayı sağlayacak olan ekipler, en sinematik demonun peşinde koşanlar değil. Onlar gözlemden kanıta giden en kısa ve en güvenli yolu inşa edenlerdir. 2026 yılında, gösterişli bir hacker AI GPT ile ciddi bir güvenlik iş akışına gerçekten ait olabilecek bir sistem arasındaki en temiz ayrım çizgisi bu olmaya devam ediyor. (Penligent)

Daha fazla okuma

PentestGPT, USENIX Security 2024 makalesi ve resmi proje materyalleri, LLM destekli sızma testinin orijinal araştırma çerçevesini anlamak için en iyi başlangıç noktası olmaya devam etmektedir. (USENIX)

NIST'in Üretken Yapay Zeka Profili ve ajan kaçırma konusundaki teknik blogu, doğrudan ve dolaylı uyarı enjeksiyonunu, göreve özgü ajan riskini ve uyarlanabilir değerlendirmelerin neden önemli olduğunu anlamak için gereklidir. (NIST Yayınları)

OWASP'ın LLM Top 10'u, OpenAI'nin fonksiyon çağırma dokümantasyonu, OpenAI'nin ajan güvenliği kılavuzu ve MCP spesifikasyonu artı güvenlik en iyi uygulamaları, daha güvenli ajan sistemleri ve araç çağırma sınırları tasarlamak için en açık güncel referanslardır. (OWASP)

Mevcut tehdit faaliyetleri için Google Threat Intelligence Group'un Şubat 2026 tarihli raporu, Anthropic'in Ağustos 2025 tarihli tehdit istihbarat raporu ve OpenAI'nin kamuya açık kötü niyetli kullanım raporları yukarıda tartışılan en ilgili birincil kaynaklardır. (blog.google)

İlgili Penligent okuması için, genel ürün sayfası, AI Pentest Tool makalesi ve Pentest GPT makalesi bu konu için en doğrudan ilgili dahili referanslardır. (Penligent)