जो लोग OpenAI बग बाउंटी पाने के लिए AI पेंटस्ट टूल का उपयोग कैसे करें, यह खोज रहे हैं, वे आमतौर पर तीन अलग-अलग समस्याओं को एक साथ मिला रहे होते हैं। पहली है दायरा। दूसरी है उपकरण। तीसरी है सबूत। OpenAI के सार्वजनिक कार्यक्रम निश्चित, उच्च-मूल्य की खोजों को तो पुरस्कृत करते हैं, लेकिन वे अस्पष्ट जिज्ञासा, सामान्य जेलब्रेक स्क्रीनशॉट, या प्लेटफ़ॉर्म को तब तक धकेलने के व्यापक प्रयासों को पुरस्कृत नहीं करते जब तक कि कुछ अजीब न हो जाए। OpenAI के सार्वजनिक नियम यह भी स्पष्ट करते हैं कि उपयोगकर्ता सेवा में हस्तक्षेप नहीं कर सकते, रेट लिमिट या सुरक्षा उपायों को दरकिनार नहीं कर सकते, या सेवा का उपयोग अवैध, हानिकारक या दुरुपयोगपूर्ण गतिविधि के लिए नहीं कर सकते। इसका मतलब है कि जीतने वाली मानसिकता यह नहीं है कि "मैं एक AI टूल से OpenAI पर कैसे और ज़्यादा हमला करवाऊं।" यह है कि "मैं शोर को कम करने, संदर्भ को संरक्षित करने, और एक ऐसी सुव्यवस्थित, दोहराई जा सकने वाली, ठोस रिपोर्ट बनाने के लिए AI का उपयोग कैसे करूँ जो सार्वजनिक नियमों के अनुरूप हो।" (ओपनएआई)

यह अंतर 2026 में एक साल पहले की तुलना में कहीं अधिक मायने रखता है। OpenAI के पास अब एक लंबे समय से चल रहा सुरक्षा बग बाउंटी कार्यक्रम है और 25 मार्च, 2026 से, AI-विशिष्ट दुरुपयोग और सुरक्षा जोखिमों को लक्षित करने वाला एक अलग सार्वजनिक सुरक्षा बग बाउंटी कार्यक्रम भी है। सुरक्षा लेन अभी भी तकनीकी कमजोरियों के बारे में है। सुरक्षा श्रेणी में अब स्पष्ट रूप से कुछ एजेंटिक प्रॉम्प्ट इंजेक्शन, डेटा एक्सफिल्ट्रेशन, स्वामित्व वाली जानकारी का खुलासा, और खाता या प्लेटफ़ॉर्म अखंडता संबंधी मुद्दे शामिल हैं। साथ ही, OpenAI की सार्वजनिक सामग्री अभी भी कहती है कि सामान्य जेलब्रेक सुरक्षा कार्यक्रम के दायरे से बाहर हैं, और सुरक्षा कार्यक्रम के लिए Bugcrowd की सार्वजनिक सूची कहती है कि केवल मॉडल प्रॉम्प्ट और प्रतिक्रिया सामग्री से जुड़े मुद्दे तब तक पूरी तरह से दायरे से बाहर हैं जब तक कि उनमें अतिरिक्त प्रत्यक्ष रूप से सत्यापनीय सुरक्षा प्रभाव न हो। यदि आप परीक्षण करने से पहले उन श्रेणियों को अलग नहीं करते हैं, तो आपका एआई सहायक आपको गलत चीज़ के बारे में एक संवारकर तैयार की गई रिपोर्ट लिखने में मदद कर सकता है। (ओपनएआई)

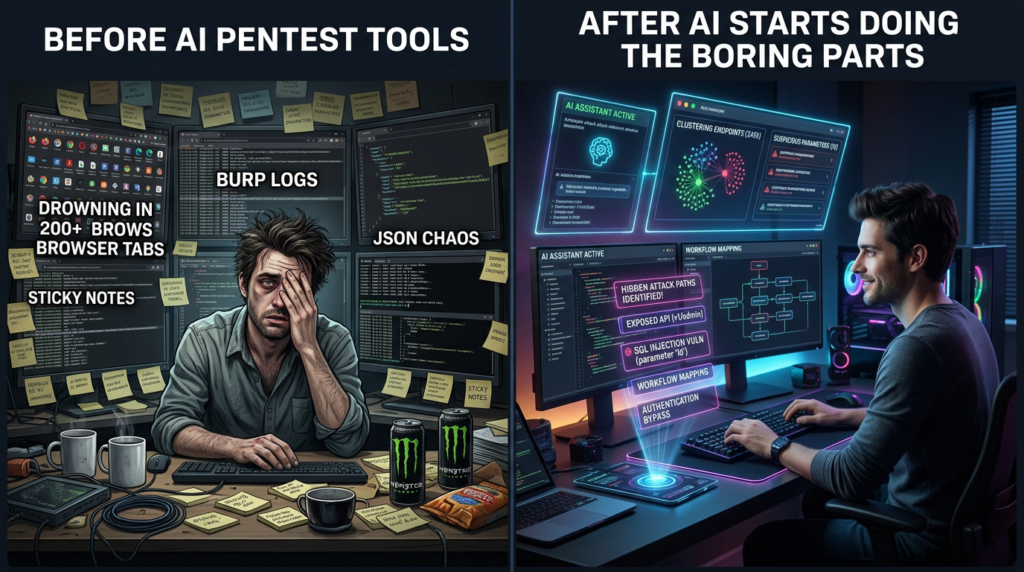

कठोर सच्चाई यह है कि एआई पेनेटस्ट उपकरण यहाँ उपयोगी हैं, लेकिन उस तरह से नहीं जैसा हाइप बताता है। शोध और प्रैक्टिशनर उपकरणों से मिले सर्वश्रेष्ठ प्रमाण कहते हैं कि एआई मुख्य रूप से उप-कार्यों में मदद करता है: उपकरण आउटपुट की व्याख्या, परिकल्पना निर्माण, नोट संपीड़न, पेलोड विविधीकरण, प्रतिक्रिया सारांश और रिपोर्ट मसौदा तैयार करना। यही प्रमाण यह भी कहते हैं कि पूर्ण एंड-टू-एंड स्वायत्त पेनेट्रेशन टेस्टिंग अभी भी अविश्वसनीय बनी हुई है। PentestGPT के मूल पेपर में उप-कार्यों पर वास्तविक लाभ पाए गए और संदर्भ हानि को कम करने के लिए वास्तुशिल्प पृथक्करण का प्रस्ताव दिया गया। PentestEval, जो 2025 के अंत में प्रकाशित हुआ, ने 12 यथार्थवादी कमजोर परिदृश्यों में 346 कार्यों का परीक्षण किया और समग्र रूप से आम तौर पर कमजोर प्रदर्शन पाया, जिसमें एंड-टू-एंड पाइपलाइनें केवल 31 प्रतिशत सफलता दर तक पहुंच पाईं और स्वायत्त एजेंट "लगभग पूरी तरह से विफल" हो गए। PortSwigger का वर्तमान Burp AI दस्तावेज़ीकरण व्यावहारिक उत्पाद के रूप में भी यही स्थिति रखता है: Burp AI, Repeater के अंदर एक ऑन-डिमांड सहायक है, और इसे विशेषज्ञता को बढ़ाने के लिए डिज़ाइन किया गया है, जबकि परीक्षक नियंत्रण में बना रहता है। (arXiv)

यह वह ढांचा है जो वास्तव में OpenAI बग बाउंटी कार्य के लिए काम करता है। उबाऊ मध्य भाग को छोटा करने के लिए AI का उपयोग करें। इसे दायरे, वैधता या प्रभाव के बारे में निर्णय का विकल्प न समझें। इसे साक्ष्यों को संरचित करने, राज्यों की तुलना करने, बड़े ट्रैफ़िक सेट का सारांश निकालने, समान निष्कर्षों को समूहबद्ध करने और अव्यवस्थित नोट्स को एक सुसंगत रिपोर्ट में बदलने के लिए उपयोग करें। इसे OpenAI की सार्वजनिक शर्तों और बाउंटी नियमों द्वारा अनुमत आचरण की सीमा से परे जाँच करने की अनुमति न समझें।ओपनएआई)

2026 में OpenAI बग बाउंटी, सुरक्षा दायरा और सुरक्षा दायरा अब एक ही बात नहीं रहे

OpenAI की सार्वजनिक बग बाउंटी कहानी अब दो मार्गों में है। पुराना मार्ग सुरक्षा बग बाउंटी कार्यक्रम है, जिसे अप्रैल 2023 में पेश किया गया था, जिसमें OpenAI द्वारा वर्णित सार्वजनिक पुरस्कार कम-गंभीरता वाले निष्कर्षों के लिए $200 से लेकर असाधारण खोजों के लिए $20,000 तक हैं। नई लेन सार्वजनिक सेफ्टी बग बाउंटी है, जिसे 25 मार्च, 2026 को लॉन्च किया गया है, ताकि एआई-विशिष्ट दुरुपयोग और सुरक्षा जोखिमों को स्वीकार किया जा सके जो सुरक्षा भेद्यता की क्लासिक परिभाषा में फिट नहीं हो सकते। OpenAI का कहना है कि दायरे और स्वामित्व के आधार पर रिपोर्टों को दोनों टीमों के बीच पुनर्निर्देशित किया जा सकता है। (ओपनएआई)

सार्वजनिक सुरक्षा बग बाउंटी श्रेणियाँ असामान्य रूप से महत्वपूर्ण हैं क्योंकि वे शोधकर्ताओं को बताती हैं कि OpenAI अब एक पुरस्कार-योग्य AI-विशिष्ट समस्या को क्या मानता है। आधिकारिक घोषणा में एजेंटिक जोखिमों का नाम लिया गया है, जिनमें MCP शामिल हैं, जैसे तृतीय-पक्ष प्रॉम्प्ट इंजेक्शन और डेटा एक्सफिल्ट्रेशन, जब हमलावर-नियंत्रित टेक्स्ट विश्वसनीय रूप से किसी पीड़ित के एजेंट को हानिकारक कार्रवाई या संवेदनशील जानकारी के प्रकटीकरण के लिए हाईजैक कर सकता है, और यह व्यवहार कम से कम 50 प्रतिशत समय में दोहराया जा सकता है। इसमें OpenAI की वेबसाइट पर बड़े पैमाने पर किए गए कुछ एजेंटिक कार्य, संभावित रूप से हानिकारक अन्य एजेंटिक कार्य जिनसे यथार्थपूर्ण और महत्वपूर्ण हानि हो सकती है, तर्कसंगतता से संबंधित OpenAI की स्वामित्व वाली जानकारी का खुलासा, और एंटी-ऑटोमेशन नियंत्रणों को बायपास करना, खाता ट्रस्ट संकेतों में हेरफेर करना, या निलंबन या प्रतिबंधों से बचना जैसे खाता या प्लेटफ़ॉर्म अखंडता से जुड़े मुद्दे भी शामिल हैं। OpenAI यह भी कहता है कि अधिकृत अनुमतियों से परे सुविधाओं, डेटा या कार्यक्षमता तक पहुंच की अनुमति देने वाले मुद्दों को इसके बजाय सुरक्षा बग बाउंटी में भेजा जाना चाहिए। (ओपनएआई)

इतना ही महत्वपूर्ण है कि क्या दायरे से बाहर रहता है। OpenAI स्पष्ट रूप से कहता है कि सामान्य जेलब्रेक सार्वजनिक सुरक्षा बग बाउंटी के दायरे से बाहर हैं, सिवाय कुछ निजी अभियानों के जो विशिष्ट हानि प्रकारों पर केंद्रित हैं। उसी घोषणा में यह भी जोड़ा गया है कि बिना किसी स्पष्ट सुरक्षा या दुरुपयोग प्रभाव के सामान्य सामग्री-नीति बाईपास भी दायरे से बाहर हैं, और उदाहरण के तौर पर ऐसे जेलब्रेक दिए गए हैं जो केवल अभद्र भाषा उत्पन्न करते हैं या ऐसी जानकारी लौटाते हैं जो सर्च इंजन से आसानी से मिल सकती है। OpenAI की CVE असाइनमेंट नीति अलग से कहती है कि AI मॉडल की सुरक्षा कमजोरियाँ जो व्यवहार या सामग्री से संबंधित हैं, जैसे प्रॉम्प्ट जेलब्रेक, हॉलुसिनेशन और नीति बाईपास, उस CVE कार्यक्रम के दायरे में नहीं आतीं। सुरक्षा कार्यक्रम के लिए सार्वजनिक बगक्राउड स्निपेट्स में भी कहा गया है कि प्रॉम्प्ट और प्रतिक्रिया सामग्री से संबंधित मुद्दे तब तक पूरी तरह से दायरे से बाहर हैं जब तक कि कोई अतिरिक्त सीधे तौर पर सत्यापन योग्य सुरक्षा प्रभाव न हो। सीधी भाषा में कहें तो, "मॉडल ने कुछ अजीब किया" आमतौर पर पर्याप्त नहीं है; "मॉडल, एजेंट, या प्लेटफ़ॉर्म ने पुन: उत्पन्न होने वाले नुकसान के साथ एक ठोस सुरक्षा या सुरक्षा सीमा को पार किया" वह मानक है जो मायने रखता है। (ओपनएआई)

एक कानूनी और परिचालन परत भी है जिसे शोधकर्ता अपनी ही हानि पर अनदेखा करते हैं। OpenAI की उपयोग की शर्तें कहती हैं कि आप सेवाओं का उपयोग अवैध, हानिकारक या दुरुपयोगपूर्ण गतिविधि के लिए नहीं कर सकते, स्वचालित या प्रोग्रामैटिक रूप से डेटा या आउटपुट निकाल नहीं सकते, अंतर्निहित घटकों का रिवर्स इंजीनियरिंग नहीं कर सकते, या दर सीमाओं, प्रतिबंधों, सुरक्षात्मक उपायों या सुरक्षा शमन को दरकिनार करके सेवा में हस्तक्षेप नहीं कर सकते। उपयोग नीतियाँ यह भी जोड़ती हैं कि OpenAI तब तक पहुँच रोक सकती है जब तक उसे यह उचित न लगे कि सेवा या उपयोगकर्ताओं की सुरक्षा के लिए आवश्यक है। ये दस्तावेज़ बाउंटी सेफ हार्बर को समाप्त नहीं करते, लेकिन वे प्रकाशित सहभागिता के भीतर सख्ती से बने रहने और सद्भावना से कार्य करने की आवश्यकता को मजबूत करते हैं। Bugcrowd के OpenAI पृष्ठों के सार्वजनिक स्निपेट्स भी कार्यक्रम नियमों के सद्भावनापूर्ण अनुपालन के लिए सेफ हार्बर भाषा का संकेत देते हैं। (ओपनएआई)

यदि आप उस प्रकार के शोधकर्ता हैं जो CVEs में सोचते हैं, तो एक और अंतर महत्वपूर्ण है। OpenAI 2025 में अपने उत्पादों और सेवाओं में कमजोरियों के लिए एक CVE नंबरिंग प्राधिकरण बन गया, लेकिन सार्वजनिक नीति कहती है कि यह आम तौर पर सर्वर-साइड मुद्दों के लिए CVE आईडी आरक्षित नहीं करेगा, और यह रक्षा-इन-डेप्थ फिक्स, गलत कॉन्फ़िगरेशन, या सूचनात्मक निष्कर्षों के लिए CVE असाइन नहीं करेगा। यह भी कहता है कि मॉडल-व्यवहार सुरक्षा संबंधी मुद्दे उस CVE प्रक्रिया के दायरे से बाहर हैं। इसलिए यदि आपका मानसिक मॉडल "महत्वपूर्ण बग = CVE" है, तो आप परिणामों की संभावनाओं को गलत समझेंगे। कुछ मूल्यवान बग बाउंटी रिपोर्ट बाउंटी-योग्य हो सकती हैं लेकिन सार्वजनिक CVE कभी नहीं बनतीं। कुछ महत्वपूर्ण AI सुरक्षा निष्कर्ष पूरी तरह से एक अलग प्रकटीकरण पथ में हो सकते हैं। OpenAI की सार्वजनिक नीति यह भी कहती है कि उसका लक्ष्य भेद्यता रिपोर्टों को तीन व्यावसायिक दिनों के भीतर स्वीकार करना और शमन के लागू होने के बाद प्रकटीकरण का समन्वय करना है। (ओपनएआई)

नीचे दिया गया सार्वजनिक मैट्रिक्स काम करते समय आपके सामने रखना महत्वपूर्ण है, क्योंकि यह इस क्षेत्र में सबसे आम श्रेणी त्रुटि को रोकता है।ओपनएआई)

| पैटर्न जारी करें | सबसे संभावित लेन | यह वहाँ क्यों है | आमतौर पर कौन सा सबूत सबसे अधिक मायने रखता है | सामान्य गलती |

|---|---|---|---|---|

| विशेषताओं, डेटा या कार्यक्षमता तक अनधिकृत पहुँच | सुरक्षा बग बाउंटी | OpenAI स्पष्ट रूप से अधिकृत अनुमति से परे के मुद्दों को सुरक्षा विभाग को भेजता है। | स्वच्छ पुनरुत्पादन, प्रभावित दायरा, प्राधिकरण सीमा, उपयोगकर्ता प्रभाव | क्योंकि कहीं न कहीं एआई शामिल था, इसे "जेलब्रेक" के रूप में दर्ज करना। |

| तृतीय-पक्ष प्रॉम्प्ट इंजेक्शन जो एजेंट को संवेदनशील डेटा बाहर भेजने या हानिकारक कार्रवाई करने के लिए प्रेरित करता है। | सुरक्षा बग बाउंटी | OpenAI इस श्रेणी का स्पष्ट रूप से नाम बताता है और पुनरुत्पादन क्षमता की मांग करता है। | स्थिर पुनरुत्पादन पथ, हमलावर-नियंत्रित सामग्री, अवलोकित हानिकारक कार्रवाई या प्रकटीकरण, सफलता दर | वास्तविक कार्रवाई या सूचना निकासी के बिना अजीब मॉडल टेक्स्ट का स्क्रीनशॉट जमा करना |

| खाते के भरोसे के संकेतों में हेरफेर, स्वचालन-रोधी नियंत्रण, या निलंबन से बच निकलना | सुरक्षा बग बाउंटी | खाते और प्लेटफ़ॉर्म की अखंडता को स्पष्ट रूप से नामित किया गया है। | स्थिति से पहले और बाद की कंक्रीट, दुरुपयोग की संभावना, पुनरुत्पादन क्षमता, दायरे की स्पष्टता | सत्यापित प्लेटफ़ॉर्म प्रभाव के बिना अनुमानित दुरुपयोग का वर्णन |

| सामान्य असभ्य या नीति का उल्लंघन करने वाला आउटपुट | सार्वजनिक सुरक्षा कार्यक्रम के दायरे से बाहर | OpenAI का कहना है कि सामान्य जेलब्रेक और कम-हानि नीति बाईपास दायरे से बाहर हैं। | आमतौर पर कोई नहीं, क्योंकि कोई ठोस सुरक्षा या सुरक्षा सीमा पार नहीं हुई। | सामग्री संबंधी समस्या को "गंभीर सुरक्षा" के रूप में पेश करना |

| अलग-थलग सुरक्षा प्रभाव के बिना मॉडल भ्रम | CVE के दायरे से बाहर और आमतौर पर सुरक्षा बाउंटी के लिए उपयुक्त नहीं। | OpenAI की CVE नीति मॉडल के व्यवहार संबंधी समस्याओं को शामिल नहीं करती है। | लागू नहीं, जब तक कि यह किसी ठोस भेद्यता या हानिकारक एजेंट की कार्रवाई से जुड़ा न हो। | तथ्यात्मक त्रुटि को सुरक्षा बग के रूप में मानना |

| स्वामित्वयुक्त तर्क-संबंधी जानकारी या अन्य स्वामित्वयुक्त जानकारी का प्रकटीकरण | सुरक्षा बग बाउंटी | OpenAI के सार्वजनिक सुरक्षा पृष्ठ पर स्पष्ट रूप से सूचीबद्ध | प्रकटीकरण का स्पष्ट प्रमाण, जो उजागर हुआ, पुनरुत्पादन क्षमता, यह सामान्य आउटपुट क्यों नहीं है। | सामान्य सिस्टम व्यवहार या सार्वजनिक जानकारी को मालिकाना प्रकटीकरण समझ लेना |

एआई पेनेटस्ट उपकरण सबसे अधिक सबूतों और स्थिति का आकलन करने में मदद करते हैं, अनुमान लगाने में नहीं।

बहुत सारी बर्बाद बग बाउंटी का प्रयास एआई से गलत काम करवाने से होता है। शोध रिकॉर्ड यहाँ सुसंगत है। PentestGPT का मुख्य योगदान यह नहीं था कि "मॉडल स्वयं हैक करता है।" यह कार्यप्रवाह को इस तरह विभाजित करना था कि मॉडल प्रत्येक चरण में बेहतर प्रदर्शन कर सके, बिना पूरे परिदृश्य को संदर्भ-भटकाव के कारण खोए। पेपर में कहा गया है कि एलएलएम परीक्षण उपकरणों का उपयोग करने, परिणामों की व्याख्या करने और अगली कार्रवाइयों का प्रस्ताव रखने जैसे उप-कार्यों में मजबूत थे, जबकि पूरे कार्य की एकीकृत समझ बनाए रखने में अभी भी संघर्ष कर रहे थे। PentestEval ने उस आलोचना को और तीखा किया: वर्तमान प्रणालियाँ समग्र कार्यप्रवाह में कमजोर बनी हुई हैं, विशेष रूप से दीर्घकालिक, अंत-से-अंत स्वायत्तता में। (arXiv)

यही वजह है कि AI अभी भी बाउंटी कार्य के लिए बेहद उपयोगी हो सकता है। बग बाउंटी हंटिंग महंगे कॉन्टेक्स्ट स्विच से भरा होता है। आप ब्राउज़र ट्रेस, हेडर, JSON ब्लॉब, स्क्रीनशॉट, नोट्स, खाता स्थितियों, भूमिका के अंतर, और प्रभाव के बारे में परिकल्पनाओं के बीच घूमते हैं। AI उस सामग्री को कुछ ऐसा संपीड़ित करने में अच्छा है जिससे कोई इंसान तेज़ी से तर्क कर सके। Burp AI का वर्तमान उत्पाद फ्रेमिंग इस बिंदु पर असामान्य रूप से ईमानदार है। PortSwigger का कहना है कि यह HTTP संदेशों का विश्लेषण करने, नियमित चरणों को स्वचालित करने, पेलोड विविधताओं का पता लगाने और अंतर्दृष्टि प्राप्त करने में मदद करता है, जबकि ऑपरेटर नियंत्रण में रहता है। यह मार्केटिंग की विनम्रता नहीं है। यह सही संचालन मॉडल है। जिस क्षण आप कानूनी, नैतिक, या दायरे के निर्णय एक सहायक को सौंप देते हैं, आप समय की बचत नहीं कर रहे होते हैं। आप एक अधिक सहज विफलता मोड बना रहे होते हैं। (पोर्टस्विगर)

AI को सहायक भूमिका में रखने का दूसरा कारण यह है कि OpenAI की अपनी एजेंट-सुरक्षा मार्गदर्शिका अब प्रॉम्प्ट इंजेक्शन को एक यथार्थवादी और विकसित हो रहे जोखिम के रूप में देखती है, न कि खिलौने जैसी समस्या के रूप में। OpenAI की मार्च 2026 की सुरक्षा रिपोर्ट कहती है कि वास्तविक दुनिया के सबसे शक्तिशाली संस्करण सरल प्रॉम्प्ट ओवरराइड की तुलना में सामाजिक इंजीनियरिंग से अधिक मेल खाते हैं। इसकी डेवलपर गाइड कहती है कि प्रॉम्प्ट इंजेक्शन आम और खतरनाक हैं, ये निजी डेटा के चोरी होने या डाउनस्ट्रीम टूल्स के माध्यम से गलत कार्यों को जन्म दे सकते हैं, और यह बिल्डरों को चेतावनी देती है कि वे डेवलपर संदेशों में अविश्वसनीय चर न डालें क्योंकि उन संदेशों को अधिक प्राथमिकता दी जाती है। यह केवल एजेंट बनाने वालों के लिए मार्गदर्शन नहीं है। यह बाउंटी वर्कफ़्लो में AI सहायकों का उपयोग करने वाले शोधकर्ताओं के लिए एक चेतावनी है। यदि आप अपने स्वयं के एआई टूल के अंदर एक विशेषाधिकार प्राप्त प्रॉम्प्ट चैनल में अविश्वसनीय लक्ष्य सामग्री पेस्ट करते हैं, तो आप कोई बग खोजने से पहले ही एक लैब दुर्घटना पैदा कर रहे हैं। (ओपनएआई)

व्यावहारिक प्रश्न इसलिए यह नहीं है कि "कौन सा एआई टूल सबसे बुद्धिमान है।" यह है कि "कार्यप्रवाह के किन हिस्सों को एआई सहायता मिलनी चाहिए, और किन हिस्सों में मानवीय हस्तक्षेप आवश्यक है।" नीचे दिया गया उत्तर शोध साहित्य और वर्तमान प्रैक्टिशनर टूलिंग दोनों से मेल खाता है। (arXiv)

| कार्यप्रवाह जॉब | जहाँ एआई मदद करता है | जहाँ मानव को प्राथमिकता बनी रहनी चाहिए | यदि आप एआई पर अत्यधिक भरोसा करते हैं तो विफलता का तरीका |

|---|---|---|---|

| यातायात सारांश | दोहराए गए अनुरोधों को संपीड़ित करें, क्लस्टर पैरामीटरों को समूहित करें, असामान्य फ़ील्ड्स को समझाएँ। | निर्णय करें कि क्या यह पैटर्न वास्तव में सुरक्षा-संबंधी है। | सहायक शोर को एक झूठी कथा में बदल देता है। |

| भूमिका और वस्तु मानचित्रण | संभावित वस्तु संदर्भों, किनारों और दोहराए गए संरचनाओं का पता लगाएँ। | पता करें कि क्या ये अंतर प्राधिकरण की खामियों को दर्शाते हैं या सामान्य व्यावसायिक तर्क का परिणाम हैं। | एआई सामान्य बहु-किरायेदार व्यवहार को आईडीओआर के रूप में लेबल करता है। |

| त्वरित इंजेक्शन ट्रायाज | हमलावर-नियंत्रित सामग्री, सिंक्स, और अवलोकित एजेंट क्रियाओं को व्यवस्थित करें। | निर्णय करें कि हानि पृथक, महत्वपूर्ण और वास्तव में दायरे में है। | मॉडल अजीब आउटपुट को प्रदर्शनीय निकासी के साथ भ्रमित करता है। |

| प्रजनन योजना | नोट्स को साफ-सुथरे चरणों में बदलें, खाता सेटअप की रूपरेखा तैयार करें, समयसीमाओं को सामान्य करें। | हर कदम और हर पूर्वापेक्षा को सत्यापित करें। | आप एक ऐसा स्क्रिप्ट सबमिट करते हैं जो वास्तव में कभी भी समस्या को दोबारा उत्पन्न नहीं करता। |

| प्रभाव लेखन | तकनीकी व्यवहार को संक्षिप्त व्यावसायिक या उपयोगकर्ता प्रभाव में अनुवादित करें। | दावों को साक्ष्यों के अनुपात में रखें। | रिपोर्ट फुला-फुला हो जाती है और विश्वसनीयता खो देती है। |

| पैकेजिंग रिपोर्ट करें | ड्राफ्ट शीर्षक लिखें, संरचना के लिए मार्कडाउन चिह्नित करें, रहस्यों को संपादित करें, परिशिष्टों का स्वरूपण करें। | सटीकता, दायरा और ईमानदारी के लिए अंतिम समीक्षा | एक संवार-सँवार कर तैयार की गई रिपोर्ट भी खारिज हो जाती है क्योंकि उसका मूल दावा गलत है। |

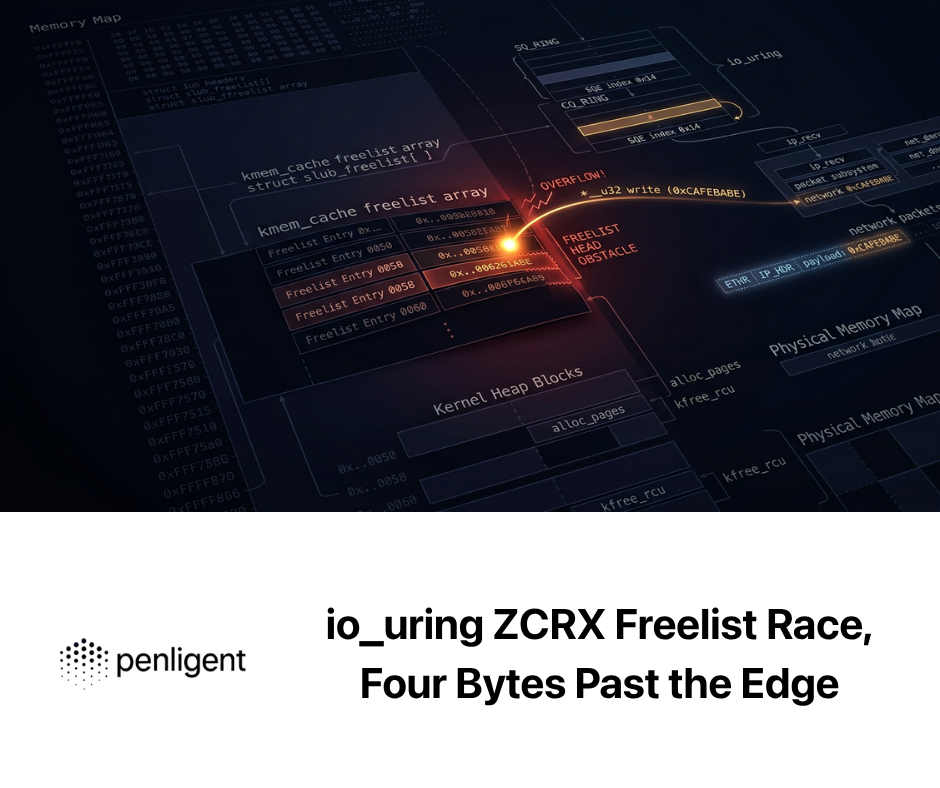

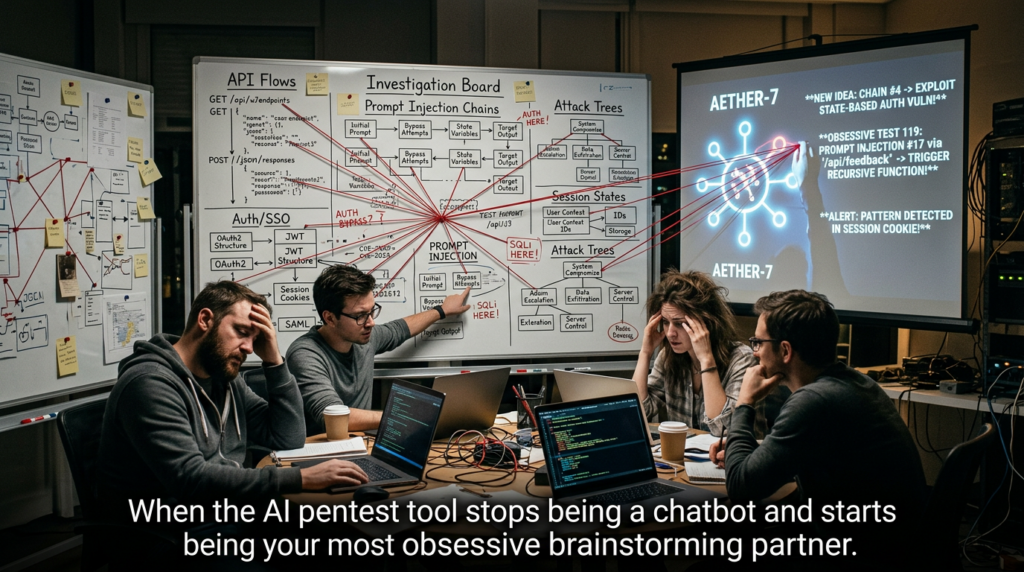

अगर यह "AI हैकर" की पिच से कम ग्लैमरस लगता है, तो इसका कारण यह है कि आक्रामक कार्यों में AI का उपयोगी स्वरूप हाइप की तुलना में कहीं अधिक शांत है। Penligent की हालिया सार्वजनिक लेखनी इस बात को व्यापक साक्ष्यों के अनुरूप इस तरह से प्रस्तुत करती है। बग बाउंटी शोधकर्ताओं और AI पेंटस्ट खरीदारों के लिए लिखे गए इसके पृष्ठ बार-बार इस श्रेणी को एकल-प्रॉम्प्ट स्वायत्तता के बजाय राज्य संरक्षण, उपकरण समन्वय, सत्यापन, साक्ष्य और ऑपरेटर नियंत्रण के इर्द-गिर्द तैयार करते हैं। इस तरह के काम के लिए यह सही रूप है। एक बाउंटी शोधकर्ता के लिए, एक ऐसी प्रणाली जो कच्चे कलाकृतियों और एक रिपोर्ट करने योग्य निष्कर्ष के बीच की दूरी को कम करती है, एक ऐसे चैटबॉट की तुलना में कहीं अधिक मूल्यवान है जो आत्मविश्वास से भरा लगता है जबकि यह छिपाता है कि उसने वास्तव में क्या किया। (पेनलिजेंट)

OpenAI बग बाउंटी रिसर्च के लिए एआई पेनेटस्ट वर्कफ़्लो का निर्माण दायरा नियंत्रण से शुरू होता है।

OpenAI-उन्मुख वर्कफ़्लो में पहला कार्य स्कैनिंग नहीं है। यह वर्गीकरण है। किसी भी AI सहायक को अपने नोट्स छूने देने से पहले, उम्मीदवार मुद्दे को चार में से एक के रूप में लेबल करें: संभावित सुरक्षा, संभावित सुरक्षा-संबंधी, संभावित दायरे से बाहर, या वर्गीकृत करने के लिए बहुत जल्दी। यह सरल लगता है, लेकिन यह आगे की सभी प्रक्रियाओं को बदल देता है। यदि कोई व्यवहार क्लासिक एक्सेस कंट्रोल ड्रिफ्ट, कोटा बाईपास के साथ अकाउंट प्रभाव, अनपेक्षित फीचर एक्सेस, या प्लेटफ़ॉर्म अखंडता की समस्या जैसा दिखता है, तो यह सुरक्षा या प्लेटफ़ॉर्म ट्रैक से संबंधित है। यदि यह हमलावर-नियंत्रित सामग्री जैसा दिखता है जो किसी एजेंट को कार्य करने या डेटा प्रकट करने के लिए प्रेरित कर रही है, तो यह सुरक्षा ट्रैक से संबंधित है। यदि यह केवल एक अजीब पूर्णता, जेलब्रेक-शैली का रोलप्ले, या ठोस सीमा उल्लंघन के बिना एक शर्मनाक आउटपुट है, तो यह शायद सार्वजनिक बाउंटी उद्देश्यों के लिए दायरे से बाहर है। (ओपनएआई)

दूसरा कार्य साक्ष्य स्वच्छता है। कई शोधकर्ता अब सहायता के लिए कच्चा ट्रैफ़िक, स्क्रीनशॉट और ट्रांसक्रिप्ट AI सिस्टम में डालते हैं। यह उपयोगी हो सकता है, लेकिन यह आपकी अपनी सामग्री लीक करने या विश्लेषण को दूषित करने का भी एक बड़ा तरीका है। OpenAI की डेवलपर सुरक्षा मार्गदर्शिका स्पष्ट रूप से चेतावनी देती है कि प्रॉम्प्ट इंजेक्शन, डाउनस्ट्रीम टूल कॉल्स के माध्यम से निजी डेटा लीक कर सकते हैं और बिल्डर्स के पास यह पूरी तरह से नियंत्रण नहीं होता कि मॉडल जुड़े MCPs के साथ क्या साझा कर सकता है। सुरक्षित तरीका यह है कि पहले एक ऑफ़लाइन या कसकर नियंत्रित सबूत फ़ोल्डर रखें, विश्लेषण से पहले गोपनीय जानकारी हटा दें, और तभी सहायक को न्यूनतम आवश्यक संदर्भ दें। भले ही आपके AI टूल में अच्छी सुरक्षा नियंत्रण व्यवस्था हो, फिर भी आप यह स्थानीय नियंत्रण चाहते हैं कि आपकी मशीन से क्या बाहर जाता है। (ओपनएआई डेवलपर्स)

तीसरा कार्य है कि आप अपनी अन्वेषणात्मक सोच को यथासंभव अपने स्वयं के मिरर्स, मॉक्स और डिस्पोजेबल टेस्ट हार्नेसेस पर स्थानांतरित करें। यही वह जगह है जहाँ बहुत से लोग "AI पेंटस्ट टूल" को गलत समझते हैं। सही उपयोग यह नहीं है कि आप किसी लाइव लक्ष्य के खिलाफ स्वायत्त अन्वेषण को छोड़ दें और उम्मीद करें कि प्लेटफ़ॉर्म इसे शोध के रूप में व्याख्यायित करेगा। सही उपयोग यह है कि आप AI को अपने नियंत्रण वाले वातावरण में अपनी परिकल्पनाओं का तनाव परीक्षण करने दें, और केवल सबसे संकीर्ण, सबसे स्वच्छ पुनरुत्पादन को ही वास्तविक लक्ष्य पर वापस लाएं, यदि सार्वजनिक नियम स्पष्ट रूप से इसकी अनुमति देते हैं। NIST का पैठ परीक्षण मार्गदर्शन यहाँ पुराना लेकिन प्रासंगिक बना हुआ है: परीक्षण की योजना बनाई जानी चाहिए, इसे नियंत्रित किया जाना चाहिए, और इसे विश्लेषण और शमन से जोड़ा जाना चाहिए, न कि इसे अपने आप में एक मुक्त-रूप गतिविधि बनने दिया जाना चाहिए। OpenAI के अपने सार्वजनिक नियम, अनुमत आचरण के बाहर सुरक्षात्मक उपायों में हस्तक्षेप, स्क्रैपिंग और उन्हें बाईपास करने पर प्रतिबंध लगाकर इस अनुशासन को सुदृढ़ करते हैं। (एनआईएसटी कंप्यूटर सुरक्षा संसाधन केंद्र)

चौथा कार्य किसी भी ऐसी कार्रवाई से पहले एक मानवीय अनुमोदन द्वार बनाए रखना है जो किसी ऐसी सीमा को छूती हो जिसे आप आसानी से उलट नहीं सकते। एआई आपको बता सकता है कि कोई व्यवहार "संभवतः संकेत देता है" कि एक्सेस कंट्रोल ड्रिफ्ट या एजेंट समझौता हो रहा है। यह जिम्मेदारीपूर्वक यह निर्णय नहीं ले सकता कि आपको किसी वास्तविक प्रोडक्शन सेवा के खिलाफ अगला कदम उठाना चाहिए। सहायक जितना अधिक सक्षम होगा, वह गेट उतना ही महत्वपूर्ण हो जाता है। OpenAI के प्रॉम्प्ट-इंजेक्शन रक्षा लेख में इस समस्या को स्पष्ट रूप से स्रोत और सिंक के रूप में प्रस्तुत किया गया है: अविश्वसनीय बाहरी सामग्री तब खतरनाक हो जाती है जब इसे किसी सिंक जैसे तीसरे पक्ष के प्रसारण, लिंक का अनुसरण करने, या टूल क्रिया के साथ जोड़ा जाता है। यही रूपरेखा शोधकर्ताओं के लिए भी उपयोगी है। जब भी आपके अगले कदम में कोई वास्तविक सिंक शामिल हो, तो एक इंसान को रुकना चाहिए, दायरे की जांच करनी चाहिए, और आगे बढ़ने का निर्णय लेना चाहिए। (ओपनएआई)

एक बहुत ही व्यावहारिक आरंभ बिंदु एक स्थानीय संपादन पास है। नीचे दिया गया कोड जानबूझकर सरल है। यह कोई स्कैनर नहीं है। यह आपके द्वारा कैप्चर किए गए नोट्स या अनुरोधों के लिए एक पूर्व-प्रसंस्करण उपयोगिता है, ताकि आप टोकन, कुकीज़ या स्पष्ट रहस्यों को उजागर किए बिना संरचना का सारांश बनाने के लिए एआई सहायक से कह सकें। यही वह उबाऊ स्वचालन है जो वास्तव में बाउंटी कार्य में समय बचाता है।

import re

from pathlib import Path

SECRET_PATTERNS = [

(re.compile(r'(?i)(authorization:\s*bearer\s+)[^\s]+'), r'\1REDACTED'),

(re.compile(r'(?i)(api[-_ ]?key["\']?\s*[:=]\s*["\']?)[A-Za-z0-9_\-\.]+'), r'\1REDACTED'),

(re.compile(r'(?i)(cookie:\s*)(.+)'), r'\1REDACTED'),

(re.compile(r'(?i)(set-cookie:\s*)(.+)'), r'\1REDACTED'),

(re.compile(r'(?i)(session[_-]?id["\']?\s*[:=]\s*["\']?)[A-Za-z0-9_\-\.]+'), r'\1REDACTED'),

]

def redact_text(text: str) -> str:

redacted = text

for pattern, replacement in SECRET_PATTERNS:

redacted = pattern.sub(replacement, redacted)

return redacted

def redact_file(input_path: str, output_path: str) -> None:

raw = Path(input_path).read_text(encoding="utf-8", errors="ignore")

Path(output_path).write_text(redact_text(raw), encoding="utf-8")

if __name__ == "__main__":

redact_file("captured-request.txt", "captured-request.redacted.txt")

print("संपादित प्रति captured-request.redacted.txt में लिखी गई")

इस तरह की पूर्व-प्रसंस्करण जितनी दिखती है उससे कहीं अधिक प्रासंगिक है। यह आपके सहायक द्वारा अनावश्यक प्रमाण देखने की संभावना को कम करता है, टीम के भीतर संरचित कलाकृतियों को साझा करना आसान बनाता है, और आपको समस्या पर तर्क करने के लिए आवश्यक न्यूनतम प्रमाणों के बारे में सोचने के लिए मजबूर करता है। यह अनुशासन OpenAI के निजी डेटा लीकेज पर दिए गए मार्गदर्शन और इस सामान्य सिद्धांत के साथ अच्छी तरह मेल खाता है कि AI सहायकों को कार्य के लिए आवश्यक संवेदनशील संदर्भ की न्यूनतम मात्रा ही मिलनी चाहिए।ओपनएआई डेवलपर्स)

दूसरा उपयोगी पैटर्न है उन वातावरणों पर विभेदक साक्ष्य जिन पर आपका नियंत्रण होता है। कई महत्वपूर्ण रिपोर्टों का अस्तित्व इस बात पर निर्भर करता है कि क्या आप यह प्रदर्शित कर सकते हैं कि दो भूमिकाएँ, दो सत्र, या दो ऑब्जेक्ट संदर्भ सामान्य अनुप्रयोग भिन्नता के बजाय सुरक्षा-संबंधी अंतर उत्पन्न करते हैं। एआई इस अंतर को समझाने में मदद कर सकता है, लेकिन फिर भी आप अपनी फ़ाइलों में मशीन-जांच योग्य तुलना चाहते हैं।

import json

from collections.abc import Mapping

def flatten(obj, prefix=""):

items = {}

if isinstance(obj, Mapping):

for key, value in obj.items():

next_prefix = f"{prefix}.{key}" if prefix else key

items.update(flatten(value, next_prefix))

elif isinstance(obj, list):

for idx, value in enumerate(obj):

next_prefix = f"{prefix}[{idx}]"

items.update(flatten(value, next_prefix))

else:

items[prefix] = obj

return items

def diff_json(path_a: str, path_b: str):

a = json.load(open(path_a, "r", encoding="utf-8"))

b = json.load(open(path_b, "r", encoding="utf-8"))

flat_a = flatten(a)

flat_b = flatten(b)

all_keys = sorted(set(flat_a.keys()) | set(flat_b.keys()))

for key in all_keys:

va = flat_a.get(key, "")

vb = flat_b.get(key, "")

if va != vb:

print(f"{key}\n A: {va}\n B: {vb}\n")

if __name__ == "__main__":

diff_json("role-a-response.json", "role-b-response.json")

आपके अपने लैब टारगेट या स्पष्ट रूप से अधिकृत टेस्ट फिक्स्चर पर उपयोग किए जाने पर, इस तरह का एक छोटा कंपैरेटर वास्तविक प्राधिकरण ड्रिफ्ट को कहानी-कथन से अलग करने में मदद करता है। यह आपको सबसे अधिक त्वरित जांच-अनुकूल साक्ष्यों में से एक भी प्रदान करता है: वे सटीक फ़ील्ड्स जो बदलीं, शामिल सत्र, और पहले तथा बाद की स्थिति। इस चरण के बाद एआई सबसे अधिक शक्तिशाली होता है, जब यह एक सत्यापित डिफ़ को आपके लिए डिफ़ का आविष्कार करने के बजाय एक पठनीय व्याख्या में बदल सकता है।बगक्राउड दस्तावेज़)

OpenAI बग बाउंटी ट्रायज से बचकर निकलने वाले सबूतों को इकट्ठा करना ही असली काम है।

यदि आपने कभी किसी आशाजनक खोज को ट्राइएज में ढहते हुए नहीं देखा है, तो यह सोचना आकर्षक होता है कि कठिन हिस्सा पहचान ही है। अक्सर ऐसा नहीं होता। कठिन हिस्सा परिणाम को इस तरह से प्रस्तुत करना है कि समीक्षक उसे दोहरा सके, वर्गीकृत कर सके, और यह समझ सके कि यह क्यों महत्वपूर्ण है, बिना आपके लिए आपका सोचने के। Bugcrowd का वर्तमान शोधकर्ता दस्तावेज़ीकरण यहाँ असामान्य रूप से स्पष्ट है। यह कहता है कि रिपोर्ट में यह बताना चाहिए कि बग कहाँ मिला, यह किसे प्रभावित करता है, इसे कैसे पुन: उत्पन्न किया जाए, इसमें शामिल पैरामीटर क्या हैं, और लॉग, फ़ाइलें, स्क्रीनशॉट या वीडियो जैसी प्रूफ़-ऑफ़-कॉन्सेप्ट सहायक जानकारी शामिल होनी चाहिए। यह यह भी कहता है कि रिपोर्ट में न्यूनतम रूप से एक वर्णनात्मक शीर्षक, प्रभावित लक्ष्य, तकनीकी गंभीरता का चयन, भेद्यता का विवरण और संलग्नक शामिल होने चाहिए। दस्तावेज़ चेतावनी देते हैं कि स्वीकृत दायरे से बाहर बार-बार परीक्षण करने पर पहुँच या प्लेटफ़ॉर्म विशेषाधिकार खो सकते हैं। (बगक्राउड दस्तावेज़)

यह आपको बताता है कि एक अच्छे AI पेनेटस्ट वर्कफ़्लो को किस चीज़ के लिए अनुकूलित करना चाहिए। "हर चीज़ ढूँढना" नहीं। "एक सुंदर मार्कडाउन रिपोर्ट बनाना" नहीं। इसे एक ऐसी सबमिशन बनाने के लिए अनुकूलित करना चाहिए जो उन फ़ील्ड्स से ठीक मेल खाती हो जिनकी एक ट्रायगर को पहले से ही ज़रूरत होती है: संक्षिप्त शीर्षक, सटीक लक्ष्य, दोहराया जा सकने वाला वॉकथ्रू, सबूत, और प्रदर्शित प्रभाव। Bugcrowd की रिपोर्ट-लेखन मार्गदर्शन भी इस बात पर ज़ोर देती है कि प्रभाव अनुभाग अक्सर वह जगह है जहाँ रिपोर्टें विफल होती हैं, क्योंकि हंटर वास्तविक संदर्भ में वास्तविक परिणाम की व्याख्या करने के बजाय सामान्य गंभीरता का टेक्स्ट कॉपी कर लेते हैं। दूसरे शब्दों में, रिपोर्ट कमज़ोर इसलिए नहीं होती क्योंकि बग का प्रकार गलत है, बल्कि इसलिए होती है क्योंकि प्रभाव की कहानी आलसी होती है। एआई यहाँ बहुत मदद कर सकता है, लेकिन केवल तभी जब आपके पास ठोस सबूत हों। (बगक्राउड)

OpenAI रिपोर्ट के बारे में सोचने का सबसे अच्छा तरीका इसे एक तकनीकी केस फ़ाइल के रूप में देखना है। एक ऐसा शीर्षक चुनें जो स्थिति, लक्ष्य और परिणाम को नाम दे। "एक्सेस कंट्रोल इश्यू" पर्याप्त नहीं है। "खाता सेटिंग्स में सत्र स्थिति भ्रम मुफ्त-स्तरीय खाते के तहत केवल-सब्सक्रिप्शन सुविधा तक पहुंच की अनुमति देता है" सही ढांचे के करीब है। Bugcrowd की अपनी दस्तावेज़ीकरण कहती है कि शीर्षक में संक्षेप में बग का प्रकार, जहां यह पाया गया, और समग्र प्रभाव बताया जाना चाहिए, और वे ठीक इसी कारण से वर्णनात्मक शीर्षकों को अस्पष्ट शीर्षकों से अलग करते हैं। यदि आपका AI टूल आपके लिए शीर्षक तैयार करता है, तो इसे उस नियम का पालन करने के लिए कहें। (बगक्राउड दस्तावेज़)

फिर रिपोर्ट के मुख्य भाग को चार परतों में विभाजित करें। पहली परत अवलोकन है: समस्या क्या है, एक पैराग्राफ, बिना किसी नाटक के। दूसरी परत वॉकथ्रू है: सटीक चरण, पूर्व-शर्तें, खाते, स्थितियाँ और अनुरोध। तीसरी परत सबूत है: स्क्रीनशॉट, क्लिप, अनुरोध और प्रतिक्रिया जोड़े, टाइमस्टैम्प, डिफ आउटपुट, और अस्पष्टता को दूर करने के लिए आवश्यक कोई भी चीज़। चौथा है प्रदर्शित प्रभाव: यह नहीं कि सैद्धांतिक रूप से समान बग क्या कर सकते हैं, बल्कि यह कि यह बग यहाँ क्या करता है। Bugcrowd के दस्तावेज़ और मार्गदर्शन दोनों ही इस संरचना पर सहमत होते हैं, भले ही वे थोड़े अलग लेबल का उपयोग करते हों। वह एकरूपता मायने रखती है। इसका मतलब है कि आपके AI सहायक को संरचना पर प्रशिक्षित किया जाना चाहिए, न कि मनाने पर। (बगक्राउड दस्तावेज़)

अधिकांश शोधकर्ताओं द्वारा किया जा सकने वाला सबसे बड़ा अपग्रेड है अवलोकन को अनुमान से स्पष्ट रूप से अलग करना। सारतः लिखें, "अवलोकित परिणाम: खाता A स्थिति Y के तहत X को ट्रिगर कर सकता है।" फिर अलग से लिखें, "सुरक्षा व्याख्या: ऐसा प्रतीत होता है कि यह सीमा Z को बायपास करता है।" फिर अलग से लिखें, "प्रभाव: यह परिणाम इन प्रतिबंधों के तहत हमलावर को Q करने की अनुमति देगा।" एआई सिस्टम उन परतों को अलग रखने में खराब होते हैं जब तक आप उन्हें ऐसा करने के लिए मजबूर नहीं करते। वे साक्ष्य और व्याख्या को एक सहज कथा में मिला देते हैं। ट्रायजर्स सहजता को पुरस्कृत नहीं करते। वे पुनरुत्पादन क्षमता को पुरस्कृत करते हैं। (बगक्राउड दस्तावेज़)

एक और कम आंकी गई प्रथा है स्थिरता को ईमानदारी से दर्ज करना। OpenAI का सार्वजनिक सुरक्षा बग बाउंटी पेज स्पष्ट रूप से कहता है कि कम से कम एक प्रकार की प्रॉम्प्ट-इंजेक्शन रिपोर्ट कम से कम 50 प्रतिशत बार दोबारा उत्पन्न होनी चाहिए। यहां तक कि जब कोई श्रेणी कोई सीमा प्रकाशित नहीं करती, तब भी स्थिरता मायने रखती है। यदि आपका व्यवहार दस में से एक बार ही होता है और केवल मैन्युअल रूप से प्रोत्साहित करने पर होता है, तो इसे लिखें। अस्थिरता को छिपाने से रिपोर्ट मजबूत नहीं होती। यह सत्यापन को कठिन बना देता है। एआई आपको बार-बार चलाए गए परिणामों का सारांश बनाने में मदद कर सकता है, लेकिन यह अंतर्निहित संकेत की गुणवत्ता को नहीं बदल सकता। (ओपनएआई)

एक सरल मैनिफेस्ट प्रारूप आपको इसे साफ-सुथरा बनाए रखने में मदद कर सकता है। मुद्दा नौकरशाही का नहीं है। मुद्दा एक ऐसा टिकाऊ रिकॉर्ड बनाने का है जिसे एक एआई सहायक बिना महत्वपूर्ण तथ्यों को चुपचाप खोए संक्षेप में प्रस्तुत कर सके।

शीर्षक: "ठोस समस्या और ठोस परिणाम का वर्णन करें"

लक्ष्य: "विशिष्ट उत्पाद सतह या संपत्ति"

लेन: "सुरक्षा | सुरक्षा | अनिश्चित"

परीक्षण_दिनांक_यूटीसी: "2026-03-26T18:30:00Z"

खाते:

कारक: "शोधकर्ता-नियंत्रित खाता"

पीड़ित: "यदि लागू हो तो शोधकर्ता-नियंत्रित तुलना खाता"

पूर्व-शर्तें:

- "सभी सेटअप आवश्यकताओं की सूची"

पुनरुत्पादन:

- चरण: 1

कार्रवाई: "आपने क्या किया"

आर्टिफैक्ट: "request-01.txt"

- step: 2

action: "क्या बदला"

artifact: "response-01.json"

evidence:

screenshots:

- "screen-01.png"

diffs:

- "role-diff.txt"

observed_result: "वास्तव में क्या हुआ"

expected_result: "क्या होना चाहिए था"

प्रभाव:

प्रभावित_उपयोगकर्ता: "कौन प्रभावित है"

अतिक्रमित_सीमा: "कौन सी सीमा विफल हुई"

बाधाएँ: "शोषण क्षमता पर कोई सीमा"

स्थिरता:

प्रयास: 5

सफलताएँ: 4

सुधार_संकेत: "एक वाक्य, यदि स्पष्ट हो"

इस तरह का एक मैनिफेस्ट एआई को सही कार्य भी देता है। किसी मॉडल से यह पूछने के बजाय, "क्या मुझमें कोई गंभीर बग है," आप पूछ सकते हैं, "इस मैनिफेस्ट और इन अटैचमेंट्स को एक संक्षिप्त रिपोर्ट ड्राफ्ट में बदलें, अनिश्चितता को बनाए रखते हुए और गंभीरता की भाषा को संयमित रखते हुए।" यह एआई का कहीं अधिक सुरक्षित और उत्पादक उपयोग है। यह सहायक को सत्यापित तथ्यों के बाद रखता है, न कि उनसे पहले।बगक्राउड दस्तावेज़)

एक और परिचालन विवरण महत्वपूर्ण है: Bugcrowd के दस्तावेज़ों में कहा गया है कि रिपोर्ट किए जाने के बाद आप सबमिशन को संपादित नहीं कर सकते। इससे ऑफ़लाइन समीक्षा और ड्राफ़्ट की गुणवत्ता कई शोधकर्ताओं की अपेक्षा कहीं अधिक महत्वपूर्ण हो जाती है। AI आपकी रिपोर्ट सबमिट करने से पहले दबाव-परीक्षण करने में मदद कर सकता है, यह पूछकर कि क्या कोई पूर्व शर्तें छूट गई हैं, कोई कदम अस्पष्ट है, या कोई बिना समर्थन वाले प्रभाव दावे हैं। इस तरह उपयोग किए जाने पर, यह मॉडल आपके निष्कर्षों के लिए भ्रम पैदा करने वाला इंजन बनने के बजाय आपके साक्ष्यों के लिए एक गुणवत्ता-नियंत्रण परत बन जाता है। (बगक्राउड दस्तावेज़)

इतनी सारी OpenAI बग बाउंटी रिपोर्टें असफल क्यों हो जाती हैं, भले ही कुछ दिलचस्प हुआ हो?

सबसे आम चूक मुद्दे की गलत श्रेणी में फाइल करना है। एक सामान्य जेलब्रेक, एक अजीब मॉडल उत्तर, या एक नीति असंगति दिलचस्प हो सकती है, लेकिन यदि यह वर्तमान सार्वजनिक बाउंटी नियमों में फिट नहीं बैठती है, तो यह एक मजबूत सार्वजनिक रिपोर्ट नहीं है। OpenAI के सार्वजनिक पृष्ठ अब उस अंतर को पहले से कहीं अधिक स्पष्ट करते हैं। सेफ्टी बग बाउंटी को AI-विशिष्ट जोखिम चाहिए जिनमें संभावित, ठोस हानि और कार्रवाई योग्य समाधान मार्ग हों, न कि केवल ऐसे उदाहरण जहाँ मॉडल को कुछ ऐसा कहने के लिए प्रेरित किया गया हो जो उसे नहीं कहना चाहिए। CVE नीति अलग से मॉडल-व्यवहार संबंधी मुद्दों को उस प्रकटीकरण ट्रैक से बाहर रखती है। यदि आप निष्कर्षों पर विचार-मंथन के लिए AI का उपयोग कर रहे हैं, तो इस बिंदु पर आपके पास एक सख्त फ़िल्टर होना चाहिए, अन्यथा सहायक खुशी-खुशी आपके लिए दायरे से बाहर की सामग्री का अत्यधिक उत्पादन करने में मदद करेगा। (ओपनएआई)

दूसरी आम विफलता प्रभाव के बजाय अटकलें लगाना है। बगक्राउड के अपने रिपोर्टिंग दिशानिर्देश इस बात पर जोर देते हैं कि एक ही प्रकार की बग का गंभीरता संदर्भ और वास्तविक परिणाम के आधार पर बहुत अलग हो सकती है। व्यवहार में, बहुत सारी एआई-सहायित रिपोर्टें कुछ इस तरह पढ़ी जाती हैं: "यह पूर्ण समझौते, डेटा चोरी और प्लेटफ़ॉर्म के दुरुपयोग का कारण बन सकता है।" लेकिन संलग्न सबूत केवल एक अजीब प्रतिक्रिया या एक कमजोर स्थिति संक्रमण दिखाता है। परिणाम अनुमानित होता है। रिपोर्ट को डाउनग्रेड कर दिया जाता है, सूचनात्मक के रूप में बंद कर दिया जाता है, या लागू न होने के कारण खारिज कर दिया जाता है। एआई इसे और भी खराब बना देता है यदि आप इसे एक ज्ञात भेद्यता वर्ग से आपके सबूतों द्वारा समर्थित से अधिक मजबूत प्रभाव वाले बयान तक सामान्यीकरण करने देते हैं। (बगक्राउड)

तीसरी विफलता कमजोर पुनरुत्पादन क्षमता है। OpenAI का सार्वजनिक सुरक्षा कार्यक्रम स्पष्ट रूप से कम से कम एक प्रकार के एजेंट संबंधी मुद्दे के लिए पुनरुत्पादन सीमाओं का उल्लेख करता है। व्यापक रूप से, ट्राइएज करने वालों को सत्यापन के लिए एक स्थिर मार्ग की आवश्यकता होती है। यदि आपका मुद्दा किसी रेस, आधे-याद किए गए प्रॉम्प्ट अनुक्रम, या अनकहे खाता इतिहास पर निर्भर करता है, तो समस्या यह नहीं है कि ट्राइएज अन्यायपूर्ण है। समस्या यह है कि रिपोर्ट अधूरी है। यहीं पर एआई वास्तव में मदद कर सकता है, आपकी कच्ची नोटबुक को एक साफ समयरेखा में बदलकर और आपको छिपी हुई पूर्व-शर्तों को सूचीबद्ध करने के लिए मजबूर करके। लेकिन फिर भी, यह केवल वही प्रकट कर सकता है जो मौजूद है। यह शून्य से पुनरुत्पादन क्षमता पैदा नहीं कर सकता। (ओपनएआई)

चौथी विफलता लक्ष्य के व्यवहार और आपके अपने टूलचेन के व्यवहार के बीच अंतर करने में असफल होना है। यह एआई युग में एक बढ़ती हुई समस्या है। शोधकर्ता तेजी से ब्राउज़र एजेंट, MCP-संयोजित सहायक, स्थानीय मॉडल सर्वर, और ऑटोमेशन रैपर का उपयोग कर रहे हैं। यदि कुछ अजीब होता है, तो आपको यह जानना होगा कि बग लक्ष्य में है, आपके अपने एजेंट के निर्देश प्रबंधन में है, किसी स्थानीय एक्सटेंशन में है, या किसी कनेक्टर में है जिसने रास्ते में डेटा लीक या परिवर्तित किया। OpenAI की अपनी सुरक्षा लेखन फ्रेमिंग एजेंट समझौते को स्रोतों और सिंक्स के संदर्भ में देखती है, और वह फ्रेमिंग यहाँ भी उपयोगी है। एक स्रोत हमलावर-नियंत्रित सामग्री हो सकती है, लेकिन सिंक लक्ष्य नहीं, बल्कि आपका अपना टूल कॉलिंग लेयर हो सकता है। यदि आप इसे अलग नहीं कर सकते, तो आपके पास अभी तक कोई लक्ष्य रिपोर्ट नहीं है। (ओपनएआई)

पाँचवां विफलता अति-स्वचालन है। OpenAI की सार्वजनिक शर्तें स्पष्ट रूप से स्वचालित या प्रोग्रामेटिक रूप से डेटा या आउटपुट निकालने और सेवाओं में हस्तक्षेप या व्यवधान डालने पर रोक लगाती हैं। इसका यह मतलब नहीं कि आप अपनी विश्लेषण पाइपलाइन में स्वचालन का उपयोग नहीं कर सकते। इसका मतलब यह है कि आपको किसी भी ऐसे AI वर्कफ़्लो के प्रति अत्यंत सतर्क रहना चाहिए जो अप्रत्यक्ष रूप से आपके स्थानीय तर्क सहायक को वास्तविक सेवा के खिलाफ एक लाइव स्वचालन इंजन में बदल देता है। इस क्षेत्र में परिपक्व शोध अधिक लापरवाह नहीं है क्योंकि बेहतर उपकरण मौजूद हैं। यह अधिक अनुशासित है क्योंकि उपकरण अधिक शक्तिशाली हैं। (ओपनएआई)

संबंधित CVEs बताते हैं कि आपका AI पेनटेस्ट टूल कमजोर कड़ी क्यों बन सकता है।

यदि आप ऑफेंसिव-सिक्योरिटी वर्कफ़्लो में AI का उपयोग करने को लेकर गंभीर हैं, तो आपको AI स्टैक को भी सुरक्षित करना होगा। यह कोई गौण मुद्दा नहीं है। यह आपके शोध की गुणवत्ता को बदल देता है। एक समझौता किया गया या कमजोर टूलचेन सबूतों को तोड़-मरोड़ सकता है, डेटा लीक कर सकता है, असुरक्षित क्रियाएं ट्रिगर कर सकता है, या नकली संकेत बना सकता है जिन्हें आप बाद में लक्ष्य पर गलत तरीके से आरोपित कर देते हैं। इसी कारण से AI टूलिंग इकोसिस्टम में हाल ही में सामने आए कई CVEs बग बाउंटी शोधकर्ताओं के लिए सीधे तौर पर प्रासंगिक हैं।एनवीडी)

Langflow से शुरू करें। NVD कहता है कि CVE-2025-3248 Langflow के 1.3.0 से पहले के संस्करणों को प्रभावित करता है और कोड इंजेक्शन के माध्यम से दूरस्थ, बिना प्रमाणीकरण वाले कोड निष्पादन की अनुमति देता है। /api/v1/validate/code एंडपॉइंट। यह बाउंटी शोधकर्ताओं के लिए मायने रखता है क्योंकि लैंगफ़्लो और इसी तरह के वर्कफ़्लो सिस्टम अक्सर एजेंट्स, प्रॉम्प्ट्स, कनेक्टर्स और परीक्षण फ़्लो के चारों ओर गोंद के रूप में उपयोग किए जाते हैं। यदि आपकी ऑर्केस्ट्रेशन लेयर को दूर से एक्सेस किया जा सकता है, तो आपका "एआई असिस्टेंट" सहायक रहना बंद कर देता है और हमले की सतह का हिस्सा बन जाता है। निवारण का सबक स्पष्ट है: वर्कफ़्लो बिल्डर्स को लापरवाही से एक्सपोज़ न करें, उन्हें जल्दी से पैच करें, और आंतरिक प्रयोग इंटरफ़ेस को सुरक्षित सार्वजनिक सतहों के साथ भ्रमित न करें। (एनवीडी)

Langflow यह भी याद दिलाता है कि AI सुरक्षा विफलताएँ अक्सर शर्मनाक रूप से पारंपरिक ही दिखती हैं। किसी मॉडल की उपस्थिति जादुई रूप से बग की कोई नई श्रेणी नहीं बनाती। कभी-कभी समस्या अभी भी एक एंडपॉइंट के पीछे अनधिकृत कोड निष्पादन की होती है, जिसे कभी भी पहुँच योग्य या विश्वसनीय नहीं होना चाहिए था। OpenAI बग बाउंटी कार्य के बारे में सोचते समय यह उपयोगी संदर्भ है। यह आपको जादुई सोच से दूर ले जाता है और विशिष्ट सीमाओं, पहुँच योग्य इंटरफेस, और ठोस शोषण शर्तों की ओर वापस लाता है। आपका AI वर्कफ़्लो जितना अधिक शक्तिशाली होता जाता है, आपकी सुरक्षा अनुशासन उतना ही अधिक पुराने जमाने का होना चाहिए। (एनवीडी)

फिर आता है ओल्लामा। NVD कहता है कि CVE-2025-0312, ओल्लामा के 0.3.14 तक के संस्करणों पर अपलोड की गई एक दुर्भावनापूर्ण GGUF मॉडल फ़ाइल को अनचेक्ड नल पॉइंटर डेरिफरेंस के माध्यम से सर्वर को क्रैश करने की अनुमति देता है, जिससे डिनायल ऑफ़ सर्विस होता है। ओल्लामा के लिए 2025 की बाद की प्रविष्टियाँ भी इकोसिस्टम के अन्य हिस्सों में प्रमाणीकरण और टोकन एक्सपोज़र की समस्याओं को दर्शाती हैं। एक बग बाउंटी शोधकर्ता को क्यों परवाह करनी चाहिए? क्योंकि बढ़ती संख्या में शोधकर्ता सारांश, वर्गीकरण, या एजेंट स्कैफ़ोल्डिंग के लिए साइडकार के रूप में स्थानीय या स्व-होस्टेड मॉडल का उपयोग करते हैं। यदि वह स्थानीय इंफरेंस लेयर अस्थिर है या कमजोर रूप से सुरक्षित है, तो यह किसी परीक्षण के बीच में ढह सकती है, आपके सबूतों की श्रृंखला को भ्रष्ट कर सकती है, या उन क्रेडेंशियल्स और आर्टिफैक्ट्स को उजागर कर सकती है जिन्हें आप स्थानीय रखना चाहते थे। प्रभाव को वास्तविक बनाने के लिए आपको किसी बड़े RCE की आवश्यकता नहीं है। अनुसंधान वातावरण में उपलब्धता और पृथक्करण भी मायने रखते हैं। (एनवीडी)

Ollama से सीख यह नहीं है कि "स्वयं होस्ट न करें।" यह है कि "स्वयं होस्ट किए गए AI इंफ्रास्ट्रक्चर को वास्तविक इंफ्रास्ट्रक्चर की तरह ही संभालें।" इसे पैच करें। इसे पहुँचने वालों को सीमित करें। यह ध्यान रखें कि यह कौन सी फाइलें स्वीकार करता है। संवेदनशील परियोजनाओं को अलग रखें। और यदि आप किसी AI पेंट-टेस्ट टूल को स्थानीय सहायकों को डेटा भेजने दे रहे हैं, तो समझें कि वे सहायक अब आपकी विश्वास श्रृंखला में शामिल हैं। यह तब और भी महत्वपूर्ण हो जाता है जब आपका शोध प्रॉम्प्ट्स, ट्रांसक्रिप्ट्स, या ऐसे सबूतों को छूता है जो बाद में एक समन्वित प्रकटीकरण बन सकते हैं। (एनवीडी)

CVE-2025-53098 Roo Code में प्रॉम्प्ट-टू-कॉन्फिग-टू-एक्ज़ीक्यूट समस्या का सबसे स्पष्ट उदाहरणों में से एक है, जो अब एजेंट सुरक्षा के अधिकांश हिस्से को परिभाषित करती है। NVD कहता है कि Roo Code एजेंट ने प्रोजेक्ट-विशिष्ट MCP कॉन्फ़िगरेशन को संग्रहीत किया .रू/एमसीपी.जेएसओएन, कि कॉन्फ़िगरेशन प्रारूप ने मनमाने कमांड निष्पादन की अनुमति दी, और संस्करण 3.20.3 से पहले एक हमलावर एजेंट से उस कॉन्फ़िगरेशन फ़ाइल में एक दुर्भावनापूर्ण कमांड लिखने के लिए कहने वाला एक प्रॉम्प्ट तैयार कर सकता था। NVD आगे यह भी बताता है कि मनमाने कमांड निष्पादन के लिए उपयोगकर्ता के पास MCP सक्षम होना और स्व-अनुमोदित फ़ाइल लेखन में सहभागी होना आवश्यक था। यह सिर्फ एक विशिष्ट IDE की कहानी नहीं है। यह बिल्कुल वैसी ही चेन बाउंटी है जिसे शोधकर्ताओं को आत्मसात करना चाहिए: हमलावर-नियंत्रित सामग्री, विशेषाधिकार प्राप्त लेखन पथ, खतरनाक निष्पादन पुल, सशर्त लेकिन सार्थक प्रभाव। (एनवीडी)

Roo Code विशेष रूप से OpenAI के बग बाउंटी कार्य के लिए प्रासंगिक क्यों है? क्योंकि OpenAI की अपनी 2026 सार्वजनिक सुरक्षा बग बाउंटी में अब स्पष्ट रूप से कुछ एजेंटिक प्रॉम्प्ट इंजेक्शन और MCP-संबंधित जोखिम श्रेणियाँ शामिल हैं। व्यापक पारिस्थितिकी तंत्र एक ही वास्तविकता पर सहमत हो रहा है: उच्च-मूल्य वाले मुद्दे अब केवल "मॉडल ने गलत कहा" तक सीमित नहीं हैं। वे हैं "अविश्वसनीय सामग्री ने वास्तविक अधिकार वाले एक टूल पाथ पर प्रभाव हासिल कर लिया।" रू कोड OpenAI के बाहर उस पैटर्न का एक ठोस उदाहरण है। यह शोधकर्ताओं को यह स्पष्ट रूप से सोचने में मदद करता है कि एक वास्तविक एजेंटिक जोखिम कैसा दिखता है और इसकी जिम्मेदारी से रिपोर्ट करने के लिए किस तरह के सबूतों की आवश्यकता होगी। (ओपनएआई)

Anthropic के अप्रचलित Slack MCP सर्वर में CVE-2025-34072 भी समान रूप से शिक्षाप्रद है। NVD कहता है कि अविश्वसनीय डेटा एजेंट को संवेदनशील डेटा एम्बेड करने वाले हमलावर-निर्मित हाइपरलिंक उत्पन्न करने के लिए प्रेरित कर सकता है, जिसके बाद Slack के प्रीव्यू बॉट्स हमलावर-नियंत्रित URL पर आउटबाउंड अनुरोध भेजेंगे, जिससे शून्य-क्लिक डेटा निकासी हो सकती है। यह एक उत्कृष्ट केस स्टडी है क्योंकि यह भाषा संबंधी समस्या और प्रणाली संबंधी समस्या के बीच के अंतर को दर्शाती है। मॉडल को नाटकीय रूप से पूरी तरह से "समझौता" करने की आवश्यकता नहीं थी। उसे बस अविश्वसनीय सामग्री को पारित करना था, गलत आकार में एक आउटपुट बनाना था, और एक बाहरी प्लेटफ़ॉर्म व्यवहार पर निर्भर करना था जो उस आउटपुट को सूचना निकासी (exfiltration) में बदल देता। यह ठीक उसी प्रकार का तर्क है जिसे एक अच्छे एआई पेनेटस्ट कार्य को आपको करने में मदद करनी चाहिए: सिंक्स (sinks) की पहचान करना, स्वचालन (automations) की पहचान करना, और यह पहचानना कि परतों के पार प्राधिकरण (authority) कहाँ लीक होता है। (एनवीडी)

मैटरमॉस्ट के AI प्लगइन में CVE-2025-31363 एक अलग दृष्टिकोण से एक समान कहानी बताता है। NVD कहता है कि उत्पाद यह प्रतिबंधित करने में विफल रहा कि LLM किन डोमेनों का अनुरोध कर सकता है, जिससे एक प्रमाणीकृत उपयोगकर्ता Jira टूल में प्रॉम्प्ट इंजेक्शन के माध्यम से पीड़ित के लिए सुलभ किसी भी सर्वर से डेटा बाहर निकाल सकता था। एक बार फिर, प्रासंगिक सबक विक्रेता नहीं है। यह दोष की संरचना है। एक कनेक्टेड असिस्टेंट को नेटवर्क तक पहुंच और अपर्याप्त डोमेन प्रतिबंध दिया गया था, और अविश्वसनीय सामग्री यह प्रभावित कर सकती थी कि डेटा कहाँ गया। यह यह आकलन करने के लिए एक सहायक मानसिक मॉडल है कि क्या एआई-संबंधी OpenAI रिपोर्ट सार्वजनिक सुरक्षा बग बाउंटी लेन में शामिल होनी चाहिए। आप "अजीब शब्दों" की तलाश नहीं कर रहे हैं। आप प्रभाव से कार्रवाई और फिर हानि तक जाने वाले एक वास्तविक मार्ग की तलाश कर रहे हैं। (एनवीडी)

नीचे दी गई तालिका दर्शाती है कि बाउंटी वर्कफ़्लो में AI पेनेट्रेशन टेस्टिंग टूल का उपयोग करने वाले किसी भी व्यक्ति के लिए ये CVEs क्यों महत्वपूर्ण हैं।एनवीडी)

| सीवीई | प्रभावित घटक | बाउंटी शोधकर्ताओं के लिए यह क्यों मायने रखता है | मुख्य पूर्वशर्त | व्यावहारिक शमन |

|---|---|---|---|---|

| CVE-2025-3248 | लैंगफ्लो | आपकी वर्कफ़्लो/ऑर्केस्ट्रेशन परत आपके लक्ष्य के बजाय कमजोरी बन सकती है। | 1.3.0 से पहले के संस्करणों में एक असुरक्षित एंडपॉइंट उजागर था। | पैच, वर्कफ़्लो बिल्डर्स को उजागर होने से बचाएँ, पहुँच प्रतिबंधित करें |

| सीवीई-2025-0312 | ओल्लामा | स्थानीय साइडकार मॉडल अस्थिर या शोषण योग्य हो सकते हैं, जिससे साक्ष्य प्रबंधन को नुकसान पहुँचता है। | कमजोर सर्वर पर दुर्भावनापूर्ण GGUF अपलोड | पैच, मॉडल होस्ट्स को अलग करें, फ़ाइल इनटेक को नियंत्रित करें |

| CVE-2025-53098 | रू कोड | प्रॉम्प्ट इंजेक्शन कॉन्फ़िग लेखन में प्रवेश कर सकता है और फिर कमांड निष्पादन कर सकता है। | त्वरित प्रभाव के साथ MCP सक्षम और स्वतः-अनुमोदित लेखन | पैच, खतरनाक स्वचालित अनुमोदन को अक्षम करें, कॉन्फ़िग पथों की सुरक्षा करें |

| CVE-2025-34072 | स्लैक एमसीपी सर्वर | प्रतीत होने वाला हानिरहित उत्पन्न आउटपुट प्लेटफ़ॉर्म ऑटोमेशन के माध्यम से शून्य-क्लिक एक्सफ़िल्ट्रेशन बन सकता है। | एजेंट द्वारा संसाधित अविश्वसनीय डेटा और लिंक अनफ़र्लिंग व्यवहार | स्वचालन को सीमित करें, आउटपुट को स्वच्छ करें, आउटबाउंड सिंक्स को कम करें |

| CVE-2025-31363 | मैटरमॉस्ट एआई प्लगइन | डोमेन नियंत्रण और कनेक्टर सीमाएँ एआई एक्सफिल्ट्रेशन जोखिम के लिए केंद्रीय हैं। | टूल वर्कफ़्लो में प्रमाणीकृत उपयोगकर्ता और प्रॉम्प्ट इंजेक्शन पथ | कड़े डोमेन अनुमत-सूची, उपकरण-स्तर के निकास नियंत्रण |

यहीं पर Penligent की सत्यापन और साक्ष्य पर सार्वजनिक स्थिति, केवल दिखावटी स्वायत्तता के दावों की तुलना में अधिक उपयोगी है। एक गंभीर AI पेनेटस्ट प्लेटफ़ॉर्म को आपको टूल की सीमाओं को दृश्यमान बनाए रखने, आर्टिफैक्ट्स को संरक्षित करने, और जब वर्कफ़्लो किसी सार्थक सिंक के पास पहुँचता है तो मानवीय समीक्षा की आवश्यकता करने में मदद करनी चाहिए। चाहे आप Penligent, Burp AI, एक स्थानीय एजेंट स्टैक, या अपनी खुद की स्क्रिप्ट्स का उपयोग कर रहे हों, यह सही डिज़ाइन प्रवृत्ति है। परिचालन लक्ष्य ट्रेसबिलिटी है। यदि आपका असिस्टेंट यह नहीं दिखा सकता कि उसने क्या देखा, उसने क्या बदला, और उसने कौन से सबूत उत्पन्न किए, तो यह उच्च-गुणवत्ता वाले बग बाउंटी कार्य के लिए उपयुक्त नहीं है। (पेनलिजेंट)

OpenAI बग बाउंटी कार्य के लिए एआई पेनेटस्ट टूल चुनने का मतलब सिर्फ मॉडल की गुणवत्ता नहीं, बल्कि नियंत्रण चुनना भी है।

बहुत सारी "सर्वश्रेष्ठ AI पेंटस्ट टूल" चर्चाएँ अभी भी मॉडल पर बहुत अधिक ध्यान केंद्रित करती हैं। यह समझ में आता है, लेकिन अधूरा है। मॉडल मायने रखता है। वर्कफ़्लो और भी अधिक मायने रखता है। OpenAI का एजेंट बनाने के लिए अपना व्यावहारिक गाइड आधुनिक एजेंट सिस्टम का वर्णन मॉडल, टूल, स्टेट और ऑर्केस्ट्रेशन के संदर्भ में करता है। इसकी डेवलपर सुरक्षा मार्गदर्शन प्रॉम्प्ट-इंजेक्शन जोखिमों, टूल-कॉलिंग में सावधानी, और अविश्वसनीय सामग्री को विशेषाधिकार प्राप्त चैनलों में मिलाने के खतरे पर जोर देती है। सर्वश्रेष्ठ वर्तमान पेंटस्ट टूलिंग अनुसंधान आक्रामक पक्ष से भी यही बात कहता है: मुश्किल हिस्सा कोई एक चतुर विचार उत्पन्न करना नहीं है, बल्कि स्थिति को बनाए रखना, उपकरणों को नियंत्रित करना, और एक बहु-चरणीय प्रक्रिया में सबूतों को संरक्षित रखना है। (ओपनएआई डेवलपर्स)

बौंटी कार्य के लिए, इसका मतलब है कि आपके मूल्यांकन मानदंड व्यावहारिक होने चाहिए। क्या यह उपकरण अलग-अलग परिकल्पनाओं के लिए अलग-अलग नोट्स रख सकता है, या क्या यह उन्हें एक साथ मिला देता है? क्या यह मूल अनुरोध, प्रतिक्रियाएँ, स्क्रीनशॉट और डिफ़्स सुरक्षित रख सकता है, या केवल वर्णनात्मक सारांश ही प्रदान करता है? क्या आप संदर्भ को किसी दूरस्थ मॉडल को भेजने से पहले विश्लेषण को स्थानीय रूप से संपादित या छिपा सकते हैं? क्या आप एजेंट द्वारा प्रस्तावित अगले कदम की समीक्षा या संपादन कर सकते हैं, इससे पहले कि कोई लाइव कार्रवाई हो? क्या यह आपको ऐसी रिपोर्ट तैयार करने में मदद कर सकता है जो सीधे Bugcrowd के अपेक्षित फ़ील्ड्स से मेल खाती हो? ये प्रश्न इस बात से अधिक महत्वपूर्ण हैं कि क्या सहायक पाँच पैराग्राफ़ तक विशेषज्ञ की तरह बोल सकता है। (बगक्राउड दस्तावेज़)

यही कारण है कि हाल के सबसे उपयोगी Penligent पेज वे नहीं हैं जो विशेषज्ञों की जगह AI लेने के बारे में बड़े दावे करते हैं। सबसे प्रभावशाली वे पेज हैं जो AI पेंटस्ट टूल्स, बग बाउंटी सॉफ्टवेयर, और पेंटस्ट-GPT-शैली के वर्कफ़्लो पर चर्चा करते हैं, विशेष रूप से स्थिति को संरक्षित करने, कच्चे संकेतों को सत्यापित निष्कर्षों में बदलने, और ऑपरेटर को लक्ष्य मॉडलिंग से पुनरुत्पादन योग्य साक्ष्य तक पहुंचने में मदद करने के संदर्भ में। चाहे आप पेनलिजेंट चुनें या नहीं, उपयोग करने का मानक यही है: क्या यह टूल आपके सबूतों को और सटीक बनाता है, आपके दायरे के अनुशासन को और मजबूत करता है, और आपकी रिपोर्ट को सत्यापित करना आसान बनाता है। यदि उत्तर 'नहीं' है, तो यह OpenAI-संबंधी शोध के लिए सही टूल नहीं है। (पेनलिजेंट)

एक शोधकर्ता जो OpenAI बग बाउंटी की गुणवत्ता की परवाह करता है, उसे आमतौर पर एक ऐसी प्रणाली को प्राथमिकता देनी चाहिए जो थोड़ी कम स्वायत्त हो और बहुत अधिक निरीक्षण योग्य हो। अब उस प्राथमिकता को शोध पक्ष और विक्रेता पक्ष दोनों की सार्वजनिक समर्थन प्राप्त है। PentestEval कहता है कि स्वायत्तता अभी भी नाजुक है। Burp AI कहता है कि ऑपरेटर नियंत्रण में रहता है। OpenAI के अपने एजेंट मार्गदर्शन में कहा गया है कि जोखिम उपकरण के उपयोग, डेटा लीकेज और प्रॉम्प्ट इंजेक्शन की सीमाओं में निहित है। कुल मिलाकर, ये स्रोत एक निष्कर्ष की ओर इशारा करते हैं: सही AI पेंटस्ट परीक्षण उपकरण वह है जो कार्रवाई और सबूतों को अस्पष्ट किए बिना विश्लेषण समय को कम करता है। (arXiv)

यदि आप एक मान्य OpenAI बग बाउंटी रिपोर्ट चाहते हैं तो क्या न करें

सामान्य जेलब्रेक को सार्वजनिक बाउंटी-योग्य सुरक्षा समस्या से भ्रमित न करें। OpenAI का सार्वजनिक सुरक्षा पृष्ठ कहता है कि सामान्य जेलब्रेक और कम-हानिकारक सामग्री-नीति बाईपास दायरे से बाहर हैं। इसकी CVE नीति अलग से कहती है कि मॉडल-व्यवहार संबंधी समस्याएं उस प्रकटीकरण दायरे में नहीं हैं। यदि समस्या मूल रूप से "मैंने मॉडल से कुछ ऐसा कहलवाया जो उसे नहीं कहना चाहिए था" जैसी है, तो आपका पहला काम यह निर्धारित करना है कि क्या आउटपुट के अलावा कोई पृथक, पुनरुत्पादित किया जा सकने वाला सुरक्षा या संरक्षा परिणाम है। यदि ऐसा नहीं है, तो सार्वजनिक इनाम की स्थिति की संभावना नहीं है। (ओपनएआई)

प्रोग्रामैटिक निष्कर्षण, तनाव परीक्षण, या बाईपास प्रयासों को हानिरहित अन्वेषण न समझें। OpenAI की सार्वजनिक उपयोग की शर्तें स्पष्ट रूप से स्वचालित या प्रोग्रामैटिक रूप से डेटा या आउटपुट निकालने तथा सेवाओं में हस्तक्षेप करने, जिसमें दर सीमाओं, प्रतिबंधों, सुरक्षात्मक उपायों, या सुरक्षा शमन को दरकिनार करना शामिल है, को निषेध करती हैं। यदि आपका AI पेंटस्ट वर्कफ़्लो चुपचाप आपको उन व्यवहारों की ओर धकेलता है, तो वर्कफ़्लो आरंभ से ही लक्ष्य के साथ असंगत है।ओपनएआई)

अपने ही टूल्स के विशेषाधिकार प्राप्त प्रॉम्प्ट चैनलों में कच्चा, समीक्षा न किया गया लक्ष्य सामग्री पेस्ट न करें। OpenAI की डेवलपर गाइडलाइन विशेष रूप से डेवलपर संदेशों में अविश्वसनीय चर रखने के खिलाफ चेतावनी देती है, क्योंकि उन चैनलों को अधिक अधिकार प्राप्त होता है और दूषित होने पर हमलावरों को अधिकतम लाभ मिलता है। यह केवल बिल्डर्स के लिए ही सलाह नहीं है। यह उन शोधकर्ताओं के लिए भी है जो वेब पेजों, संदेशों, फ़ाइलों या ट्रैफ़िक की जांच के लिए AI असिस्टेंट्स का उपयोग करते हैं।ओपनएआई डेवलपर्स)

AI को बिना निगरानी के आपका प्रभाव अनुभाग लिखने न दें। Bugcrowd की अपनी रिपोर्ट-लेखन मार्गदर्शिका कहती है कि प्रभाव वह जगह है जहाँ कई रिपोर्टें गलत हो जाती हैं, क्योंकि एक ही तकनीकी बग संदर्भ के आधार पर वास्तविक दुनिया में बहुत अलग गंभीरता रख सकता है। AI सामान्य प्रभावपूर्ण गद्य तैयार करने में उत्कृष्ट है। यही कारण है कि आपको सावधान रहना चाहिए। सामान्य प्रभावपूर्ण गद्य एक वैध तकनीकी निष्कर्ष को अपरिपक्व दिखाने का सबसे आसान तरीका है।बगक्राउड)

जल्दी सबमिट न करें। Bugcrowd के दस्तावेज़ों में कहा गया है कि रिपोर्टिंग के बाद सबमिशन संपादित नहीं किए जा सकते, और वे स्क्रीनशॉट, वीडियो, स्क्रिप्ट या लॉग्स सहित स्पष्ट प्रमाण देने की दृढ़ता से सलाह देते हैं। यदि यह निष्कर्ष अभी भी केवल एक परिकल्पना है, तो इसे अपनी नोटबुक में ही रखें। जब आप उल्लंघन की गई सीमा का वर्णन कर सकें, इसे स्वच्छ रूप से पुन: उत्पन्न कर सकें, और वास्तविक प्रभाव का दस्तावेजीकरण कर सकें, तब AI की मदद से इसे पैकेज करें। उससे पहले नहीं।बगक्राउड दस्तावेज़)

OpenAI बग बाउंटी कार्य के लिए AI पेनटेस्ट टूल्स का परिपक्व उपयोग अनिश्चितता को कम करना है।

यह खोज वाक्यांश का वास्तविक उत्तर है। OpenAI बग बाउंटी अनुसंधान में AI पेनेटस्ट उपकरणों का परिपक्व उपयोग आपकी हमला सतह को व्यापक बनाने के लिए नहीं है। इसका उद्देश्य आपकी अनिश्चितता को सीमित करना है। आप पहले से कैप्चर किए गए ट्रैफ़िक का सारांश निकालने, पहले से मापे गए राज्यों की तुलना करने, पहले से सत्यापित साक्ष्यों को व्यवस्थित करने, और पहले से माने गए तथ्यों के आधार पर रिपोर्ट का मसौदा तैयार करने के लिए AI का उपयोग करते हैं। आप इसका उपयोग यह अनुमान लगाने, प्रभाव गढ़ने, या यह निर्णय लेने के लिए नहीं करते कि कोई लाइव सेवा व्यापक जांच की हकदार है। (arXiv)

अब सार्वजनिक नियम उस अनुशासित दृष्टिकोण का समर्थन करते हैं। OpenAI के सुरक्षा और संरक्षा पृष्ठ रिपोर्टिंग मार्गों को स्पष्ट करते हैं। इसकी CVE नीति बताती है कि किस प्रकार की समस्याएं सार्वजनिक तकनीकी प्रकटीकरण के अंतर्गत आती हैं और कौन सी नहीं। इसकी प्रॉम्प्ट-इंजेक्शन और एजेंट-सुरक्षा सामग्री दिखाती है कि आधुनिक AI प्रणालियाँ वास्तव में कहाँ कमजोर हैं। NIST अभी भी नियंत्रित-परीक्षण मानसिकता प्रदान करता है। OWASP अभी भी वेब प्रणालियों के लिए व्यापक परीक्षण कवरेज मानचित्र और AI-संबंधित प्रणालियों के लिए नवीन एजेंटिक मार्गदर्शन प्रदान करता है। और वर्तमान पेनटेस्ट-टूलिंग साहित्य स्वचालन की सीमा को अनदेखा करना असंभव बना देता है। यह सावधान शोधकर्ताओं के लिए एक बहुत अच्छा वातावरण है। यह उन लोगों के लिए एक खराब वातावरण है जो उम्मीद कर रहे हैं कि एक एआई टूल पद्धति की जगह ले लेगा। (ओपनएआई)

जब आपका वर्कफ़्लो सही होता है, तो डिलीवेरेबल का वर्णन करना सरल हो जाता है। आपके पास एक संभावित समस्या है जो स्पष्ट रूप से या तो सुरक्षा लेन में या सुरक्षा (सेफ़्टी) लेन में आती है। आपके पास सीमित, पुनरुत्पादित किए जा सकने वाले चरणों का एक सेट है। आपके पास ऐसे सबूत हैं जो मूल कलाकृतियों को संरक्षित करते हैं। आपके पास एक प्रभाव विवरण है जो आपके द्वारा वास्तव में देखी गई चीज़ के अनुपात में है। और आपने एआई को उस एक काम के लिए मजबूर नहीं किया है जिसमें वह इस क्षेत्र में अभी भी सबसे खराब है, यानी यह दिखावा करना कि अनिश्चितता पहले ही हल हो चुकी है। इसी तरह एआई पेनटेस्ट टूल्स आपको बाउंटी कार्य में सम्मान अर्जित करने में मदद करते हैं। कभी-कभी यह आपको बाउंटी अर्जित करने में भी मदद करते हैं। (ओपनएआई)

किसी AI पेनटेस्ट टूल का सबसे व्यावहारिक मूल्य यह नहीं है कि यह "खुद बग ढूंढता है," बल्कि यह उस समय को कम करता है जो एक शोधकर्ता कच्चे इनपुट और परीक्षण योग्य निष्कर्षों के बीच घूमने में खर्च करता है। वास्तविक बग बाउंटी कार्य में, समय का एक बड़ा हिस्सा दोहराए जाने वाले कार्यों में गायब हो जाता है, जैसे लंबी HTTP ट्रेसों को पढ़ना, जावास्क्रिप्ट व्यवहार का सारांश तैयार करना, भूमिका-आधारित प्रतिक्रियाओं की तुलना करना, नोट्स व्यवस्थित करना, और मोटे अवलोकनों को सत्यापित करने के लिए पर्याप्त संरचित रूप में फिर से लिखना। एआई उस मध्य परत के लिए उपयुक्त है। यह शोर वाले आर्टिफैक्ट्स की व्याख्या करने के लिए आवश्यक समय को कम कर सकता है, उन पैटर्न को सामने ला सकता है जिन पर दूसरी नज़र डालने की ज़रूरत है, और बिखरे हुए निष्कर्षों को अनुवर्ती जाँचों की एक स्वच्छ श्रृंखला में बदल सकता है। इस तरह की तेजी मायने रखती है क्योंकि यह शोधकर्ता को उन हिस्सों पर अधिक ऊर्जा खर्च करने देती है जिनमें अभी भी निर्णय की आवश्यकता होती है, जैसे कि दायरे के निर्णय, शोषण क्षमता का विश्लेषण, और प्रभाव सत्यापन।

एआई पेनेटस्ट टूल्स इसलिए भी उपयोगी हैं क्योंकि वे विचारों की खोज के दायरे को बढ़ाते हैं। अनुभवी परीक्षक पहले से ही जानते हैं कि कई अच्छी खोजें थोड़े बेहतर प्रश्न पूछने से होती हैं: यह वर्कफ़्लो किन मान्यताओं पर आधारित है, किन राज्य परिवर्तनों पर बहुत जल्दी भरोसा किया जाता है, कौन से छिपे हुए ऑब्जेक्ट संदर्भ उजागर हो रहे हैं, जब एक संदर्भ की सामग्री को दूसरा संदर्भ उपभोग करता है तो क्या होता है। एआई ऐसे और भी सवाल बनाने में मदद कर सकता है, खासकर जब किसी लक्ष्य का इंटरफ़ेस सतह बड़ा हो या उसका बहु-चरणीय प्रवाह जटिल हो। यह दुरुपयोग के वैकल्पिक रास्ते सुझा सकता है, ऐसे सीमांत मामलों का प्रस्ताव कर सकता है जिन्हें कोई इंसान थके होने पर छोड़ सकता है, और पृष्ठों, अनुरोधों और टूल आउटपुट के पार अवलोकनों को जोड़ सकता है जो अन्यथा अलग-थलग रह जाते हैं। यह शोधकर्ता के विवेक का स्थान नहीं लेता, लेकिन यह समय समाप्त होने से पहले एक अधिक मौलिक और बेहतर-समर्थित परीक्षण पद्धति खोजने की संभावनाओं को बढ़ाता है।

OpenAI बग बाउंटी और AI पेंटस्ट टूल्स पर और पढ़ें

सार्वजनिक नियमों और कार्यक्रम संरचना के लिए, OpenAI की सुरक्षा बग बाउंटी घोषणा, OpenAI की सुरक्षा बग बाउंटी घोषणा, समन्वित भेद्यता प्रकटीकरण नीति, और OpenAI की CVE असाइनमेंट नीति से शुरू करें। ये वे पृष्ठ हैं जो वर्तमान सार्वजनिक लेन, दायरा भाषा, और प्रकटीकरण अपेक्षाओं को परिभाषित करते हैं।ओपनएआई)

AI-विशिष्ट सुरक्षा तर्क के लिए, OpenAI का 'प्रॉम्प्ट इंजेक्शन का प्रतिरोध करने के लिए AI एजेंट डिज़ाइन करना' और 'एजेंट बनाने में सुरक्षा' पर OpenAI डेवलपर दस्तावेज़ीकरण पढ़ें। ये पृष्ठ बताते हैं कि प्रॉम्प्ट इंजेक्शन का विश्लेषण केवल प्रॉम्प्ट-स्ट्रिंग समस्या के रूप में नहीं, बल्कि प्राधिकरण, सिंक्स और टूल सीमाओं से जुड़ी एक प्रणालीगत समस्या के रूप में क्यों किया जाना चाहिए।ओपनएआई)

परीक्षण पद्धति और यथार्थवादी अपेक्षाओं के लिए, नियंत्रित परीक्षण अनुशासन हेतु NIST SP 800-115 और LLM-सहायित पेनटेस्टिंग की वर्तमान स्थिति के लिए PentestGPT और PentestEval का संयोजन अभी भी सर्वश्रेष्ठ जोड़ी है। PortSwigger का Burp AI दस्तावेज़ीकरण भी मूल्यवान है क्योंकि यह दिखाता है कि एक परिपक्व आक्रामक उपकरण विक्रेता AI को प्रतिस्थापन के बजाय सहायक के रूप में कैसे प्रस्तुत करता है।एनआईएसटी कंप्यूटर सुरक्षा संसाधन केंद्र)

संबंधित ढाँचों के लिए, OWASP की वेब सुरक्षा परीक्षण गाइड पारंपरिक वेब परीक्षण कवरेज के लिए अब भी सबसे मजबूत सार्वजनिक मानचित्र बनी हुई है, जबकि OWASP के नए एजेंटिक और LLM सुरक्षा संसाधन AI-संबंधित व्यवहार को ठोस जोखिम श्रेणियों में अनुवादित करने में मदद करते हैं। जब आपका विश्लेषण सामान्य वेब कमजोरियों से परे चला जाता है, तो MITRE ATLAS भी AI हमले के व्यवहारों के बारे में सोचने में उपयोगी होता है।ओवास्प फाउंडेशन)

इस विषय को स्वाभाविक रूप से आगे बढ़ाने के लिए प्रासंगिक Penligent पठन हेतु सबसे उपयोगी सार्वजनिक पृष्ठ हैं: Penligent का AI Pentest Tool लेख, Bug Bounty Hunter Software in 2026, Pentest GPT in 2026, और AI in Cyber Security। ये पृष्ठ यहां इसलिए प्रासंगिक हैं क्योंकि ये कार्यप्रवाह के स्वरूप, ऑपरेटर नियंत्रण, साक्ष्य, और स्वायत्तता की सीमाओं पर ध्यान केंद्रित करते हैं, बजाय इसके कि ऐसा दिखाएँ कि AI विधि को वैकल्पिक बना देता है। पेनलिजेंट होमपेज केवल उन लेखों के बाद देखने के लिए सही जगह है, क्योंकि उत्पाद से संबंधित प्रश्न कार्यप्रवाह से संबंधित प्रश्न के बाद आता है, उससे पहले नहीं। (पेनलिजेंट)